Pytanie 1

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?

Aby zrealizować aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykonać polecenie

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jakie oprogramowanie dostarcza najwięcej informacji diagnostycznych na temat procesora CPU?

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

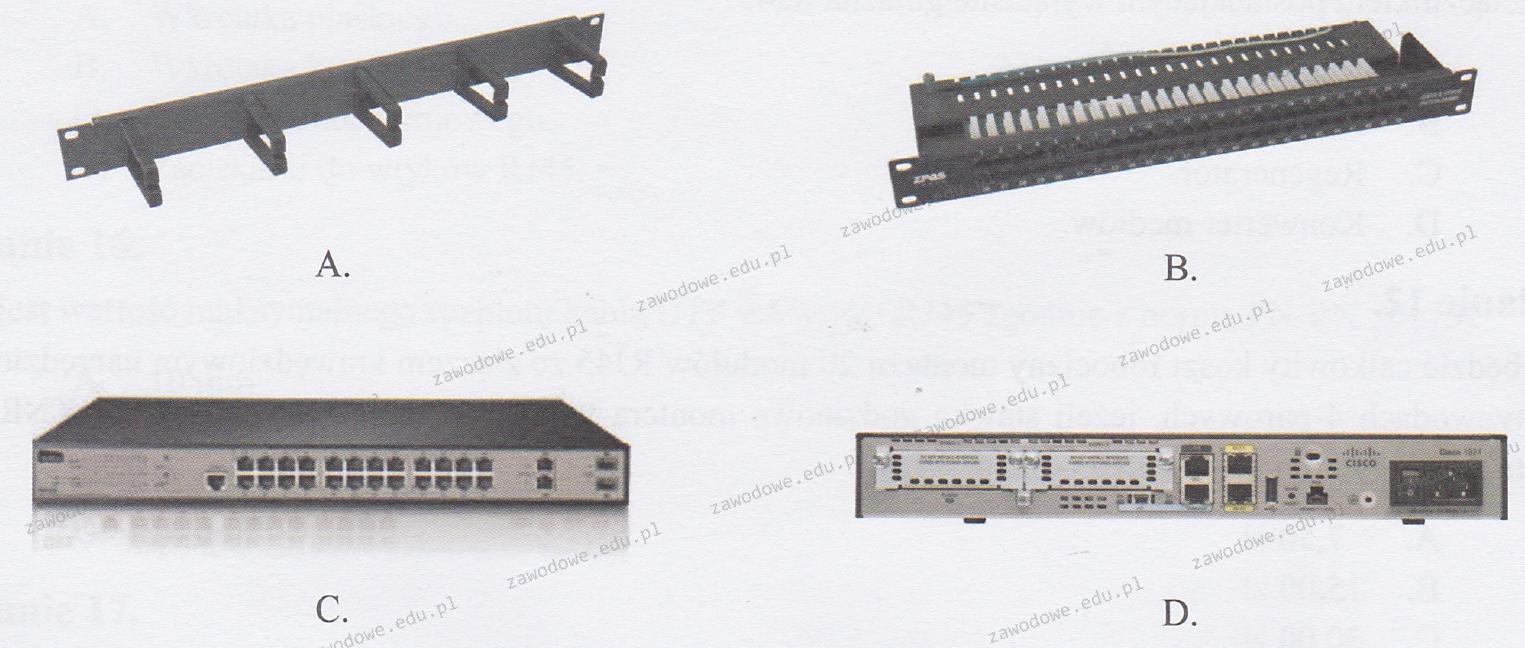

Na którym obrazku przedstawiono panel krosowniczy?

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Jak określana jest transmisja w obie strony w sieci Ethernet?

Jakie urządzenie powinno być wykorzystane do pomiaru struktury połączeń w sieci lokalnej?

Który z protokołów służy do synchronizacji czasu?

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Jakie polecenie w systemie Linux pozwala na zarządzanie uprawnieniami do plików oraz katalogów?

Cienki klient (thin client) korzysta z protokołu

Jakim elementem sieci SIP jest telefon IP?

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

Jakie polecenie pozwala na przeprowadzenie aktualizacji do nowszej wersji systemu Ubuntu Linux?

Aby możliwe było zorganizowanie pracy w wydzielonych logicznie mniejszych podsieciach w sieci komputerowej, należy ustawić w przełączniku

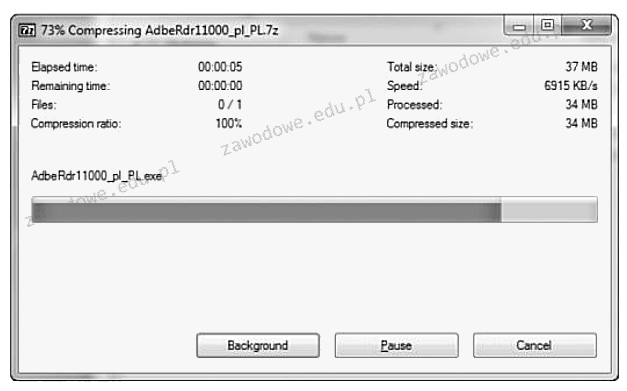

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Na dołączonym obrazku pokazano działanie

Na ilustracji widoczna jest pamięć operacyjna

Nie jest możliwe tworzenie okresowych kopii zapasowych z dysku serwera na przenośnych nośnikach typu

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

Podczas procesu zamykania systemu operacyjnego na wyświetlaczu pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zakończenie pracy systemu, spowodowane brakiem pamięci. Co może sugerować ten błąd?

Program do diagnostyki komputera pokazał komunikat NIC ERROR. Co oznacza ten komunikat w kontekście uszkodzenia karty?

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

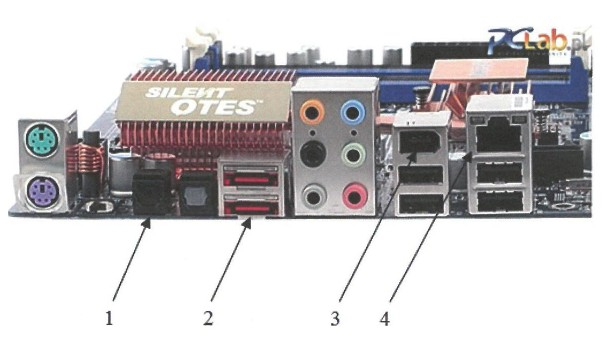

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Jak nazywa się atak na sieć komputerową, który polega na przechwytywaniu przesyłanych w niej pakietów?

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Podstawowym warunkiem archiwizacji danych jest

Jakie narzędzie będzie najbardziej odpowiednie do delikatnego wygięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Aby w systemie Windows Professional ustawić czas pracy drukarki oraz uprawnienia drukowania, należy skonfigurować

Wykonanie polecenia NET USER GRACZ * /ADD zapisanego w wierszu poleceń Windows spowoduje