Pytanie 1

Która z tras jest oznaczona literą R w tabeli routingu?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Która z tras jest oznaczona literą R w tabeli routingu?

Element elektroniczny przedstawiony na ilustracji to:

Który z poniższych interfejsów komputerowych stosuje transmisję równoległą do przesyłania danych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Złocenie styków złącz HDMI ma na celu

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Który z parametrów czasowych w pamięci RAM określany jest jako czas dostępu?

W systemie binarnym liczba szesnastkowa 29A będzie przedstawiona jako:

Aby oddzielić komputery działające w sieci z tym samym adresem IPv4, które są podłączone do zarządzalnego przełącznika, należy przypisać

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

W systemach Linux, aby wprowadzić nowe repozytorium, należy wykorzystać komendy

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

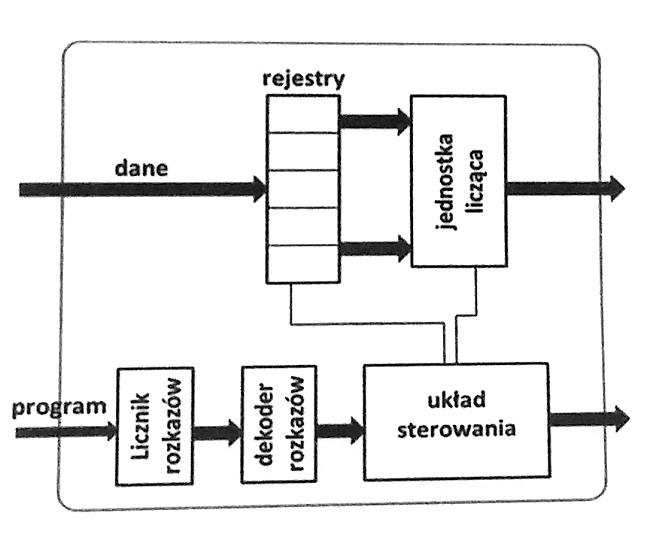

Rejestry przedstawione na diagramie procesora mają zadanie

W adresacji IPv6 standardowy podział długości dla adresu sieci oraz identyfikatora hosta wynosi odpowiednio

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

Na ilustracji widoczna jest pamięć operacyjna

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Na stabilność obrazu w monitorach CRT istotny wpływ ma

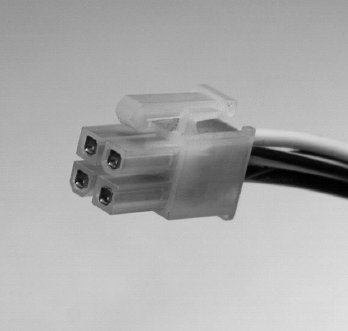

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Jaki protokół sieciowy używa portu 53?

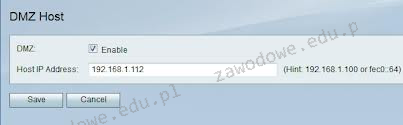

Na ilustracji widać zrzut ekranu ustawień strefy DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer z adresem IP 192.168.0.106

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

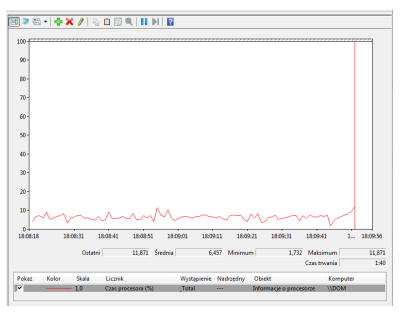

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

Przydzielaniem adresów IP w sieci zajmuje się serwer

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Aby połączyć projektor multimedialny z komputerem, należy unikać użycia złącza

Na podstawie wskazanego cennika oblicz, jaki będzie łączny koszt brutto jednego podwójnego natynkowego gniazda abonenckiego w wersji dwumodułowej?

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Czym jest NAS?

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Kontrola pasma (ang. bandwidth control) w switchu to funkcjonalność

ARP (Address Resolution Protocol) to protokół, który pozwala na konwersję

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?