Pytanie 1

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Skrót MAN odnosi się do rodzaju sieci

Dostarczanie błędnych napięć do płyty głównej może spowodować

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Aby umożliwić połączenie między urządzeniem mobilnym a komputerem za pomocą interfejsu Bluetooth, co należy zrobić?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Polecenie chmod +x test

Która z podanych właściwości kabla koncentrycznego RG-58 sprawia, że obecnie nie jest on używany do tworzenia lokalnych sieci komputerowych?

W systemie Windows 7, aby skopiować katalog c:\est wraz ze wszystkimi podkatalogami na zewnętrzny dysk, należy zastosować polecenie

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Interfejs HDMI w komputerze umożliwia transfer sygnału

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

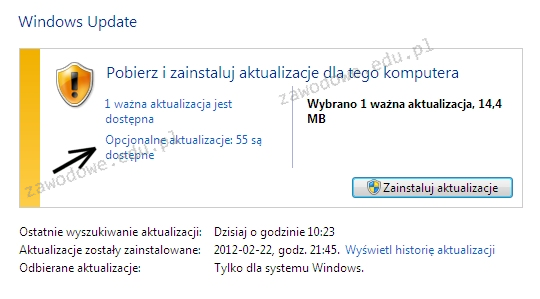

Jeżeli użytkownik zaznaczy opcję wskazaną za pomocą strzałki, będzie miał możliwość instalacji aktualizacji

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Który z wymienionych protokołów umożliwia nawiązanie szyfrowanego połączenia z witryną internetową?

Jakie polecenie w systemie Linux jest używane do planowania zadań?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

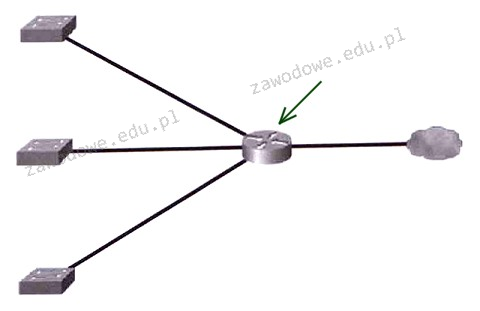

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Jak wygląda kolejność przewodów w wtyczce RJ-45 zgodnie z normą TIA/EIA-568 dla zakończeń typu T568B?

Sieci lokalne o architekturze klient-serwer są definiowane przez to, że

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Rejestr procesora, znany jako licznik rozkazów, przechowuje

Autor zamieszczonego oprogramowania zezwala na jego bezpłatne używanie jedynie w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Jaką postać ma liczba szesnastkowa: FFFF w systemie binarnym?

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest