Pytanie 1

Więzka promieniowania X to

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Więzka promieniowania X to

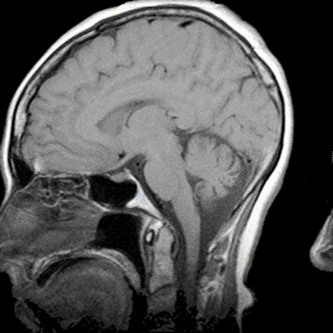

Który artefakt uwidoczniono na skanie RM głowy?

Kolimator wielolistkowy w akceleratorze liniowym jest stosowany do

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Osłony na gonady dla osób dorosłych powinny posiadać równoważnik osłabienia promieniowania nie mniejszy niż

Na zamieszczonej rycinie przedstawiono

Jaka jest standardowa odległość OF do wykonania rentgenowskich zdjęć kości i stawów kończyny górnej?

Radioizotopowa terapia medycyny nuklearnej polega na wprowadzeniu do tkanek lub narządów radiofarmaceutyku

Kasety do pośredniej radiografii cyfrowej CR są wyposażone

Który środek ochrony radiologicznej należy zastosować podczas badania czaszki 53-letniego pacjenta za pomocą tomografii komputerowej?

Ligand stosuje się

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Technika stereotaktyczna polega na napromienianiu nowotworu

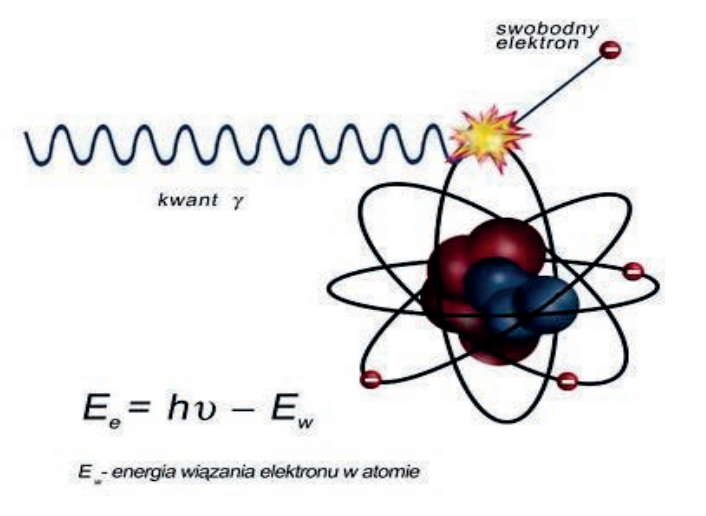

Rozpraszanie promieniowania X, w wyniku którego następuje zwiększenie długości fali promieniowania, to zjawisko

W której technice brachyterapii stosuje się źródła promieniowania o mocy dawki 2-12 Gy/h?

W badaniu PET CT wykorzystuje się radioizotopy emitujące promieniowanie

Planowany obszar napromieniania PTV obejmuje

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Jakie są wielkości mocy dawki stosowanej w brachyterapii HDR?

Z kratką przeciwrozproszeniową należy wykonać zdjęcie

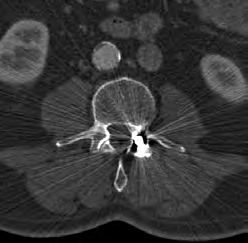

Zarejestrowany na obrazie TK artefakt jest spowodowany

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Jakie źródła promieniowania stosowane są w brachyterapii?

W diagnostyce metodą rezonansu magnetycznego biorą udział

W radiografii mianem SID określa się

Elementem pomocniczym w radioterapii, zapewniającym powtarzalność ułożenia w pozycji terapeutycznej, a także unieruchomienie pacjenta, jest

Jaka jest odległość pomiędzy źródłem promieniowania a powierzchnią ciała pacjenta w technice izocentrycznej radioterapii?

W ultrasonografii występuje zależność:

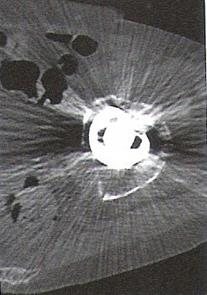

Który artefakt jest widoczny na skanie tomografii komputerowej?

Która właściwość promieniowania X pozwala na skierowanie promienia centralnego na wybrany punkt topograficzny podczas wykonywania badania radiologicznego?

Teleterapia polega na napromienowaniu

Fala głosowa rozchodzi się

Elementem systemu rejestracji obrazu, w którym fotony promieniowania X są bezpośrednio konwertowane na sygnał elektryczny, jest

Kto jest odpowiedzialny za wykonywanie testów podstawowych kontroli jakości gammakamery w Zakładzie Medycyny Nuklearnej?

Proces chemicznego wywoływania radiogramów polega na

Standardowo do wykonania których zdjęć należy zastosować kratkę przeciwrozproszeniową?

W leczeniu izotopowym tarczycy podaje się