Pytanie 1

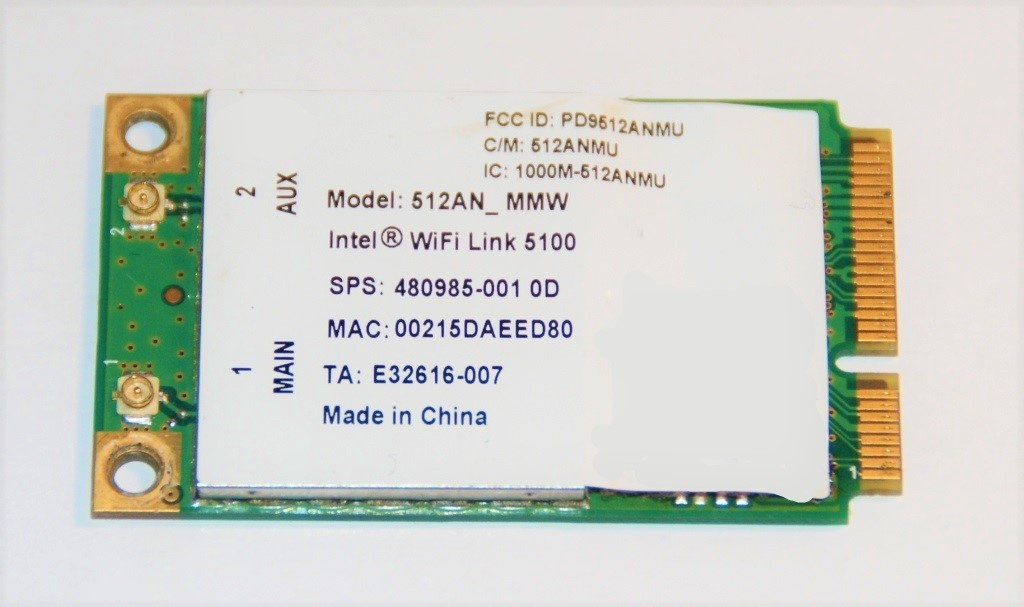

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Która z licencji pozwala każdemu użytkownikowi na wykorzystywanie programu bez ograniczeń związanych z prawami autorskimi?

Do realizacji iloczynu logicznego z negacją należy użyć funktora

Na ilustracji przedstawiono

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Jaką funkcjonalność oferuje program tar?

Thunderbolt to interfejs

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

W dokumentacji przedstawiono typ systemu plików

| „Zaawansowany system plików zapewniający wydajność, bezpieczeństwo, niezawodność i zaawansowane funkcje niespotykane w żadnej wersji systemu FAT. Na przykład dzięki standardowemu rejestrowaniu transakcji i technikom odzyskiwania danych system gwarantuje spójność woluminów. W przypadku awarii system wykorzystuje plik dziennika i informacje kontrolne do przywrócenia spójności systemu plików." |

W skład sieci komputerowej wchodzą 3 komputery stacjonarne oraz drukarka sieciowa, połączone kablem UTP z routerem mającym 1 x WAN oraz 5 x LAN. Które z urządzeń sieciowych pozwoli na podłączenie dodatkowych dwóch komputerów do tej sieci za pomocą kabla UTP?

Wskaż nośnik, który w sieciach komputerowych umożliwia najszybszą wymianę danych?

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

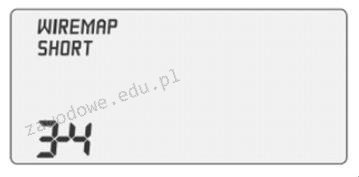

Na rysunku ukazano rezultat testu okablowania. Jakie jest znaczenie uzyskanego wyniku pomiaru?

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu dostosowania kolejności uruchamiania systemów operacyjnych, należy zmienić zawartość

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

W środowisku Linux uruchomiono skrypt przy użyciu dwóch argumentów. Uzyskanie dostępu do wartości drugiego argumentu z wnętrza skryptu możliwe jest przez

Aby uruchomić edytor rejestru w systemie Windows, należy skorzystać z narzędzia

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W systemach Windows XP Pro/Windows Vista Business/Windows 7 Pro/Windows 8 Pro, funkcją zapewniającą ochronę danych dla użytkowników dzielących ten sam komputer, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Aby skanera działał prawidłowo, należy

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Jakie polecenie w systemie Linux pozwala na dodanie istniejącego użytkownika nowak do grupy technikum?

Narzędzie służące do przechwytywania oraz ewentualnej analizy ruchu w sieci to

Przydzielanie przestrzeni dyskowej w systemach z rodziny Windows

Jakie polecenie pozwala na uzyskanie adresów fizycznych dla kart sieciowych w systemie?

Programem służącym do archiwizacji danych w systemie Linux jest

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Active Directory w systemach MS Windows Server 2000 oraz MS Windows Server 2003 to

Rysunek obrazuje zasadę działania drukarki

Określ zakres adresów IP z klasy A, który wykorzystywany jest do adresacji prywatnej w sieciach komputerowych?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Użycie trunkingowego połączenia między dwoma przełącznikami umożliwia