Pytanie 1

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Wartość 101011101102 zapisana w systemie szesnastkowym to

Jaką ochronę zapewnia program antyspyware?

Jakie działanie nie przyczynia się do personalizacji systemu operacyjnego Windows?

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

Zasada dostępu do medium CSMA/CA jest wykorzystywana w sieci o specyfikacji

Który z poniższych protokołów funkcjonuje w warstwie aplikacji?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Jaką komendę należy wykorzystać, aby uzyskać informację o rekordzie MX dla podanej domeny?

Jaki protokół komunikacyjny jest używany do przesyłania plików w modelu klient-serwer oraz może funkcjonować w dwóch trybach: aktywnym i pasywnym?

Według modelu TCP/IP, protokoły DNS, FTP oraz SMTP zaliczają się do warstwy

Planowana sieć należy do kategorii C. Została ona podzielona na 4 podsieci, z których każda obsługuje 62 urządzenia. Która z poniższych masek będzie odpowiednia do tego zadania?

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Norma EN 50167 odnosi się do rodzaju okablowania

Który kolor żyły nie występuje w kablu typu skrętka?

Dostosowywanie parametrów TCP/IP hosta w oparciu o adres MAC karty sieciowej to funkcjonalność jakiego protokołu?

Gniazdo na tablicy interaktywnej jest oznaczone tym symbolem. Które złącze powinno być wykorzystane do połączenia tablicy z komputerem?

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

Jaki adres IP w systemie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanemu w systemie binarnym?

Medium transmisyjne, które jest odporne na zakłócenia elektromagnetyczne i atmosferyczne, to

Na stabilność wyświetlanego obrazu w monitorach CRT istotny wpływ ma

Liczba 129 w systemie dziesiętnym będzie przedstawiona w formacie binarnym na

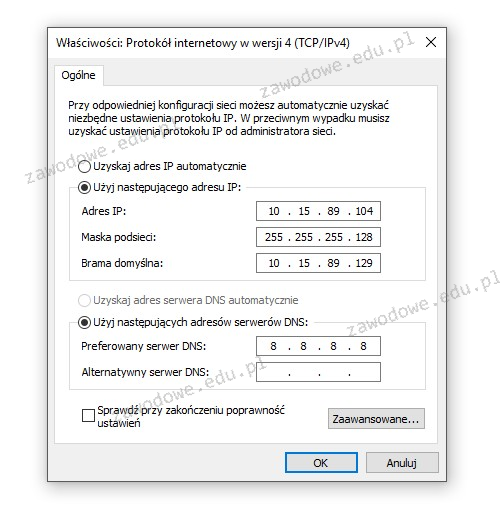

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu korzystania z komputera przez użytkownika?

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Złośliwe oprogramowanie, które rejestruje klawisze naciskane przez użytkownika w systemie operacyjnym, to

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Wskaż tryb operacyjny, w którym komputer wykorzystuje najmniej energii

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?