Pytanie 1

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Urządzenie klienckie automatycznie uzyskuje adres IP od serwera DHCP. W sytuacji, gdy serwer DHCP przestanie działać, karcie sieciowej przydzielony zostanie adres IP z przedziału

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

Firma planuje stworzenie lokalnej sieci komputerowej, która będzie obejmować serwer, drukarkę oraz 10 stacji roboczych bez kart bezprzewodowych. Internet będzie udostępniany przez ruter z modemem ADSL i czterema portami LAN. Które z wymienionych elementów sieciowych jest konieczne, aby sieć mogła prawidłowo działać i uzyskać dostęp do Internetu?

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Które z poniższych urządzeń jest przykładem urządzenia peryferyjnego wejściowego?

"Gorące podłączenie" ("Hot plug") oznacza, że urządzenie, które jest podłączane, ma

Na wyświetlaczu drukarki wyświetlił się komunikat "PAPER JAM". W celu usunięcia problemu, najpierw należy

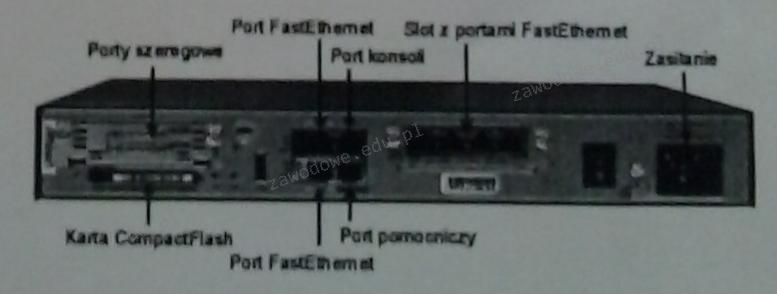

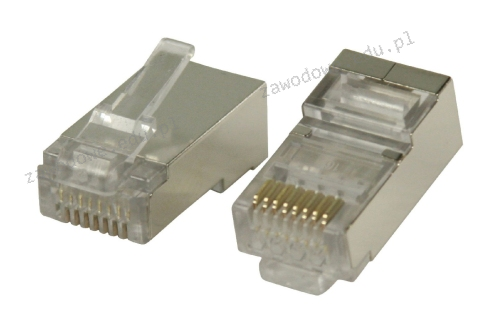

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

SuperPi to aplikacja używana do testowania

Jakiego typu transmisję danych przesyłanych za pomocą interfejsu komputera osobistego pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Częścią zestawu komputerowego, która zajmuje się zarówno przetwarzaniem danych wejściowych, jak i wyjściowych, jest

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

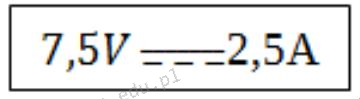

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

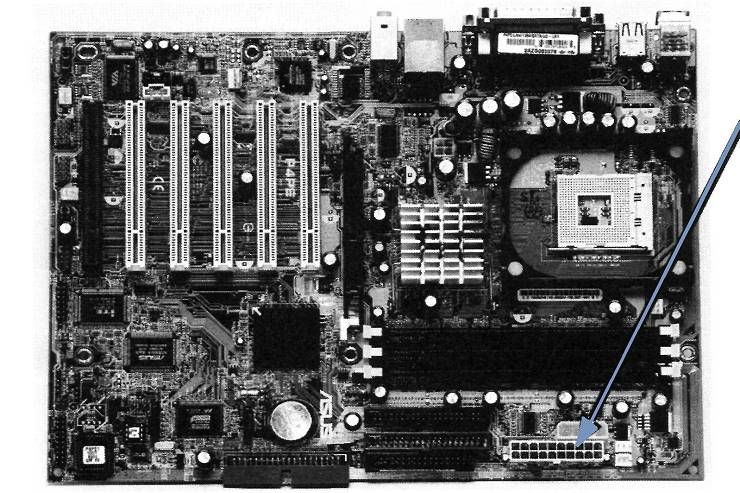

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

W drukarce laserowej do stabilizacji druku na papierze używane są

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Który z poniższych zapisów reprezentuje adres strony internetowej oraz przypisany do niego port?

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

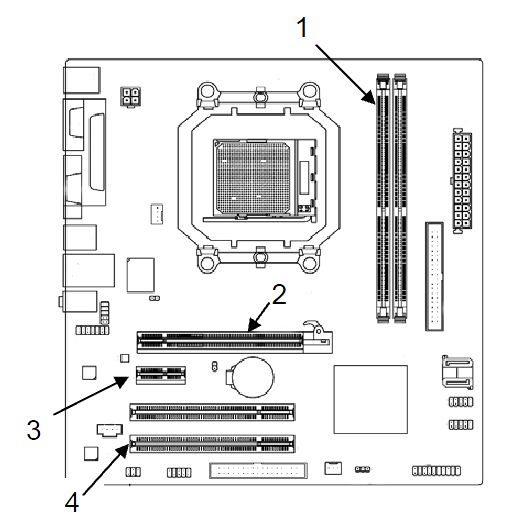

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Oblicz całkowity koszt kabla UTP Cat 6, który będzie użyty do połączenia 5 punktów abonenckich z punktem dystrybucji, mając na uwadze, że średnia odległość pomiędzy każdym punktem abonenckim a punktem dystrybucji wynosi 8 m oraz że cena za 1 m kabla wynosi 1 zł. W obliczeniach uwzględnij zapas 2 m kabla na każdy punkt abonencki.

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

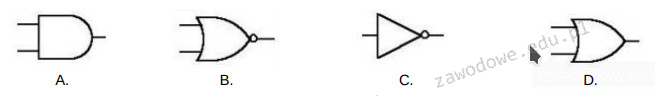

Wskaź rysunek ilustrujący symbol bramki logicznej NOT?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Watomierz jest stosowany do pomiaru