Pytanie 1

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

Wskaż zewnętrzny protokół rutingu?

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Funkcja znana jako: "Pulpit zdalny" standardowo operuje na porcie

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Tester strukturalnego okablowania umożliwia weryfikację

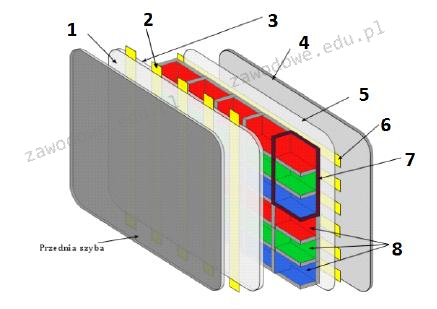

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

System S.M.A.R.T. jest używany do nadzorowania funkcjonowania i identyfikowania problemów

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

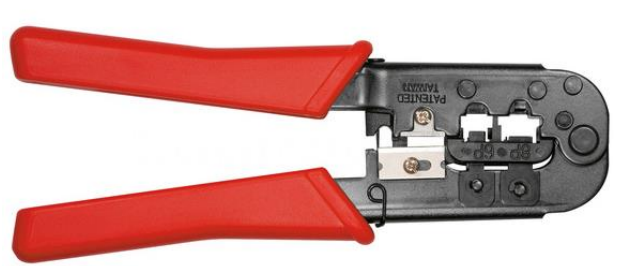

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Jaką liczbę adresów IP należy wykorzystać, aby 4 komputery podłączone do switcha mogły się swobodnie komunikować?

Aby użytkownik laptopa z systemem Windows 7 lub nowszym mógł korzystać z drukarki przez sieć WiFi, musi zainstalować drukarkę na porcie

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Zakres adresów IPv4 od 224.0.0.0 do 239.255.255.255 jest przeznaczony do jakiego rodzaju transmisji?

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Oświetlenie oparte na diodach LED w trzech kolorach wykorzystuje skanery typu

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Liczbie 16 bitowej 0011110010101110 wyrażonej w systemie binarnym odpowiada w systemie szesnastkowym liczba

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Jednym z rezultatów realizacji podanego polecenia jest

| sudo passwd -n 1 -x 5 test |

Jaki protokół komunikacyjny jest używany do przesyłania plików w modelu klient-serwer oraz może funkcjonować w dwóch trybach: aktywnym i pasywnym?

Jakie kable powinny być używane z narzędziem pokazanym na fotografii?

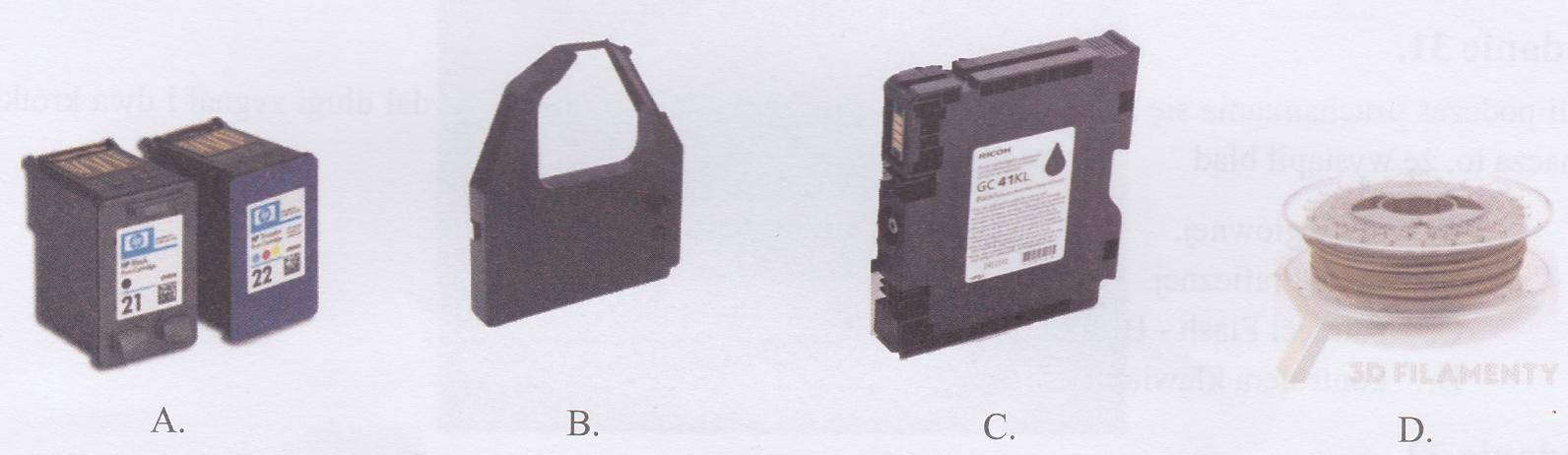

Wskaż ilustrację przedstawiającą materiał eksploatacyjny charakterystyczny dla drukarek żelowych?

W dokumentacji systemu operacyjnego Windows XP opisano pliki o rozszerzeniu .dll. Czym jest ten plik?

Osoba korzystająca z systemu Linux, chcąc zweryfikować dysk twardy pod kątem obecności uszkodzonych sektorów, ma możliwość skorzystania z programu

Przedmiot widoczny na ilustracji to

Który protokół umożliwia zarządzanie wieloma folderami pocztowymi oraz pobieranie i operowanie na listach znajdujących się na zdalnym serwerze?

Sieci lokalne o architekturze klient-serwer cechują się tym, że

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

W systemie operacyjnym pojawił się problem z driverem TWAIN, który może uniemożliwiać prawidłowe funkcjonowanie

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?