Pytanie 1

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

Do konwersji kodu źródłowego na program wykonywalny używany jest

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

Wskaź, które zdanie dotyczące zapory sieciowej jest nieprawdziwe?

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Aby przyznać użytkownikowi w systemie Windows możliwość zmiany czasu systemowego, należy skorzystać z narzędzia

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

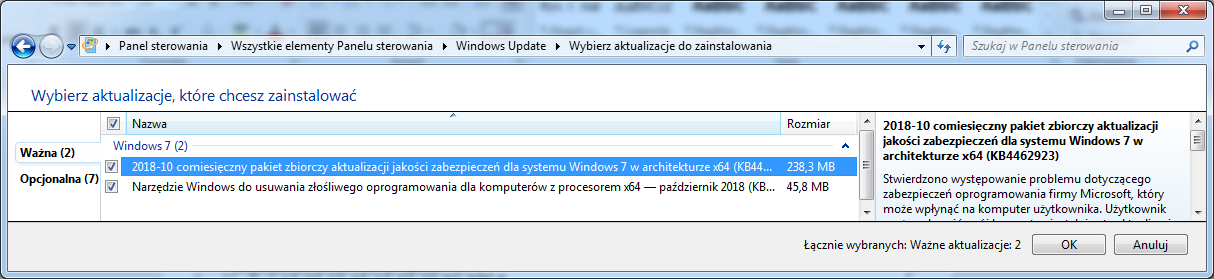

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Proces zapisywania kluczy rejestru do pliku określamy jako

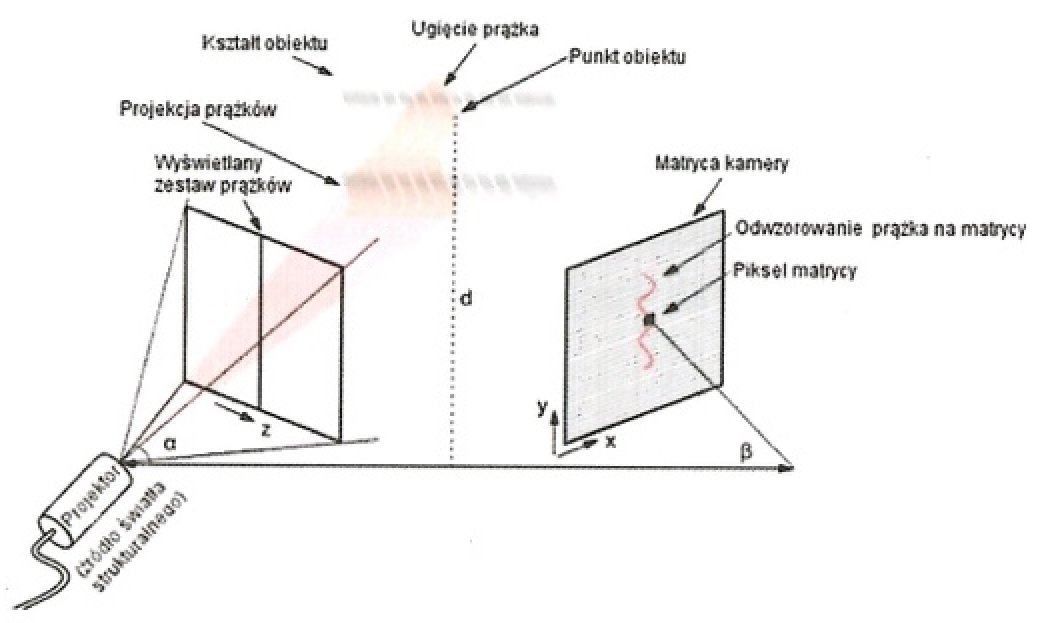

Zaprezentowany diagram ilustruje zasadę funkcjonowania skanera

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

Usługi na serwerze są konfigurowane za pomocą

Jaki typ macierzy dyskowych zapewnia tak zwany mirroring dysków?

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

Przedsiębiorca przekazujący do składowania odpady inne niż komunalne ma obowiązek prowadzić

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Jaką długość ma maska sieci dla adresów z klasy B?

Graficzny symbol pokazany na ilustracji oznacza

Kiedy użytkownik wprowadza w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl. Sprawdź nazwę i ponów próbę." Natomiast po wpisaniu polecenia ping 213.180.141.140 (adres IP serwera www.onet.pl) użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tego zjawiska?

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

ARP (Address Resolution Protocol) to protokół, który pozwala na konwersję

Jakie polecenie w systemie Linux jest używane do planowania zadań?

Który z podanych adresów IP v.4 należy do klasy C?

Jaką liczbę podwójnych gniazd RJ45 należy zainstalować w pomieszczeniu o wymiarach 8 x 5 m, aby spełniać wymagania normy PN-EN 50173?

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Wskaż program do składu publikacji

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

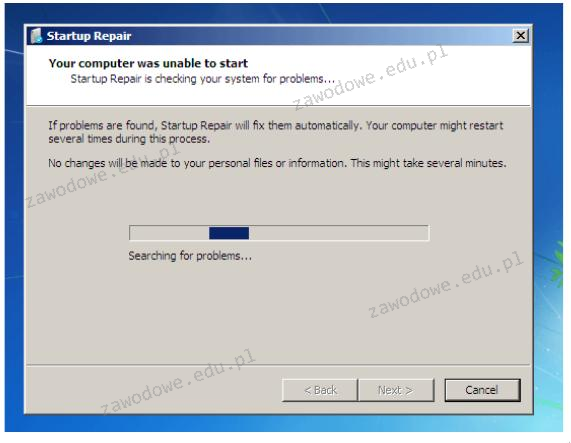

Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

W drukarce laserowej do stabilizacji druku na papierze używane są

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej