Pytanie 1

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Rodzajem pamięci RAM, charakteryzującym się minimalnym zużyciem energii, jest

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

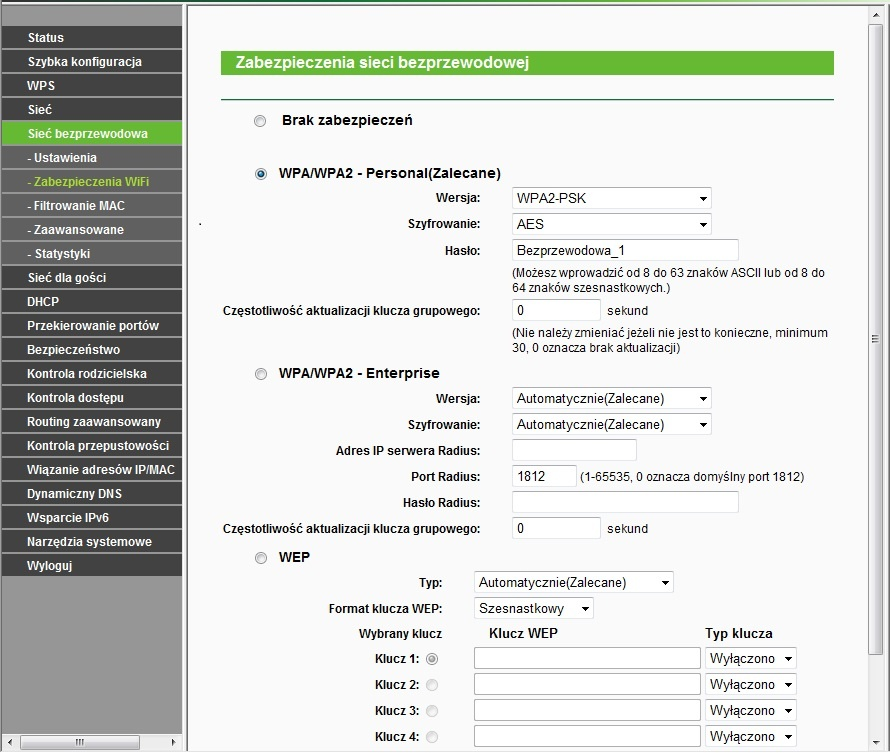

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Jakie urządzenie w sieci lokalnej NIE ROZDZIELA obszaru sieci komputerowej na domeny kolizyjne?

Jak nazywa się standard podstawki procesora bez nóżek?

Aby umożliwić jedynie wybranym urządzeniom dostęp do sieci WiFi, konieczne jest w punkcie dostępowym

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Jak należy postąpić z wiadomością e-mail od nieznanej osoby, która zawiera podejrzany załącznik?

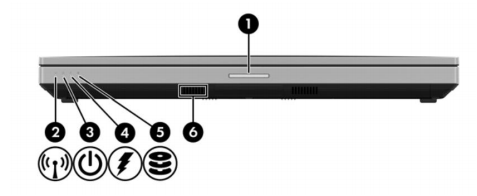

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?

Czym jest układ RAMDAC?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Jaką maskę domyślną mają adresy IP klasy B?

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

Jak nazywa się licencja w systemie Windows Server, która pozwala użytkownikom komputerów stacjonarnych na korzystanie z usług serwera?

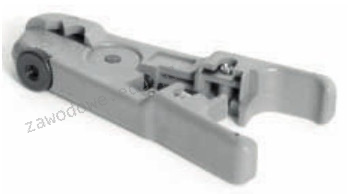

Narzędzie pokazane na ilustracji jest używane do weryfikacji

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Zgodnie z ustawą z 14 grudnia 2012 roku o odpadach, wymagane jest

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Norma opisująca standard transmisji Gigabit Ethernet to

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

AES (ang. Advanced Encryption Standard) to?

Jakie urządzenie elektroniczne ma zdolność do magazynowania ładunku elektrycznego?

Jak nazywa się interfejs wewnętrzny w komputerze?

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Na ilustracji zaprezentowane jest urządzenie do

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju