Pytanie 1

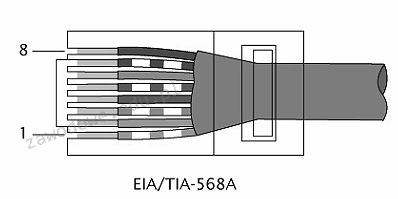

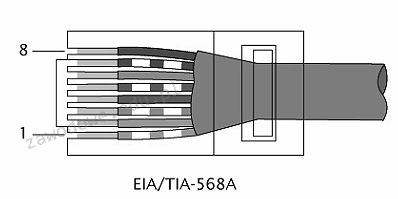

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Który z poniższych adresów IPv4 należy do klasy C?

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

Jak brzmi pełna wersja adresu IPv6 2001:0:db8::1410:80ab?

Na stronie wydrukowanej na drukarce laserowej pojawiają się jaśniejsze i ciemniejsze obszary. Aby rozwiązać problemy z nieciągłością i jakością wydruku, należy

Na załączonym zdjęciu znajduje się

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Które złącze powinna posiadać karta graficzna, aby można było bezpośrednio ją połączyć z telewizorem LCD wyposażonym wyłącznie w analogowe złącze do podłączenia komputera?

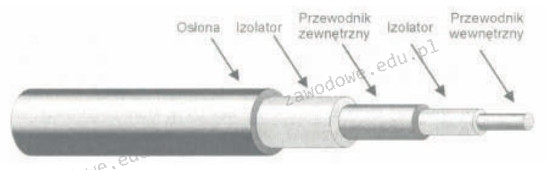

Na ilustracji przedstawiono przekrój kabla

Wykorzystanie polecenia net accounts w konsoli systemu Windows, które ustawia maksymalny okres ważności hasła, wymaga zastosowania opcji

W firmie konieczne jest regularne wykonywanie kopii zapasowych znacznych ilości danych, które znajdują się na serwerze, osiągających kilka set GB. Jakie urządzenie będzie najbardziej odpowiednie do realizacji tego zadania?

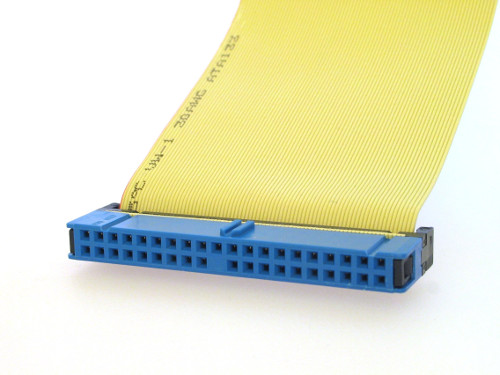

Na ilustracji pokazano wtyczkę taśmy kabel)

Thunderbolt to interfejs

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

Jaki protokół umożliwia terminalowe połączenie zdalne z urządzeniami, zapewniając przy tym transfer danych w sposób zaszyfrowany?

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

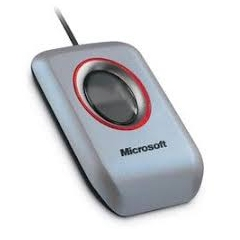

Urządzenie pokazane na ilustracji jest przeznaczone do

Narzędziem stosowanym do osadzania w trudno dostępnych miejscach niewielkich rozmiarowo elementów, takich jak na przykład zworki, jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Narzędzie diagnostyczne tracert służy do ustalania

Serwis serwerowy, który pozwala na udostępnianie usług drukowania w systemie Linux oraz plików dla stacji roboczych Windows, to

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Jaki jest maksymalny promień zgięcia przy montażu kabla U/UTP kat 5e?

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

W architekturze sieci lokalnych opartej na modelu klient - serwer

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować