Pytanie 1

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Program, który ocenia wydajność zestawu komputerowego, to

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Która z licencji pozwala każdemu użytkownikowi na wykorzystywanie programu bez ograniczeń związanych z prawami autorskimi?

Do sprawdzenia, czy w okablowaniu występują odwrócone pary przewodów, stosowany jest test

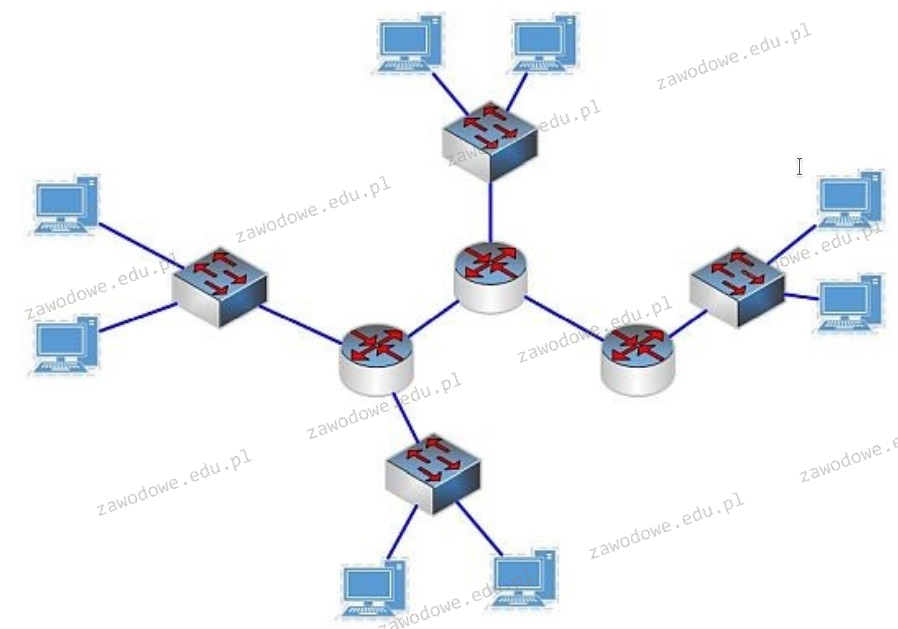

Na diagramie przedstawione są symbole

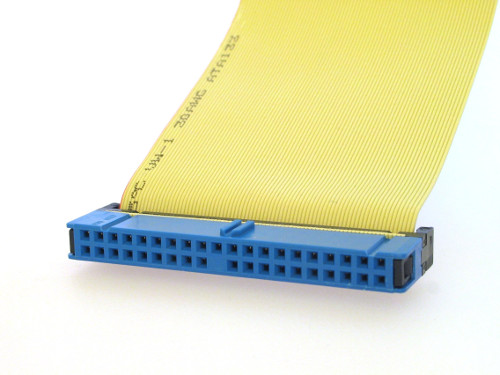

Na ilustracji pokazano wtyczkę taśmy kabel)

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Gdy chce się, aby jedynie wybrane urządzenia mogły uzyskiwać dostęp do sieci WiFi, należy w punkcie dostępowym

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

Według normy JEDEC, napięcie zasilające dla modułów pamięci RAM DDR3L wynosi

W systemie SI jednostką do mierzenia napięcia jest

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Karta sieciowa w standardzie Fast Ethernet umożliwia przesył danych z maksymalną prędkością

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

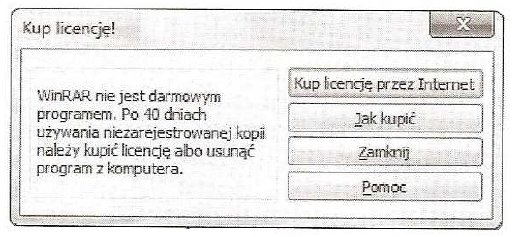

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Rodzaj systemu plików, który w systemie Windows pozwala na kompresję danych oraz przydzielanie uprawnień do plików i folderów, to

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Jaki protokół umożliwia terminalowe połączenie zdalne z urządzeniami, zapewniając przy tym transfer danych w sposób zaszyfrowany?

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

Farad to jednostka

Jaką usługę należy aktywować w sieci, aby stacja robocza mogła automatycznie uzyskać adres IP?

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Jaką maksymalną wartość rozplotu kabla UTP można uzyskać we wtyku RJ45 według normy PN-EN 50173?

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką normę odnosi się do okablowania strukturalnego?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?