Pytanie 1

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Komunikat o błędzie KB/Interface, wyświetlany na monitorze komputera podczas BIOS POST firmy AMI, wskazuje na problem

Przydzielanie przestrzeni dyskowej w systemach z rodziny Windows

Czym charakteryzuje się technologia Hot swap?

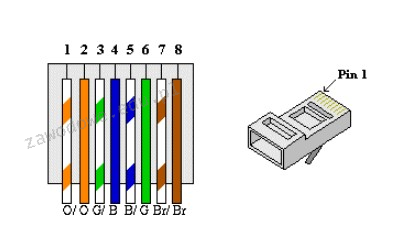

Na rysunku przedstawiono schemat ethernetowego połączenia niekrosowanych, ośmiopinowych złączy 8P8C. Jaką nazwę nosi ten schemat?

Jakie jest główne zadanie programu Wireshark?

Watomierz jest stosowany do pomiaru

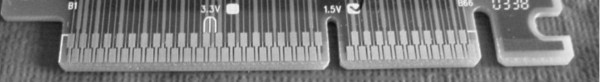

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Aby zmagazynować 10 GB danych na pojedynczej płycie DVD, jaki typ nośnika powinien być wykorzystany?

W cenniku usług informatycznych znajdują się poniższe wpisy. Jaki będzie koszt dojazdu serwisanta do klienta, który mieszka poza miastem, w odległości 15km od siedziby firmy?

| Dojazd do klienta na terenie miasta – 25 zł netto |

| Dojazd do klienta poza miastem – 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony. |

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Moc zasilacza wynosi 450 W, co oznacza, że

Aplikacja komputerowa, która umożliwia zarządzanie plikami oraz folderami, to:

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

Z jakim protokołem związane są terminy 'sequence number' oraz 'acknowledgment number'?

Sequence number: 117752 (relative sequence number) Acknowledgment number: 33678 (relative ack number) Header Length: 20 bytes Flags: 0x010 (ACK) Window size value: 258

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

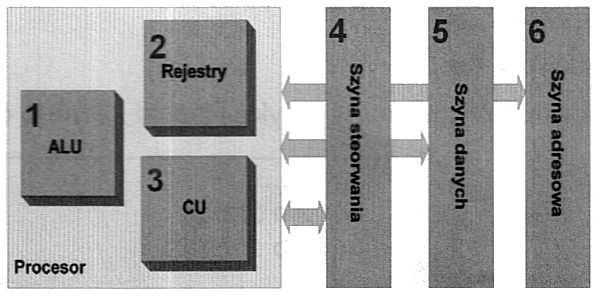

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?

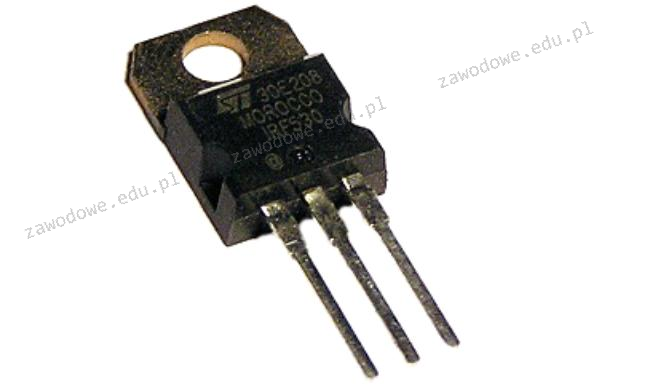

Element elektroniczny przedstawiony na ilustracji to

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Protokół, który zajmuje się identyfikowaniem i usuwaniem kolizji w sieciach Ethernet, to

Na ilustracji zaprezentowano układ

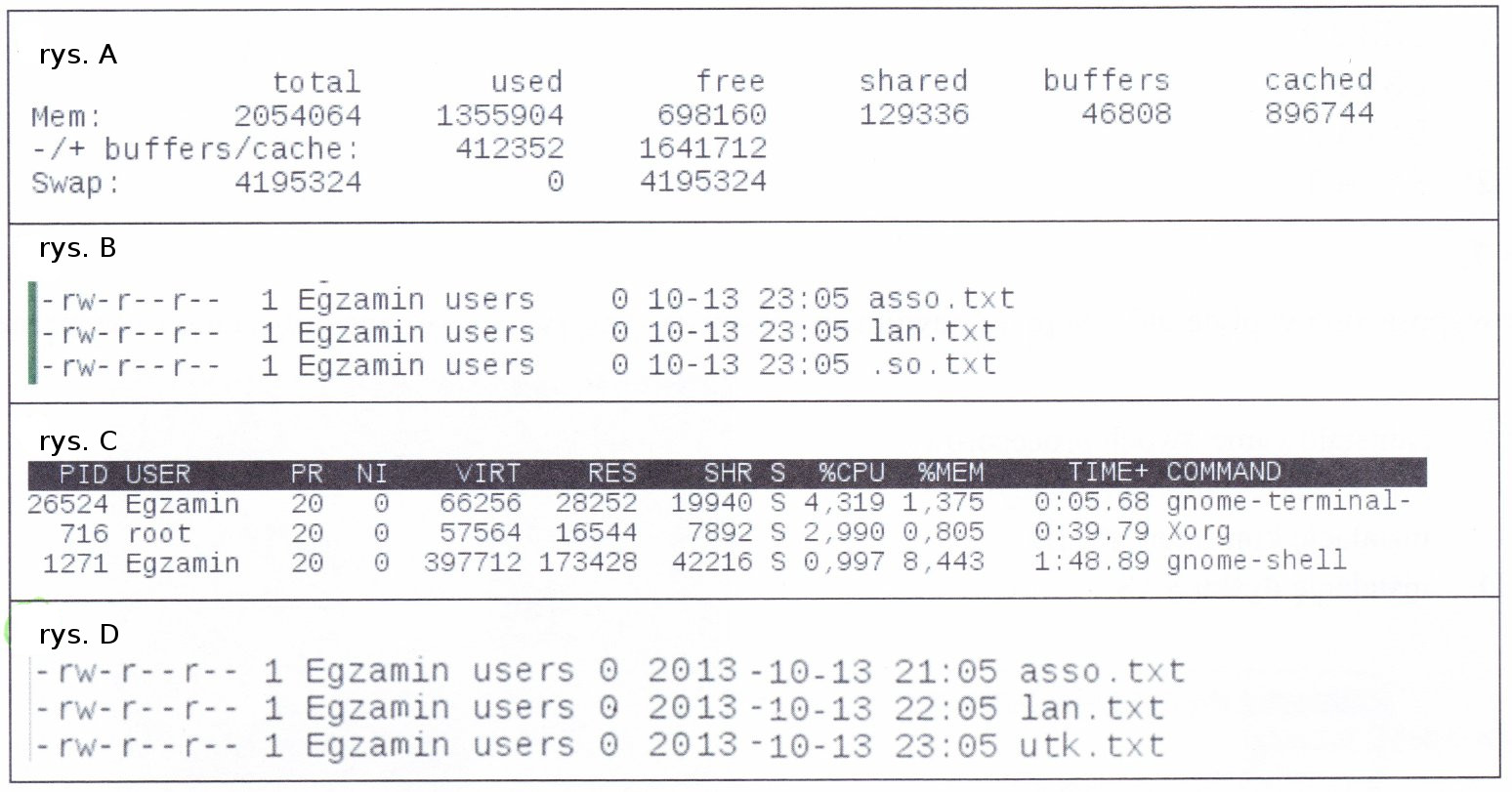

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

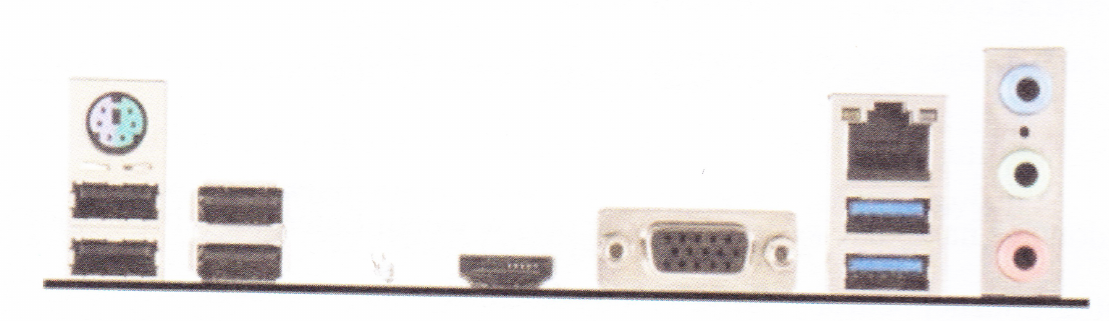

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Która karta graficzna nie będzie współpracowała z monitorem, wyposażonym w złącza przedstawione na zdjęciu (zakładając, że do podłączenia monitora nie można zastosować adaptera)?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Które z urządzeń sieciowych jest przedstawione na grafice?

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Możliwość weryfikacji poprawności działania pamięci RAM można uzyskać za pomocą programu diagnostycznego

Przedstawiony listing zawiera polecenia umożliwiające:

Switch>enable Switch#configure terminal Switch(config)#interface range fastEthernet 0/1-10 Switch(config-if-range)#switchport access vlan 10 Switch(config-if-range)#exit

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

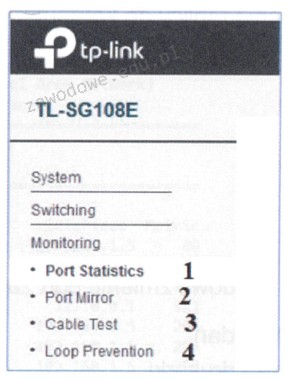

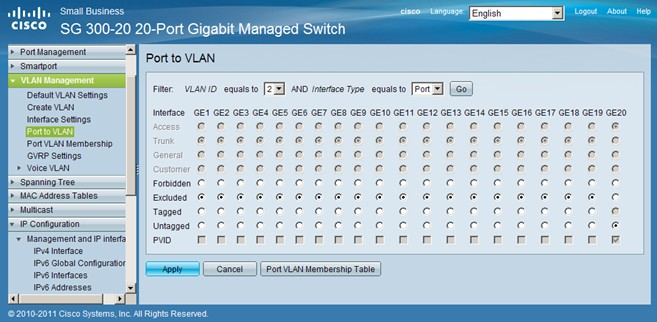

Aby sprawdzić stan podłączonego kabla oraz zdiagnozować odległość do miejsca awarii w sieci, należy użyć funkcji przełącznika oznaczonej numerem