Pytanie 1

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Wskaż technologię stosowaną do dostarczania Internetu, która jest połączona z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego.

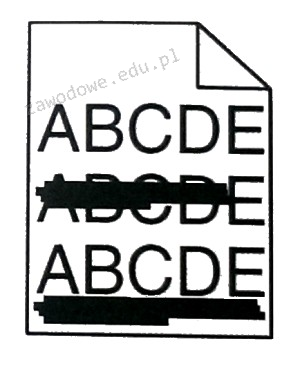

Źródłem problemu z wydrukiem z przedstawionej na rysunku drukarki laserowej jest

Na ilustracji przedstawiono ustawienie karty sieciowej, której adres MAC wynosi

Ethernet adapter VirtualBox Host-Only Network:

Connection-specific DNS Suffix . :

Description . . . . . . . . . . . : VirtualBox Host-Only Ethernet Adapter

Physical Address. . . . . . . . . : 0A-00-27-00-00-07

DHCP Enabled. . . . . . . . . . . : No

Autoconfiguration Enabled . . . . : Yes

Link-local IPv6 Address . . . . . : fe80::e890:be2b:4c6c:5aa9%7(Preferred)

IPv4 Address. . . . . . . . . . . : 192.168.56.1(Preferred)

Subnet Mask . . . . . . . . . . . : 255.255.255.0

Default Gateway . . . . . . . . . :

DHCPv6 IAID . . . . . . . . . . . : 134873127

DHCPv6 Client DUID. . . . . . . . : 00-01-00-01-1F-04-2D-93-00-1F-D0-0C-7B-12

DNS Servers . . . . . . . . . . . : fec0:0:0:ffff::1%1

fec0:0:0:ffff::2%1

fec0:0:0:ffff::3%1

NetBIOS over Tcpip. . . . . . . . : EnabledPCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

W dokumentacji powykonawczej dotyczącej fizycznej i logicznej struktury sieci lokalnej powinien znajdować się

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Po włączeniu komputera wyświetlił się komunikat: "non-system disk or disk error. Replace and strike any key when ready". Jakie mogą być przyczyny?

Podczas realizacji procedury POST na wyświetlaczu ukazuje się komunikat "CMOS Battery State Low". Jakie kroki należy podjąć, aby uniknąć pojawiania się tego komunikatu w przyszłości?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W tabeli przedstawiono dane katalogowe procesora AMD Athlon 1333 Model 4 Thunderbird. Jaka jest częstotliwość przesyłania danych między rejestrami?

| General information | |

|---|---|

| Type | CPU / Microprocessor |

| Market segment | Desktop |

| Family | AMD Athlon |

| CPU part number | A1333AMS3C |

| Stepping codes | AYHJA AYHJAR |

| Frequency (MHz) | 1333 |

| Bus speed (MHz) | 266 |

| Clock multiplier | 10 |

| Gniazdo | Socket A (Socket 462) |

| Notes on AMD A1333AMS3C | |

| ○ Actual bus frequency is 133 MHz. Because the processor uses Double Data Rate bus the effective bus speed is 266 MHz. | |

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Wartość liczby BACA w systemie heksadecymalnym to liczba

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Narzędzie pokazane na ilustracji służy do

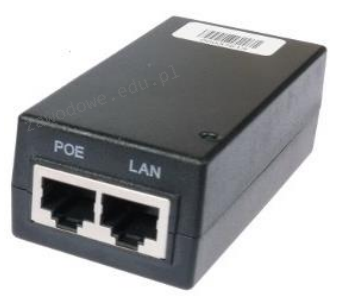

Urządzenie pokazane na ilustracji służy do

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

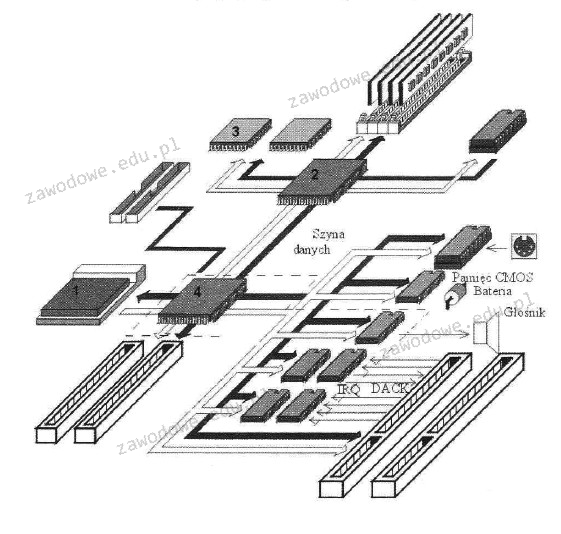

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Liczba 5110 w zapisie binarnym wygląda jak

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

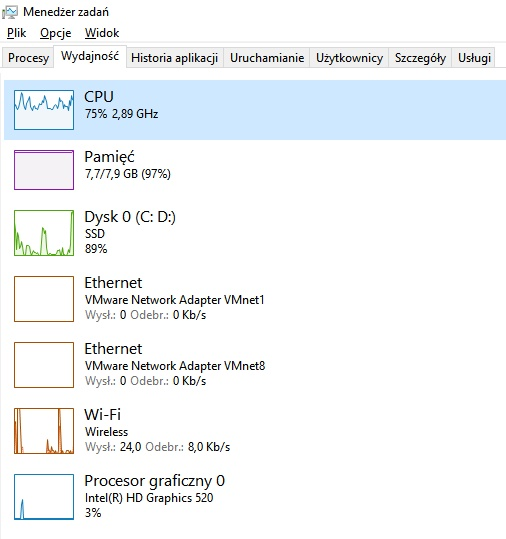

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

Kondygnacyjny punkt dystrybucji jest połączony z

Port AGP służy do łączenia

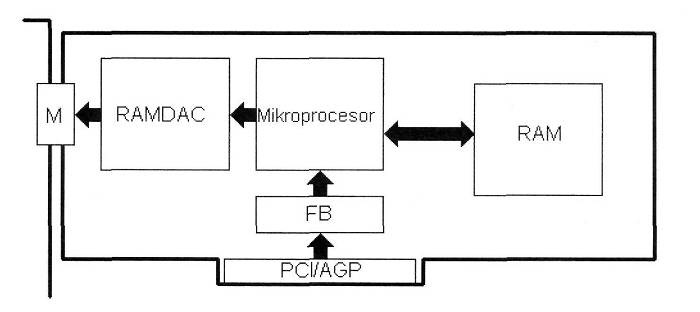

Na schemacie blokowym funkcjonalny blok RAMDAC ilustruje

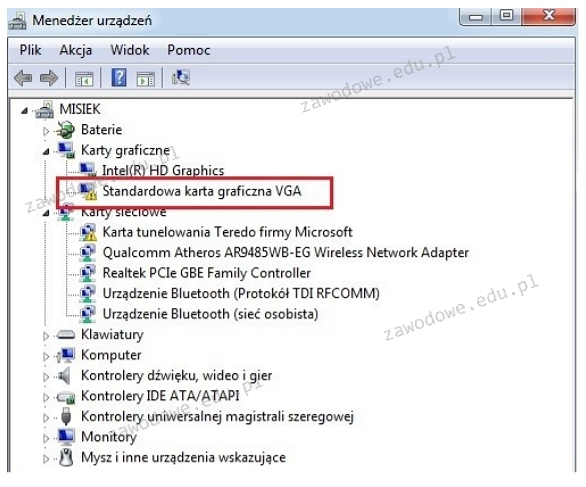

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Najlepszym narzędziem służącym do podgrzania znajdującego się na karcie graficznej elementu SMD, który ma zostać usunięty, jest