Pytanie 1

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi przedstawione na rysunku. Przy konfiguracji połączenia z siecią Z1 musi określić dla tej sieci

Jakie urządzenie sieciowe umożliwia połączenie lokalnej sieci LAN z rozległą siecią WAN?

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Medium transmisyjne oznaczone symbolem S/FTP wskazuje na skrętkę

Największą pojemność spośród nośników optycznych posiada płyta

Do konwersji kodu źródłowego na program wykonywalny używany jest

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Który z protokołów pełni rolę protokołu połączeniowego?

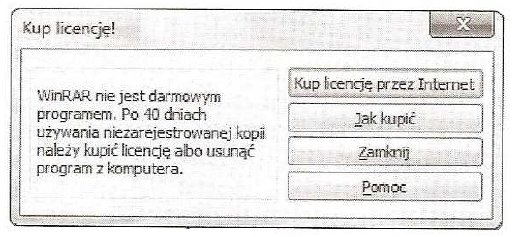

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Co oznacza standard ACPI w BIOSie komputera?

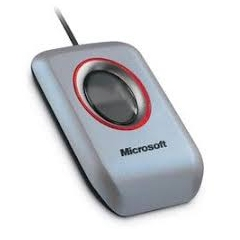

Na zdjęciu widoczny jest

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

GRUB, LILO oraz NTLDR to:

Która z usług pozwala na zdalne zainstalowanie systemu operacyjnego?

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Gdy użytkownik wpisuje w przeglądarkę internetową adres www.egzamin.pl, nie ma możliwości otwarcia strony WWW, natomiast wprowadzenie adresu 211.0.12.41 umożliwia dostęp do niej. Problem ten spowodowany jest brakiem skonfigurowanego serwera

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Który z protokołów służy do synchronizacji czasu?

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Jaki jest największy rozmiar pojedynczego datagramu IPv4, uwzględniając jego nagłówek?

Jaki protokół do obsługi poczty elektronicznej pozwala na przykład na przechowywanie odebranych e-maili na serwerze, zarządzanie różnymi folderami, usuwanie wiadomości oraz przenoszenie ich pomiędzy folderami?

Jakie jest standardowe połączenie między skanerem a aplikacją graficzną?

Na zdjęciu widać

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Wskaż rysunek ilustrujący kondensator stały?

Liczby 1001 i 100 w wierszu pliku /etc/passwd reprezentują

W programie Explorator systemu Windows, naciśnięcie klawisza F5 zazwyczaj powoduje wykonanie następującej operacji:

Funkcja failover usługi DHCP umożliwia

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?