Pytanie 1

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Aby utworzyć obraz dysku twardego, można skorzystać z programu

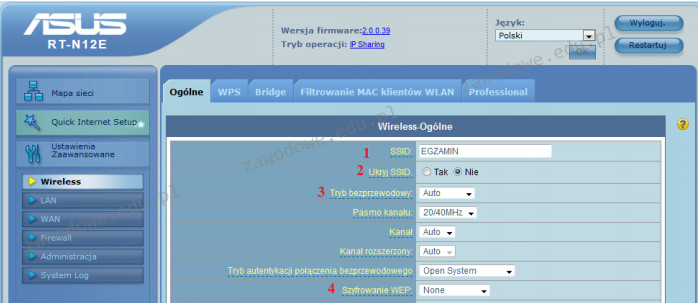

Aby zatuszować identyfikator sieci bezprzewodowej, należy zmodyfikować jego ustawienia w ruterze w polu oznaczonym numerem

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

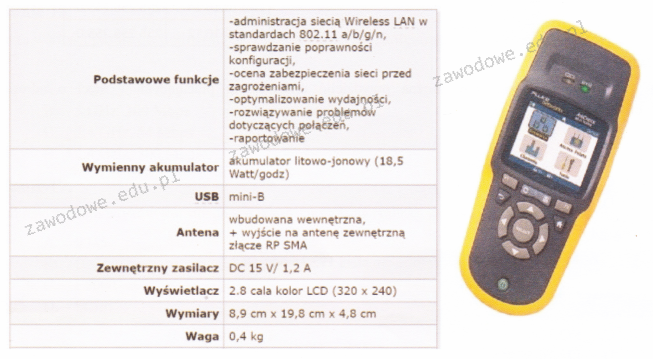

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

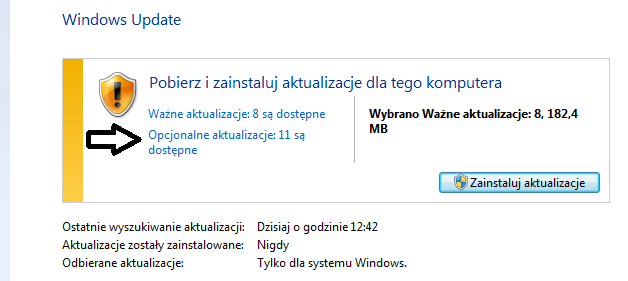

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Liczba BACA zapisana w systemie heksadecymalnym odpowiada liczbie

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

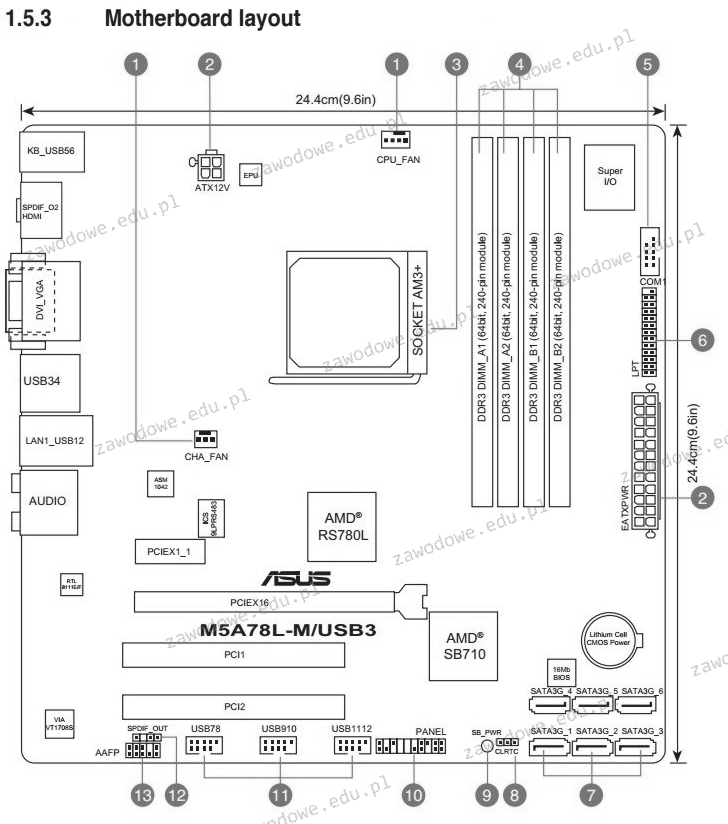

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

Ile par przewodów miedzianej skrętki kategorii 5e jest używanych do transmisji danych w standardzie sieci Ethernet 100Base-TX?

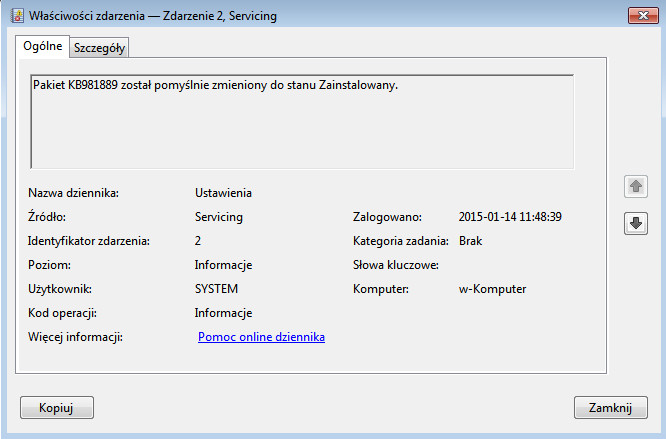

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

Na rysunku ukazany jest diagram blokowy zasilacza

Komputer posiada mysz bezprzewodową, ale kursor nie porusza się gładko, tylko "skacze" na ekranie. Możliwą przyczyną problemu z urządzeniem może być

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Spuchnięte kondensatory elektrolityczne w sekcji zasilania monitora LCD mogą spowodować uszkodzenie

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

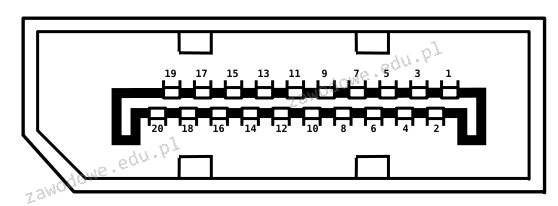

Na ilustracji pokazano złącze:

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Na przedstawionym schemacie wtyk (złącze męskie modularne) stanowi zakończenie kabla

Aby skonfigurować wolumin RAID 5 na serwerze, wymagane jest minimum

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy oczyścić

RAMDAC konwerter przekształca sygnał

Na ilustracji przedstawiono sieć komputerową w danej topologii