Pytanie 1

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

Prezentowany komunikat pochodzi z wykonania polecenia

Który z poniższych programów NIE służy do testowania sieci komputerowej w celu wykrywania problemów?

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

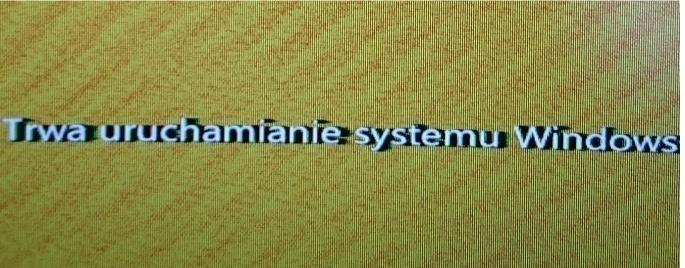

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

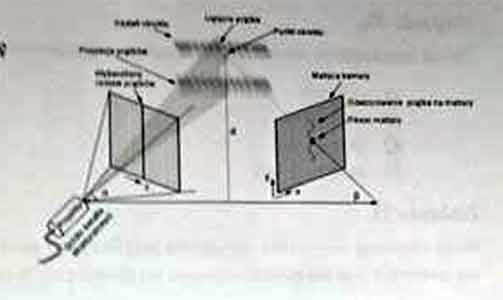

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Jakie polecenie pozwala na uzyskanie adresów fizycznych dla kart sieciowych w systemie?

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

W systemach Microsoft Windows komenda netstat -a pokazuje

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem

Narzędzie diagnostyczne tracert służy do ustalania

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Jakie jest zadanie programu Wireshark?

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Jakiego protokołu sieciowego używa się do określenia mechanizmów zarządzania urządzeniami w sieci?

Termin "PIO Mode" odnosi się do trybu operacyjnego

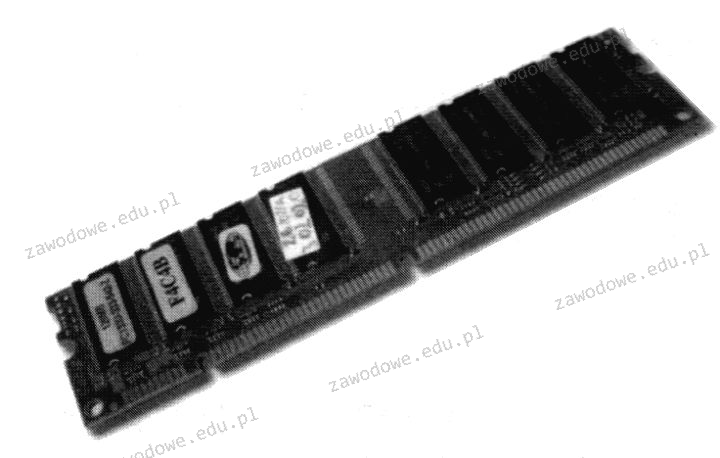

Na fotografii ukazana jest pamięć o 168 stykach

Korzystając z podanego urządzenia, możliwe jest przeprowadzenie analizy działania

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Które z poniższych stwierdzeń dotyczących konta użytkownika Active Directory w systemie Windows jest prawdziwe?

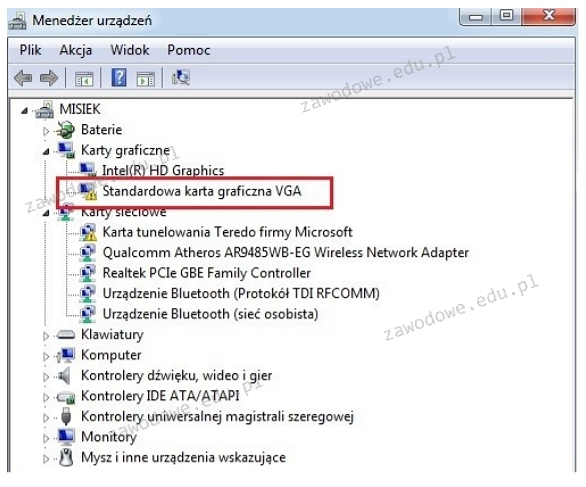

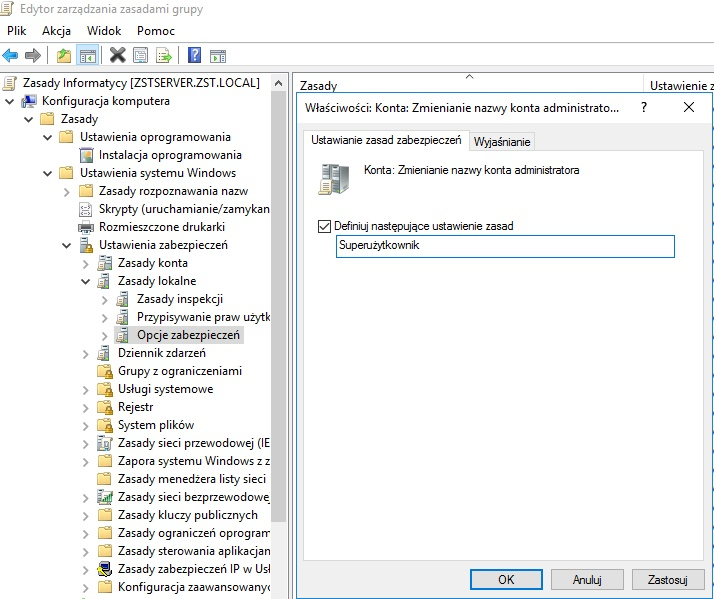

Rezultatem działania przedstawionego na ilustracji okna jest

Podczas procesu zamykania systemu operacyjnego na wyświetlaczu pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zakończenie pracy systemu, spowodowane brakiem pamięci. Co może sugerować ten błąd?

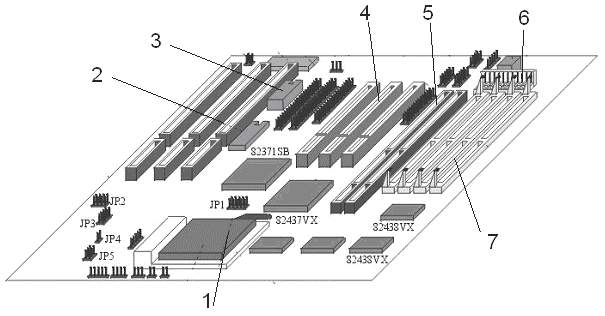

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?

Prezentowana usterka ekranu laptopa może być spowodowana

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Wskaż cechę platformy wirtualizacji Hyper-V.

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?