Pytanie 1

PoE to norma

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

PoE to norma

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

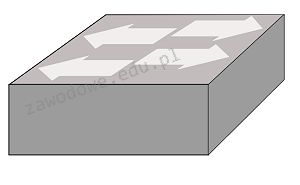

Na zamieszczonym zdjęciu widać

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

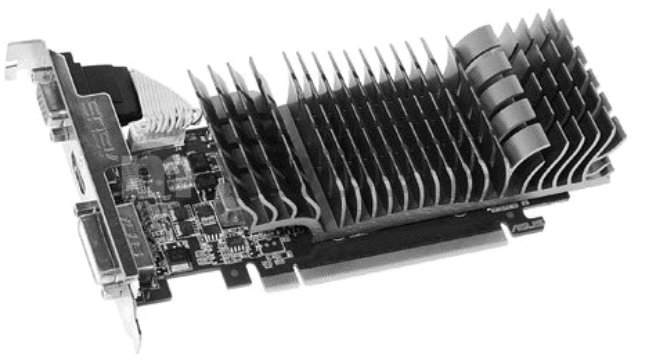

Karta rozszerzeń zaprezentowana na rysunku ma system chłodzenia

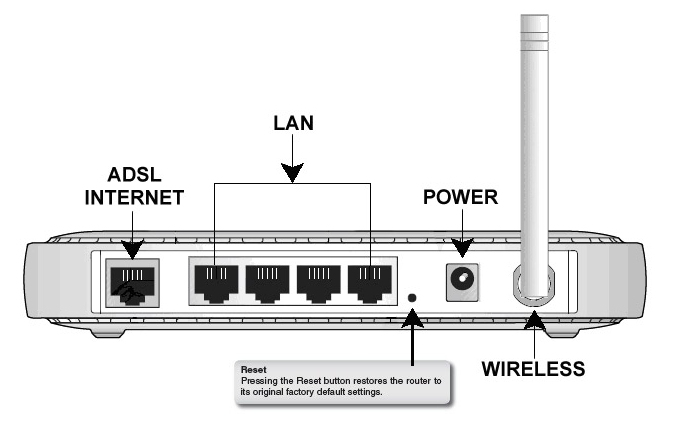

Przycisk znajdujący się na obudowie rutera, którego charakterystyka została podana w ramce, służy do

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

Wirusy polimorficzne mają jedną charakterystyczną cechę, którą jest

Na ilustracji ukazano złącze zasilające

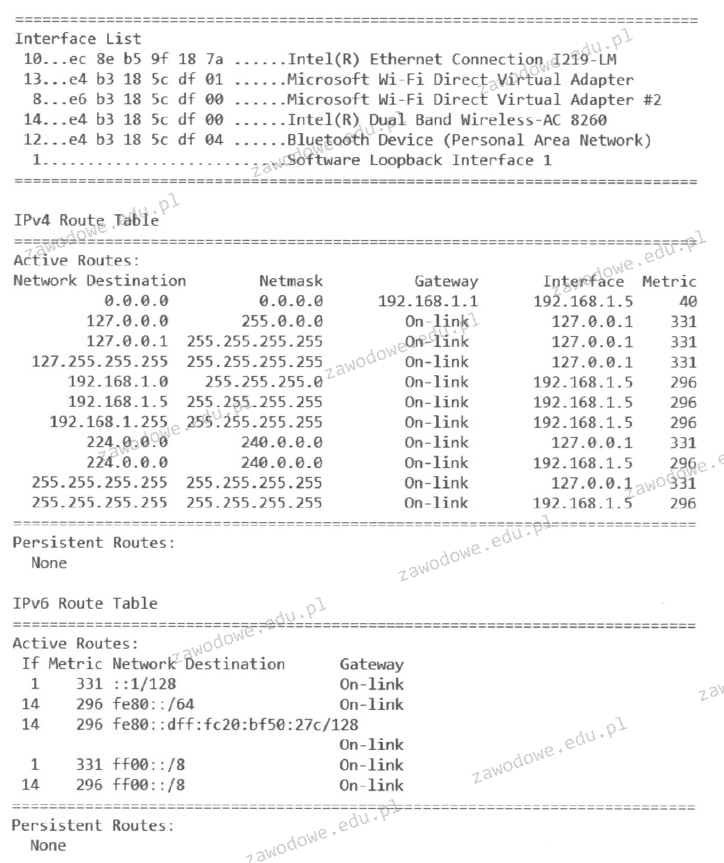

Informacje, które zostały pokazane na wydruku, uzyskano w wyniku wykonania

Oznaczenie CE świadczy o tym, że

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Ataki na systemy komputerowe, które odbywają się poprzez podstępne pozyskiwanie od użytkowników ich danych osobowych, często wykorzystywane są w postaci fałszywych komunikatów z różnych instytucji lub od dostawców usług e-płatności i innych znanych organizacji, to

Jakiego rodzaju interfejsem jest UDMA?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Aby zweryfikować indeks stabilności systemu Windows Server, należy zastosować narzędzie

Plik ma wielkość 2 KiB. Co to oznacza?

Aby zapewnić komputerowi otrzymanie konkretnego adresu IP od serwera DHCP, należy na serwerze ustalić

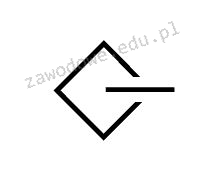

Graficzny symbol pokazany na ilustracji oznacza

Zapisany symbol dotyczy urządzeń

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Jakie jest właściwe IP dla maski 255.255.255.0?

Przydzielaniem adresów IP w sieci zajmuje się serwer

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Kiedy użytkownik systemu Windows wybiera opcję przywrócenia do określonego punktu, które pliki utworzone po tym punkcie nie będą podlegać zmianom w wyniku tej operacji?

Który protokół jest używany do zdalnego zarządzania komputerem przez terminal w systemach Linux?

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

ACPI to akronim, który oznacza

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności

Przesyłanie informacji przy użyciu fal radiowych w pasmie ISM odbywa się w standardzie

Aby wyświetlić przedstawioną informację o systemie Linux w terminalu, należy użyć polecenia

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Który symbol wskazuje na zastrzeżenie praw autorskich?