Pytanie 1

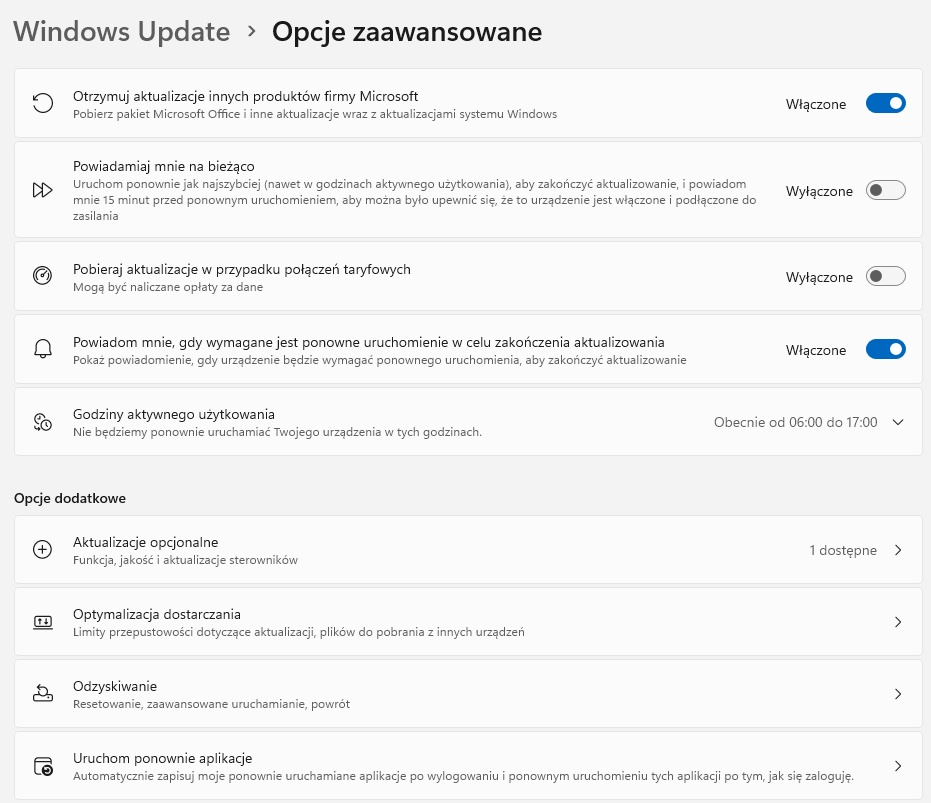

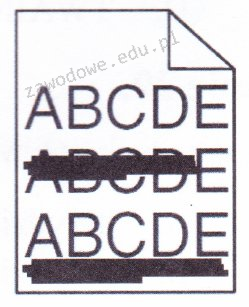

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

W architekturze sieci lokalnych opartej na modelu klient-serwer

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

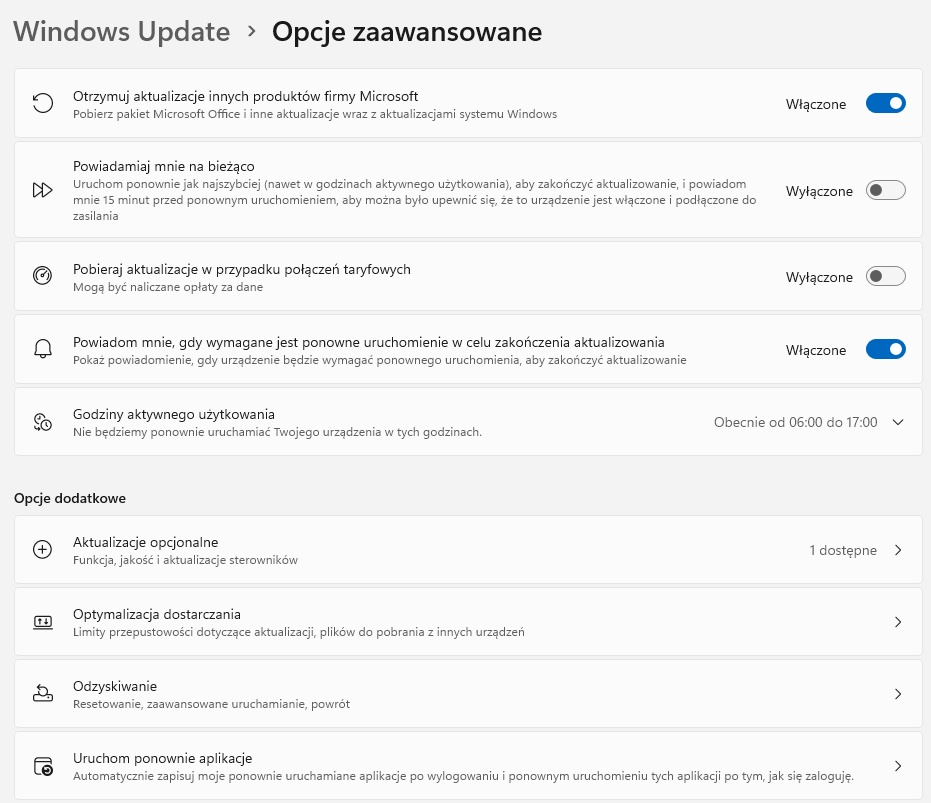

Jakiego rodzaju fizycznej topologii sieci komputerowej dotyczy przedstawiony obrazek?

Standard IEEE 802.11b dotyczy typu sieci

W jakiej fizycznej topologii sieci komputerowej każdy węzeł ma łączność fizyczną z każdym innym węzłem w sieci?

Rozmiar plamki na monitorze LCD wynosi

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

Jakie medium transmisyjne jest związane z adapterem przedstawionym na ilustracji?

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

Które polecenie w systemie Windows Server 2008 pozwala na przekształcenie serwera w kontroler domeny?

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Magistrala PCI-Express stosuje do przesyłania danych metodę komunikacji

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

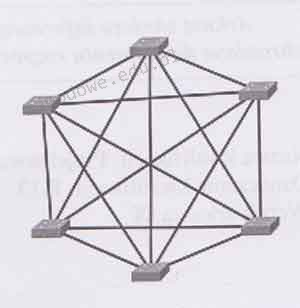

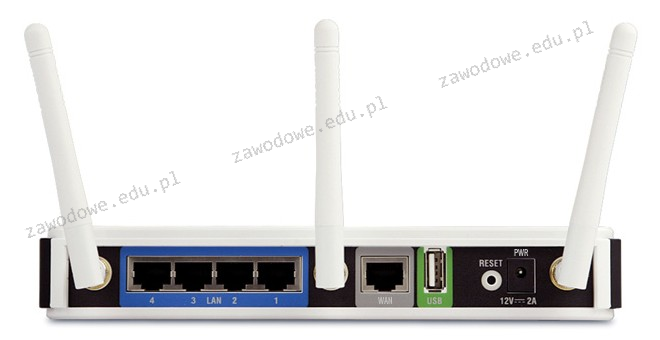

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Zadania systemu operacyjnego nie obejmują

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Wykonanie polecenia attrib +h +s +r przykład.txt w konsoli systemu Windows spowoduje

Jakie polecenie należy użyć w systemie Windows, aby przeprowadzić śledzenie trasy pakietów do serwera internetowego?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Jakie napięcie zasilające mają pamięci DDR2?

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

W trakcie użytkowania drukarki laserowej blady wydruk lub nierównomierne pokrycie medium drukującego mogą wskazywać na

Co może być przyczyną problemów z wydrukiem z drukarki laserowej przedstawionych na ilustracji?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |