Pytanie 1

Badanie przewodu pokarmowego metodą podwójnego kontrastu wiąże się z podaniem pacjentowi

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Badanie przewodu pokarmowego metodą podwójnego kontrastu wiąże się z podaniem pacjentowi

W badaniu PETCT radioizotop ulega

W radiografii mianem SID określa się

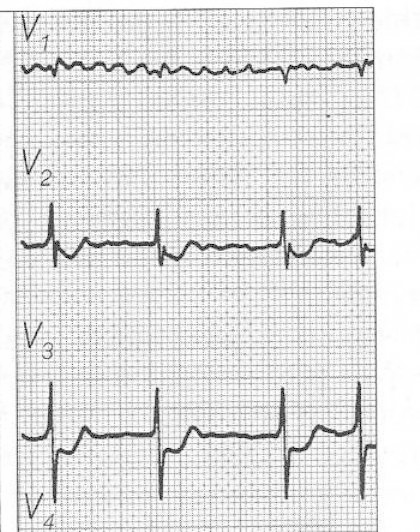

Zamieszczony elektrokardiogram przedstawia

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

W systemie międzynarodowym ząb pierwszy przedtrzonowy po stronie lewej oznacza się symbolem

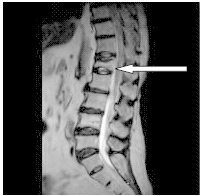

Na obrazie rezonansu magnetycznego strzałką oznaczono patologiczny kręg

W jakiej pozycji układa się pacjenta do standardowego badania MR kręgosłupa szyjnego?

Koronarografia jest radiologicznym zabiegiem diagnostycznym pozwalającym ocenić drożność

Na scyntygramie tarczycy został uwidoczniony guzek

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Technikę bramkowania oddechowego stosuje się w badaniu MR

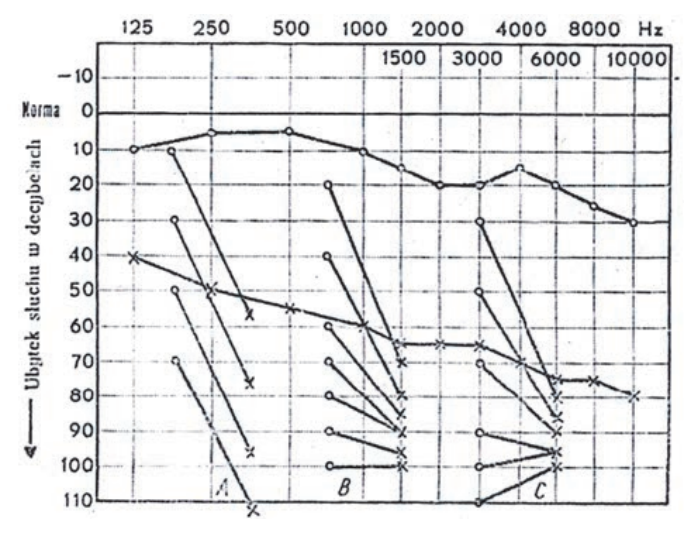

Audiogram przedstawia próbę

Kto jest odpowiedzialny za wykonywanie testów podstawowych kontroli jakości gammakamery w Zakładzie Medycyny Nuklearnej?

W lampie rentgenowskiej promieniowanie X powstaje w wyniku hamowania

Wskaż przyczynę powstania artefaktu widocznego na obrazie MR.

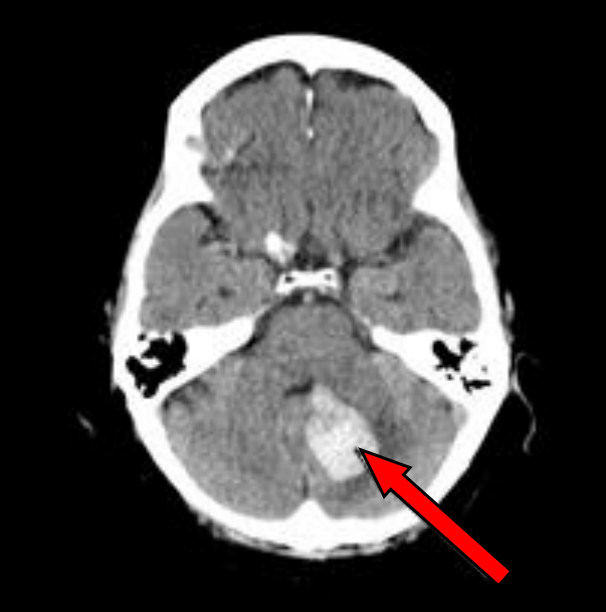

Na przekroju poprzecznym TK mózgu strzałką wskazano obszar

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Który system informatyczny służy do archiwizacji i transmisji obrazów radiologicznych?

Teleterapia polega na napromienowaniu

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

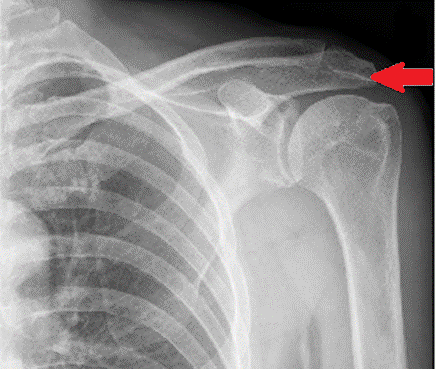

Na radiogramie stawu barkowego strzałką wskazano

W radiologii analogowej lampy rentgenowskiej z tubusem używa się do wykonania zdjęcia

Na radiogramie strzałką oznaczono

Kasety do pośredniej radiografii cyfrowej CR są wyposażone

Rytm alfa i beta rejestruje się podczas badania

Ile razy i jak zmieni się wartość natężenia promieniowania X przy zwiększeniu odległości OF ze 100 cm do 200 cm?

Który obszar napromieniania w radioterapii oznacza się skrótem PTV?

Który typ głowicy ultrasonograficznej przedstawiono na ilustracji?

DSA to cyfrowa

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

Jak zgodnie ze standardem należy ustawić pacjenta do badania rentgenowskiego w skosie tylnym prawym?

Który program wtórnej rekonstrukcji obrazów TK pozwala na odwzorowanie wnętrza jelita grubego, tchawicy i oskrzeli?

Na radiogramie stopy uwidocznione jest złamanie trzonu

Zadaniem technika elektroradiologii w pracowni badań naczyniowych jest

W zapisie EKG załamki P dodatnie w odprowadzeniu I i II, a ujemne w aVR oraz częstotliwość rytmu mniejsza niż 60/min wskazują na

W radioterapii konwencjonalnej pacjent jest leczony promieniowaniem pochodzącym

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

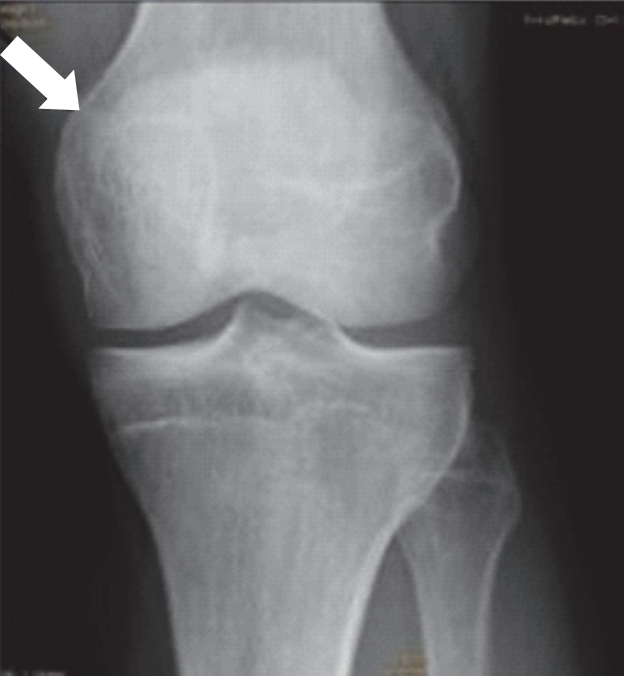

Którą strukturę anatomiczną zaznaczono na radiogramie stawu kolanowego?

Badanie polegające na wprowadzeniu cewnika przez pęcherz moczowy do moczowodu i miedniczki nerkowej i podaniu środka kontrastującego to