Pytanie 1

Wskaż urządzenie, które należy wykorzystać do połączenia drukarki wyposażonej w interfejs Wi-Fi z komputerem stacjonarnym bez interfejsu Wi-Fi, ale z interfejsem USB.

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Wskaż urządzenie, które należy wykorzystać do połączenia drukarki wyposażonej w interfejs Wi-Fi z komputerem stacjonarnym bez interfejsu Wi-Fi, ale z interfejsem USB.

Cienki klient (thin client) korzysta z protokołu

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

Wartości 1001 i 100 w pliku /etc/passwd wskazują na

| student:x:1001:100:Jan Kowalski:/home/student:/bin/bash |

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

Jakiego rodzaju adresację stosuje protokół IPv6?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Urządzeniem, które służy do wycinania kształtów oraz grawerowania między innymi w materiałach drewnianych, szklanych i metalowych, jest ploter

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

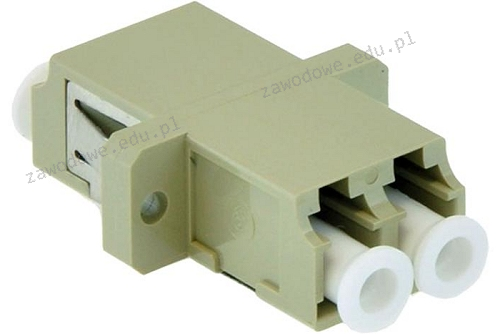

Z jakim medium transmisyjnym związany jest adapter przedstawiony na rysunku?

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

Jaki poziom macierzy RAID umożliwia równoległe zapisywanie danych na wielu dyskach działających jako jedno urządzenie?

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Jakie protokoły są klasyfikowane jako protokoły transportowe w modelu ISO/OSI?

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Autorskie prawo osobiste twórcy do programu komputerowego

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Możliwość weryfikacji poprawności działania pamięci RAM można uzyskać za pomocą programu diagnostycznego

W jakim miejscu są zapisane dane dotyczące kont użytkowników domenowych w systemach Windows Server?

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Topologia fizyczna sieci komputerowej przedstawiona na ilustracji to topologia

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

Urządzenie sieciowe, które umożliwia połączenie pięciu komputerów w tej samej sieci, eliminując kolizje pakietów, to

PoE to norma

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Czym jest układ RAMDAC?

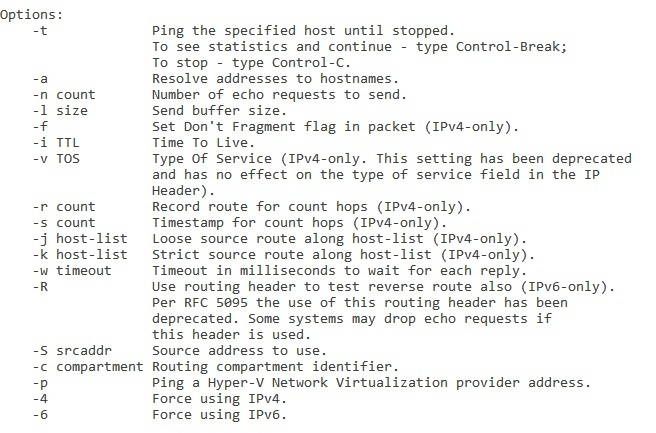

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

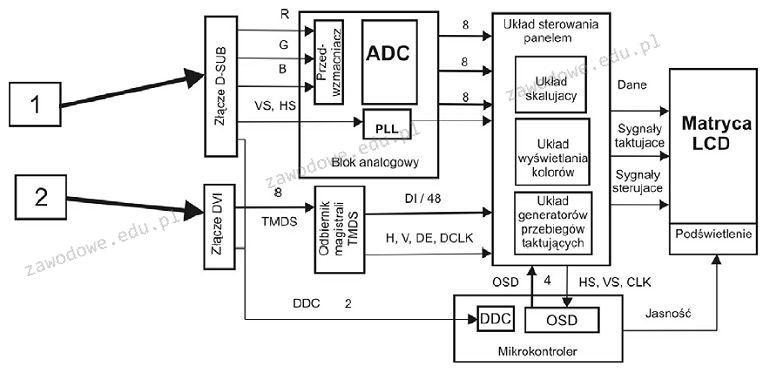

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Na ilustracji ukazano kartę

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Na ilustracji ukazano złącze zasilające

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

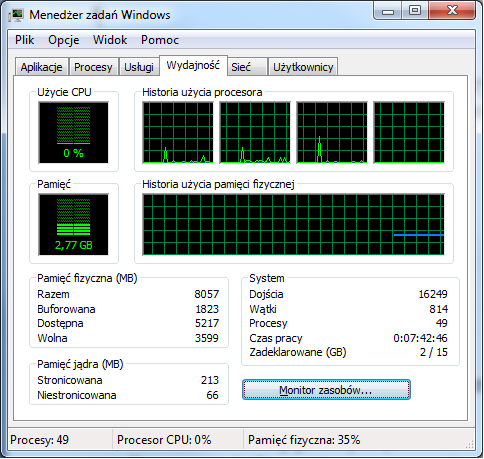

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

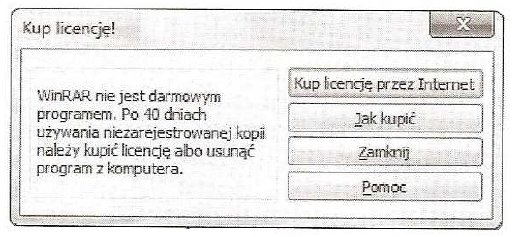

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?