Pytanie 1

Protokół trasowania wewnętrznego, który opiera się na analizie stanu łącza, to

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Protokół trasowania wewnętrznego, który opiera się na analizie stanu łącza, to

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Jaka jest maska dla adresu IP 192.168.1.10/8?

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Jakie z podanych urządzeń stanowi część jednostki centralnej?

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Metoda transmisji żetonu (ang. token) znajduje zastosowanie w topologii

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

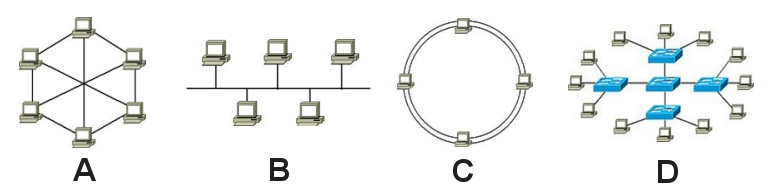

Który z rysunków ilustruje topologię sieci w układzie magistrali?

Wskaź narzędzie przeznaczone do mocowania pojedynczych żył kabla miedzianego w złączach?

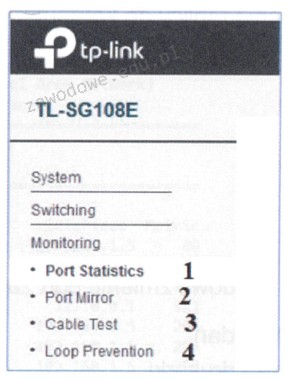

Aby sprawdzić stan podłączonego kabla oraz zdiagnozować odległość do miejsca awarii w sieci, należy użyć funkcji przełącznika oznaczonej numerem

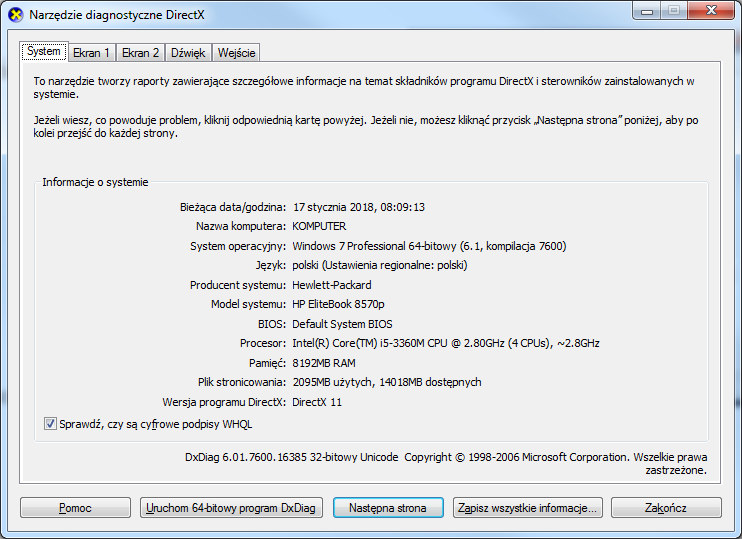

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Jakie jest znaczenie jednostki dpi, która występuje w specyfikacjach skanerów i drukarek?

Polecenie tar w systemie Linux służy do

W standardzie Ethernet 100BaseTX konieczne jest użycie kabli skręconych

Który z parametrów okablowania strukturalnego wskazuje na relację mocy sygnału testowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu przewodu?

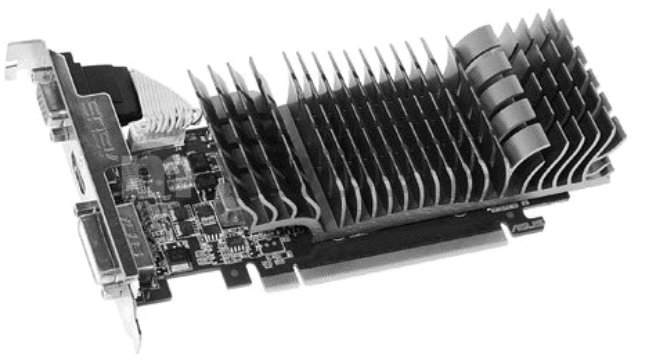

Karta rozszerzeń zaprezentowana na rysunku ma system chłodzenia

Procesor RISC to procesor o

Po uruchomieniu komputera, procedura POST wskazuje 512 MB RAM. Natomiast w ogólnych właściwościach systemu operacyjnego Windows wyświetla się wartość 480 MB RAM. Jakie są powody tej różnicy?

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

W jaki sposób powinny być skonfigurowane uprawnienia dostępu w systemie Linux, aby tylko właściciel mógł wprowadzać zmiany w wybranym katalogu?

Zanim przystąpisz do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, powinieneś zweryfikować

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Jaki adres IP w formacie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanym w formacie binarnym?

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Zestaw uzupełniający, składający się ze strzykawki z fluidem, igły oraz rękawiczek zabezpieczających, służy do uzupełnienia pojemników z nośnikiem drukującym w drukarkach

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

W które złącze, umożliwiające podłączenie monitora, wyposażona jest karta graficzna przedstawiona na ilustracji?

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

Narzędziem stosowanym do osadzania w trudno dostępnych miejscach niewielkich rozmiarowo elementów, takich jak na przykład zworki, jest

Wartość sumy liczb binarnych 1010 i 111 zapisana w systemie dziesiętnym to

Usługa, która odpowiada za przekształcanie nazw domenowych na adresy IP, to