Pytanie 1

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Który typ drukarki powinien być wykorzystany w dziale sprzedaży hurtowni materiałów budowlanych do tworzenia faktur na papierze samokopiującym, aby uzyskać kopie wydruku?

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Liczba 100110011 zapisana w systemie ósemkowym wynosi

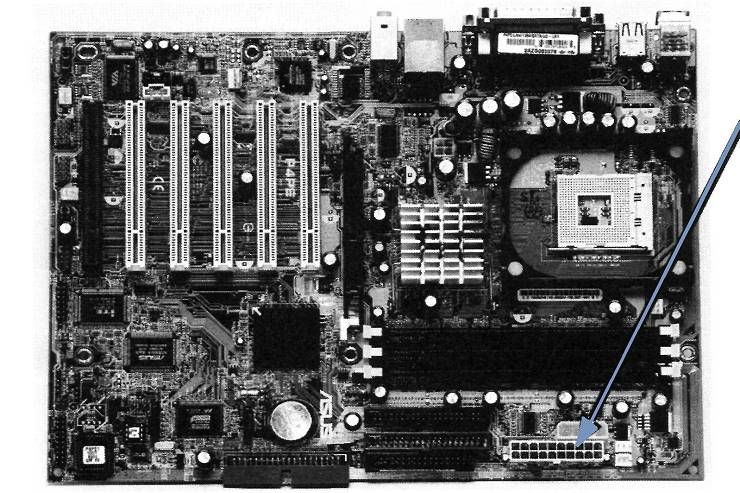

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

ile bajtów odpowiada jednemu terabajtowi?

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Podczas konserwacji i czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony indywidualnej

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

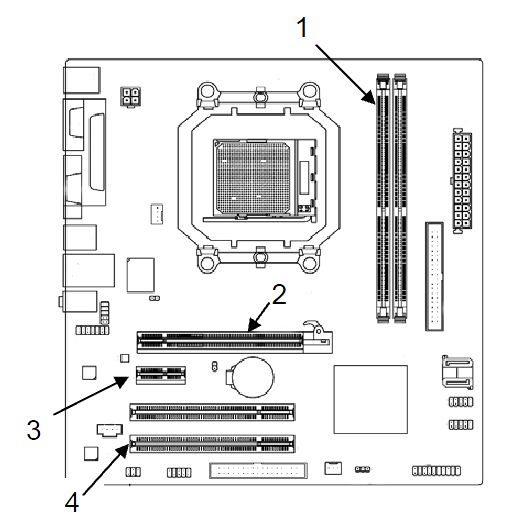

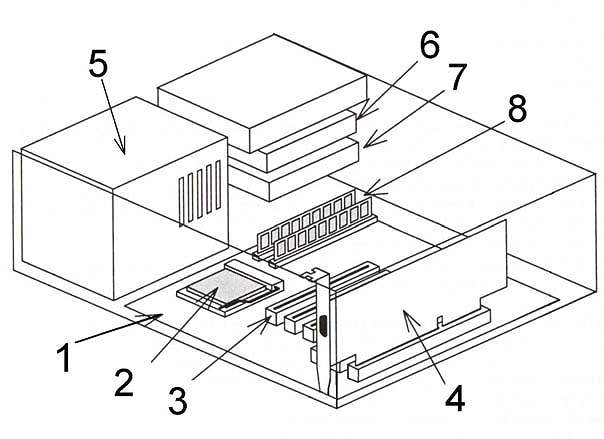

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Jakie rozwiązanie techniczne pozwala na transmisję danych z szybkością 1 Gb/s z zastosowaniem światłowodu?

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Norma opisująca standard transmisji Gigabit Ethernet to

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz 26-bitową maską?

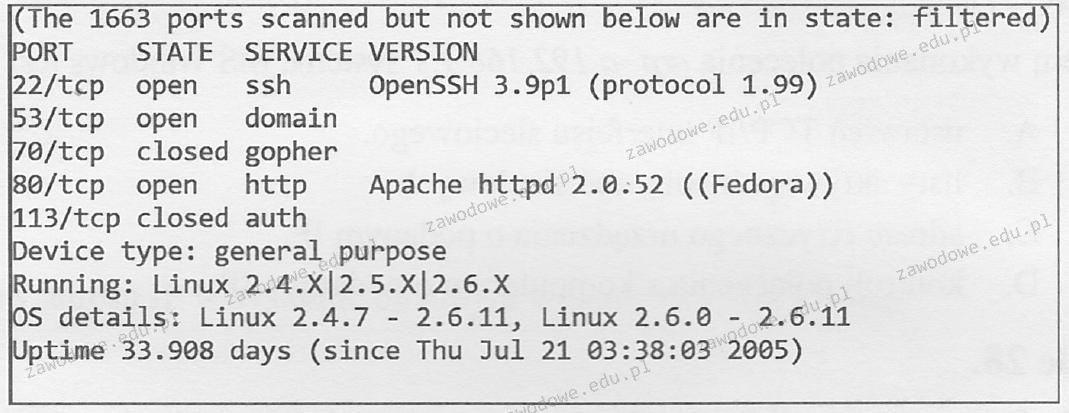

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

W topologii fizycznej w kształcie gwiazdy, wszystkie urządzenia działające w sieci są

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy oczyścić

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Na rysunku znajduje się graficzny symbol

W przypadku adresacji IPv6, zastosowanie podwójnego dwukropka służy do

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Aby komputer osobisty współpracował z urządzeniami korzystającymi z przedstawionych na rysunku złącz, należy wyposażyć go w interfejs

Na ilustracji karta rozszerzeń jest oznaczona numerem

Aby zmagazynować 10 GB danych na pojedynczej płycie DVD, jaki typ nośnika powinien być wykorzystany?

Główną metodą ochrony sieci komputerowej przed zewnętrznymi atakami jest wykorzystanie

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

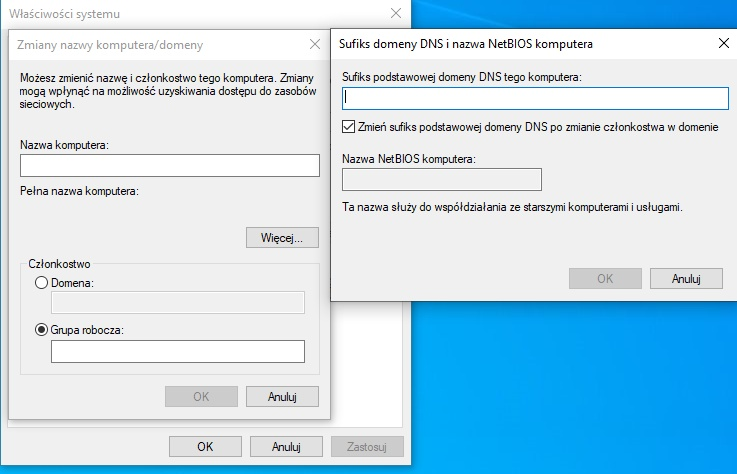

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy