Pytanie 1

Organizacja zajmująca się międzynarodową normalizacją, która stworzyła 7-warstwowy Model Referencyjny Połączonych Systemów Otwartych, to

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Organizacja zajmująca się międzynarodową normalizacją, która stworzyła 7-warstwowy Model Referencyjny Połączonych Systemów Otwartych, to

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Który z protokołów należy do warstwy transportowej, działa bez nawiązywania połączenia i nie posiada mechanizmów weryfikujących poprawność dostarczania danych?

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Na rysunku ukazany jest diagram blokowy zasilacza

W których nośnikach pamięci masowej uszkodzenia mechaniczne są najbardziej prawdopodobne?

Na zdjęciu widać

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Aby zmienić ustawienia rozruchu komputera w systemie Windows 7 przy użyciu wiersza poleceń, jakie polecenie powinno być użyte?

Graficzny symbol pokazany na ilustracji oznacza

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

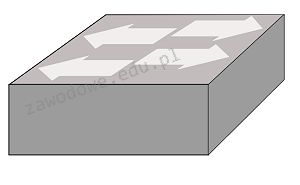

Które z urządzeń sieciowych jest przedstawione na grafice?

Protokołem kontrolnym w obrębie rodziny TCP/IP, który ma na celu między innymi identyfikowanie usterek w urządzeniach sieciowych, jest

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

W systemie Linux plik ma przypisane uprawnienia 765. Jakie działania może wykonać grupa związana z tym plikiem?

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Nośniki informacji, takie jak dysk twardy, gromadzą dane w jednostkach określanych jako sektory, których rozmiar wynosi

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

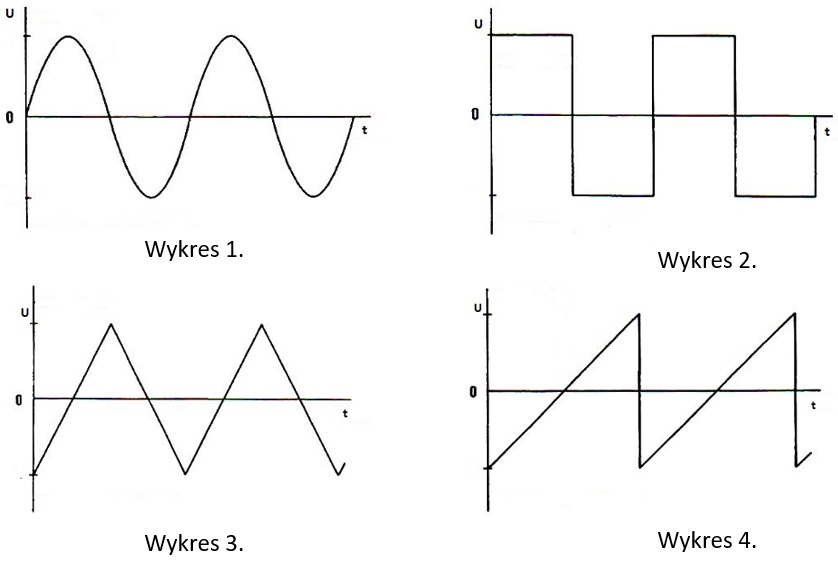

Na którym wykresie przedstawiono przebieg piłokształtny?

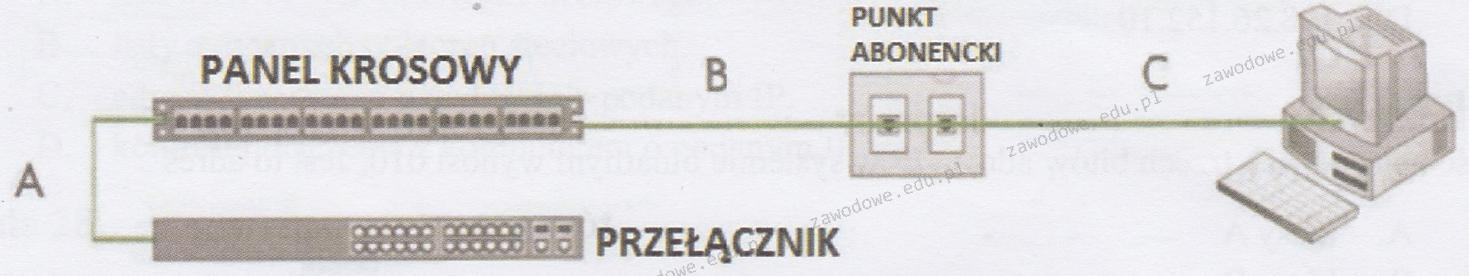

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

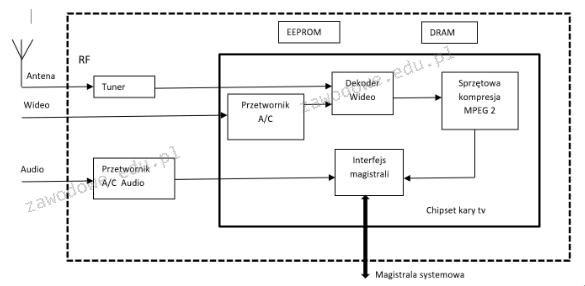

Na ilustracji przedstawiono diagram blokowy karty

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Na zamieszczonym zdjęciu widać

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Jakie polecenie w systemie Linux jest używane do sprawdzania wielkości katalogu?

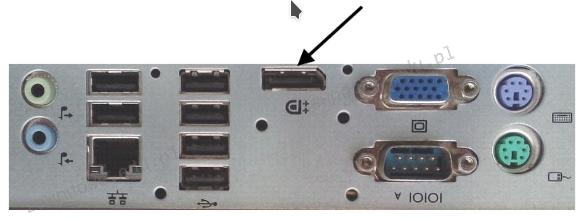

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

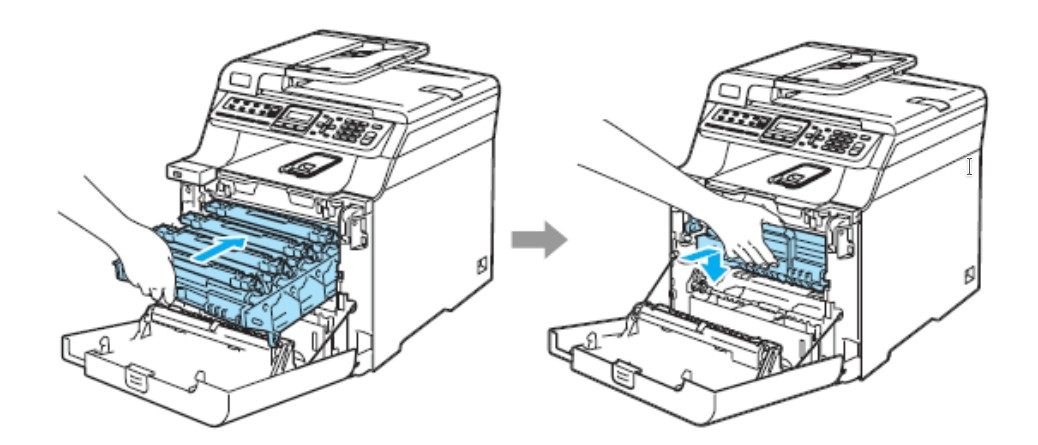

Czynność przedstawiona na ilustracjach dotyczy mocowania

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.