Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W systemie Linux komenda ps wyświetli

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

Aby umożliwić transfer danych między siecią w pracowni a siecią ogólnoszkolną o innej adresacji IP, należy zastosować

Który z rekordów DNS w systemach Windows Server służy do definiowania aliasu (alternatywnej nazwy) dla rekordu A, powiązanego z kanoniczną nazwą hosta?

Wykonanie polecenia fsck w systemie Linux spowoduje

Jaką komendę należy wykorzystać, aby uzyskać informację o rekordzie MX dla podanej domeny?

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Aby wyświetlić przedstawioną informację o systemie Linux w terminalu, należy użyć polecenia

Po skompresowaniu adresu 2001:0012:0000:0000:0AAA:0000:0000:000B w protokole IPv6 otrzymujemy formę

Aby użytkownik laptopa z systemem Windows 7 lub nowszym mógł korzystać z drukarki przez sieć WiFi, musi zainstalować drukarkę na porcie

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

W doborze zasilacza do komputera kluczowe znaczenie

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Oblicz całkowity koszt materiałów potrzebnych do zbudowania sieci w topologii gwiazdy dla 3 komputerów z kartami sieciowymi, używając kabli o długości 2 m. Ceny materiałów są wskazane w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu „skrętka" | 1 zł za 1 metr |

Metoda przesyłania danych pomiędzy urządzeniami CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Komputer K1 jest połączony z interfejsem G0 rutera, a komputer K2 z interfejsem G1 tego samego urządzenia. Na podstawie danych przedstawionych w tabeli, określ właściwy adres bramy dla komputera K2.

| Interfejs | Adres IP | Maska |

|---|---|---|

| G0 | 172.16.0.1 | 255.255.0.0 |

| G1 | 192.168.0.1 | 255.255.255.0 |

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Jaki jest standard 1000Base-T?

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

Serwisant dotarł do klienta, który znajdował się 11 km od siedziby firmy, i przeprowadził u niego działania naprawcze wymienione w poniższej tabeli. Oblicz całkowity koszt brutto jego usług, wiedząc, że dojazd do klienta kosztuje 1,20 zł/km brutto w obie strony. Stawka VAT na usługi wynosi 23%.

Funkcja narzędzia tracert w systemach Windows polega na

Który adres IP jest przypisany do klasy A?

Urządzenie sieciowe, które łączy pięć komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Przekształć liczbę dziesiętną 129(10) na reprezentację binarną.

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

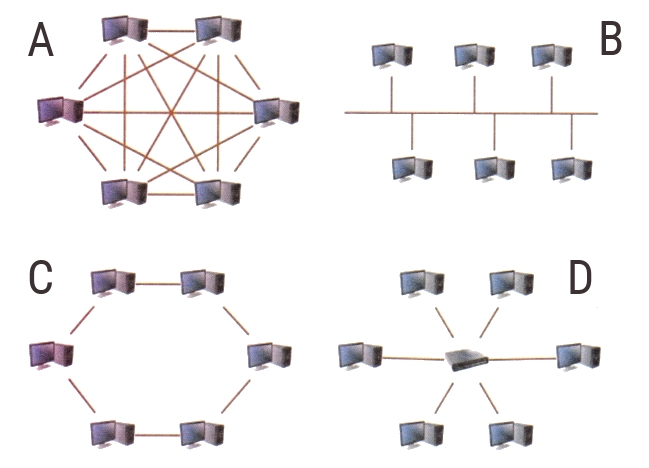

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Określ rezultat wykonania zamieszczonego polecenia

| net user Test /expires:12/09/20 |

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer