Pytanie 1

Podczas konfiguracji nowego routera, użytkownik został poproszony o skonfigurowanie WPA2. Czego dotyczy to ustawienie?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Podczas konfiguracji nowego routera, użytkownik został poproszony o skonfigurowanie WPA2. Czego dotyczy to ustawienie?

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju

Jakie właściwości posiada topologia fizyczna sieci opisana w ramce?

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

Shareware to typ licencji, który opiera się na

Program iftop działający w systemie Linux ma na celu

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

W wyniku wykonania komendy: net user w terminalu systemu Windows, pojawi się

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Na ilustracji zaprezentowano sieć komputerową w układzie

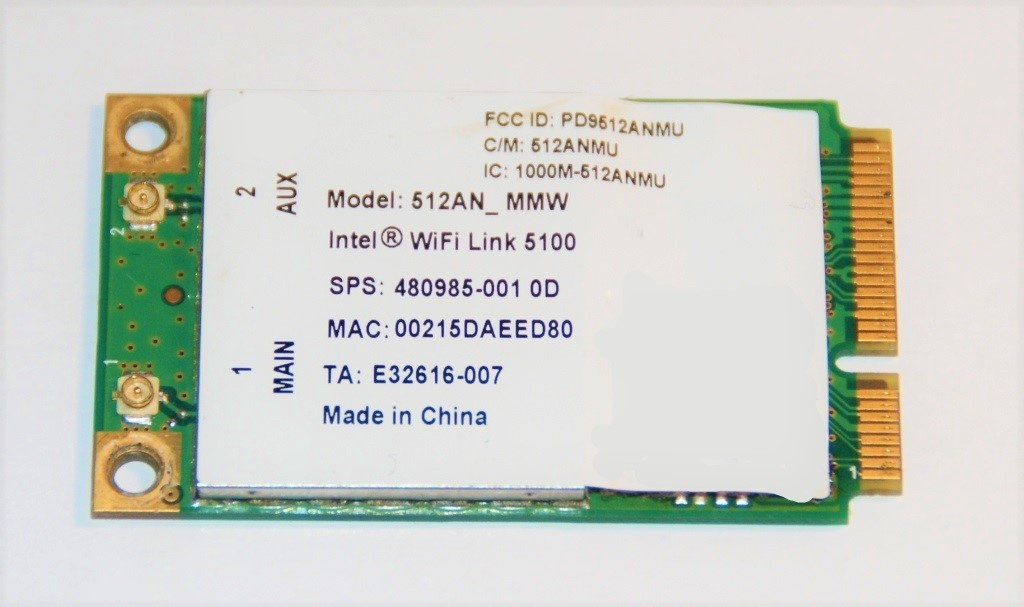

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows wyświetla dane dotyczące wszystkich zasobów udostępnionych na komputerze lokalnym?

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

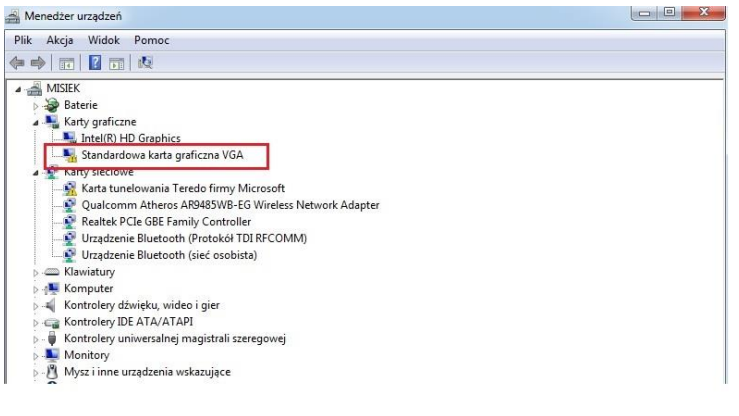

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

Aby stworzyć las w strukturze katalogów AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

W systemie operacyjnym Linux, aby sprawdzić ilość dostępnego miejsca na dyskach, można użyć polecenia

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Brak odpowiedzi na to pytanie.

Polecenie Gpresult

Elementem aktywnym w elektronice jest

Jaką usługę należy aktywować w sieci, aby stacja robocza mogła automatycznie uzyskać adres IP?

W systemie Windows 7 narzędzie linii poleceń Cipher.exe jest wykorzystywane do

Umowa, na podstawie której użytkownik ma między innymi dostęp do kodu źródłowego oprogramowania w celu jego analizy i ulepszania, to licencja

Na podstawie wyników działania narzędzia diagnostycznego chkdsk, które są przedstawione na zrzucie ekranu, jaka jest wielkość pojedynczego klastra na dysku?

Typ systemu plików to FAT32.

Wolumin FTP utworzono 12-11-2005 18:31

Numer seryjny woluminu: 3CED-3B31

Trwa sprawdzanie plików i folderów...

Zakończono sprawdzanie plików i folderów.

Trwa sprawdzanie wolnego miejsca na dysku...

Zakończono sprawdzanie wolnego miejsca na dysku.

System Windows sprawdził system plików i nie znalazł żadnych problemów.

8 233 244 KB całkowitego miejsca na dysku.

1 KB w 13 plikach ukrytych.

2 KB w 520 folderach.

1 537 600 KB w 4 952 plikach.

6 690 048 KB jest dostępnych.

4 096 bajtów w każdej jednostce alokacji.

2 058 311 ogółem jednostek alokacji na dysku.

1 672 512 jednostek alokacji dostępnych na dysku.

C:\>

Jakie pojęcia wiążą się z terminami „sequence number” oraz „acknowledgment number”?

Sequence number: 117752 (relative sequence number) Acknowledgment number: 33678 (relative ack number) Header Length: 20 bytes Flags: 0x010 (ACK) Window size value: 258

Na ilustracji przedstawiono

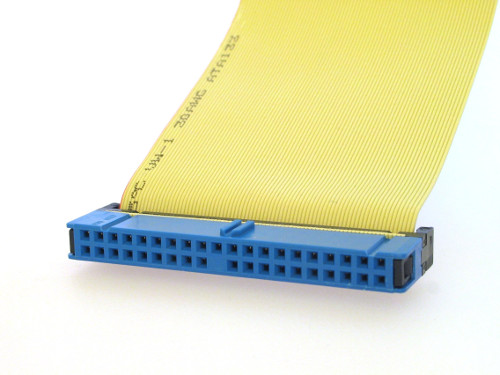

Na ilustracji pokazano wtyczkę taśmy kabel)

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

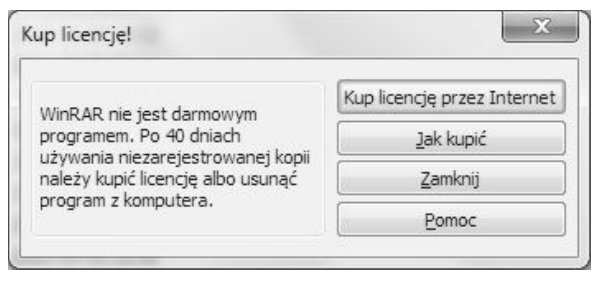

Oprogramowanie, które regularnie przerywa działanie przez pokazanie komunikatu o konieczności uiszczenia opłaty, co prowadzi do zniknięcia tego komunikatu, jest dystrybuowane na podstawie licencji

Program WinRAR pokazał okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencją posługiwał się do tej pory użytkownik?

Jak nazywa się standard podstawki procesora bez nóżek?

Co nie ma wpływu na utratę danych z dysku HDD?