Pytanie 1

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Funkcje z różnych dziedzin (data i czas, finanse, tekst, matematyka, statystyka) są składnikiem

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby zarządzać aplikacjami i usługami uruchamianymi podczas startu systemu operacyjnego w Windows 7, należy skorzystać z programu

Element obliczeń zmiennoprzecinkowych to

Sygnatura (ciąg bitów) 55AA (w systemie szesnastkowym) kończy tablicę partycji. Jaka jest odpowiadająca jej wartość w systemie binarnym?

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

W systemie operacyjnym wystąpił problem z sterownikiem TWAIN, co może wpływać na nieprawidłowe działanie

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Optyczna rozdzielczość to jeden z właściwych parametrów

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

Na jakich licencjach są dystrybuowane wersje systemu Linux Ubuntu?

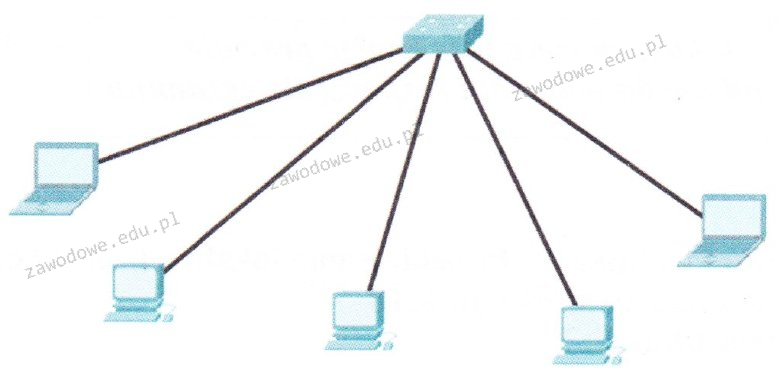

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Na ilustracji przedstawiona jest karta

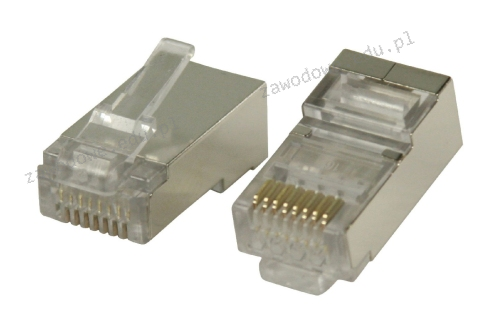

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

Jak nazywa się materiał używany w drukarkach 3D?

Podaj polecenie w systemie Linux, które umożliwia wyświetlenie identyfikatora użytkownika.

Jakie właściwości charakteryzują pojedyncze konto użytkownika w systemie Windows Serwer?

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Zbiór zasad określających metodę wymiany danych w sieci to

Za przydzielanie czasu procesora do konkretnych zadań odpowiada

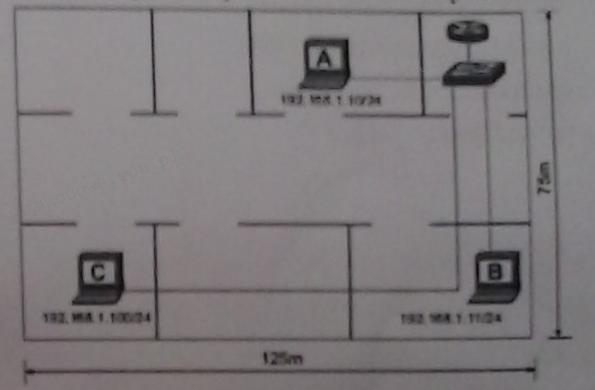

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Jakie gniazdo w notebooku jest przeznaczone do podłączenia kamery cyfrowej przez interfejs i.Link?

Jakie urządzenie jest używane do łączenia lokalnej sieci bezprzewodowej z siecią kablową?