Pytanie 1

W brachyterapii MDR stosowane są dawki promieniowania

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

W brachyterapii MDR stosowane są dawki promieniowania

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego

Gadolin jako dożylny środek kontrastowy stosowany w MR powoduje

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

Obrazy DDR są tworzone w trakcie

Jaki jest cel stosowania bolusa w radioterapii?

W brachyterapii MDR stosowane są dawki promieniowania

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

W technice napromieniania SSD mierzona jest odległość źródła promieniowania od

W scyntygrafii wykorzystywane są głównie radioizotopy emitujące promieniowanie

Który detektor w radiografii wymaga laserowego czytnika obrazu?

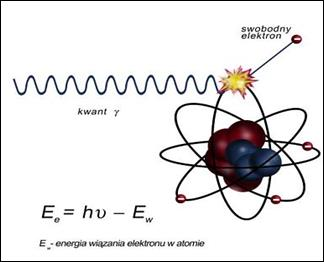

Na ilustracji przedstawiono zjawisko

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

W pozytonowej tomografii emisyjnej PET zostaje zarejestrowane promieniowanie powstające podczas

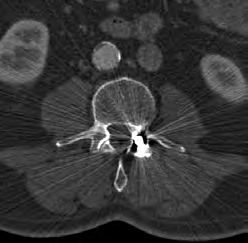

Który artefakt jest widoczny na skanie tomografii komputerowej?

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

W ultrasonografii występuje zależność:

Jakie źródła promieniowania stosowane są w brachyterapii?

W celu maksymalnego ograniczenia dawki promieniowania badanie rentgenowskie u dzieci należy wykonać

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

SPECT to

W leczeniu izotopowym tarczycy należy podać

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

W diagnostyce metodą rezonansu magnetycznego biorą udział

Radioizotopowa terapia medycyny nuklearnej polega na wprowadzeniu do tkanek lub narządów radiofarmaceutyku

W której technice brachyterapii stosuje się źródła promieniowania o mocy dawki 2-12 Gy/h?

Który radioizotop jest emiterem promieniowania alfa?

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

W obrazowaniu MR wykorzystuje się moment magnetyczny

Planowany obszar napromieniania PTV obejmuje

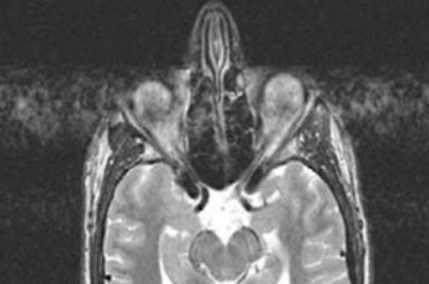

Co jest przyczyną artefaktu widocznego na obrazie MR?

Fala głosowa rozchodzi się

Która sekwencja obrazowania MR wykorzystuje impulsy RF o częstotliwości rezonansowej tłuszczu do tłumienia sygnału pochodzącego z tkanki tłuszczowej?

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Do czego służy do symulator rentgenowski wykorzystywany w procesie radioterapii?

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Hiperfrakcjonowanie dawki w radioterapii oznacza napromieniowywanie pacjenta

Czas repetycji w obrazowaniu metodą rezonansu magnetycznego to

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną