Pytanie 1

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

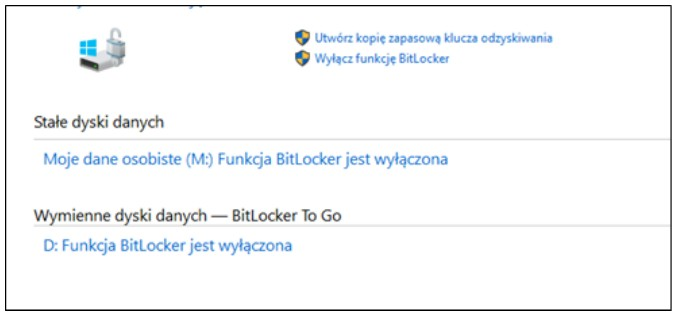

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

Jaka będzie suma liczb binarnych 1010 oraz 111, gdy przeliczymy ją na system dziesiętny?

Grupa, w której członkom można nadawać uprawnienia jedynie w obrębie tej samej domeny, co domena nadrzędna lokalnej grupy domeny, nosi nazwę grupa

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Standard WIFI 802.11 b/g używa pasma

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Jakie znaczenie ma zaprezentowany symbol graficzny?

Do jakiego złącza, które pozwala na podłączenie monitora, jest wyposażona karta graficzna pokazana na ilustracji?

Odmianą pamięci, która jest tylko do odczytu i można ją usunąć za pomocą promieniowania ultrafioletowego, jest pamięć

Aby na Pasku zadań pojawiły się ikony z załączonego obrazu, trzeba w systemie Windows ustawić

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Jaka jest binarna reprezentacja adresu IP 192.168.1.12?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Przesyłanie informacji przy użyciu fal radiowych w pasmie ISM odbywa się w standardzie

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Aby zrealizować wymianę informacji między dwoma odmiennymi sieciami, konieczne jest użycie

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Programem służącym do archiwizacji danych w systemie Linux jest

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Które z kont nie jest wbudowanym kontem w systemie Windows XP?

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Która funkcja przełącznika zarządzalnego umożliwia kontrolę przepustowości każdego z wbudowanych portów?

Jaką wartość przepustowości definiuje standard 1000Base-T?

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Według KNR (katalogu nakładów rzeczowych) montaż 4-parowego modułu RJ45 oraz złącza krawędziowego to 0,07 r-g, natomiast montaż gniazd abonenckich natynkowych wynosi 0,30 r-g. Jak wysoki będzie koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

Licencja Windows OEM nie zezwala na wymianę