Pytanie 1

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Centratory laserowe zamontowane w kabinie aparatu terapeutycznego służą do

W badaniu PET CT wykorzystuje się radioizotopy emitujące promieniowanie

Który radioizotop jest emiterem promieniowania alfa?

Promieniowanie rentgenowskie powstaje w wyniku hamowania

W radiografii mianem SID określa się

Fala głosowa rozchodzi się

Teleterapia polega na napromienowaniu

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

Radioizotopowa terapia medycyny nuklearnej polega na wprowadzeniu do tkanek lub narządów radiofarmaceutyku

W pracowni radioterapii wyświetlenie na ekranie monitora aparatu komunikatu „ROTATION” oznacza prowadzoną terapię

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

W badaniu PETCT radioizotop ulega

Osłony na gonady dla osób dorosłych powinny posiadać równoważnik osłabienia promieniowania nie mniejszy niż

Który radioizotop jest emiterem promieniowania alfa?

Jednostką indukcji magnetycznej jest

Hiperfrakcjonowanie dawki w radioterapii oznacza napromieniowywanie pacjenta

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

Elementem systemu rejestracji obrazu, w którym fotony promieniowania X są bezpośrednio konwertowane na sygnał elektryczny, jest

Która metoda diagnostyczna służy do określenia gęstości minerału kostnego w ujęciu objętościowym g/cm³?

Po wykonanej radioterapii do dokumentacji pacjenta należy wpisać dawkę promieniowania w jednostce

Standardowe badanie USG średniej wielkości piersi wykonuje się głowicą w zakresie częstotliwości

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Obrazy DDR są tworzone w trakcie

W brachyterapii MDR stosowane są dawki promieniowania

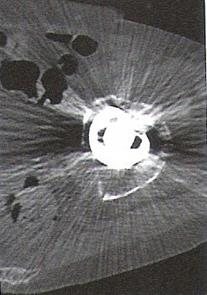

Zarejestrowany na obrazie TK artefakt jest spowodowany

Planowany obszar napromieniania PTV obejmuje

W radiografii mianem SID określa się

Nieostrość geometryczna obrazu rentgenowskiego zależy od

Do pomiaru dawek indywidualnych u osób narażonych zawodowo na promieniowanie rentgenowskie są stosowane

Parametr SNR w obrazowaniu MR oznacza

W celu wyeliminowania zakłóceń obrazu MR przez sygnały pochodzące z tkanki tłuszczowej, stosuje się

W technice napromieniania SSD mierzona jest odległość źródła promieniowania od

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

Czas repetycji w obrazowaniu metodą rezonansu magnetycznego to

Glukoza podawana pacjentowi w badaniu PET jest znakowana radioaktywnym

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?

Gadolin jako dożylny środek kontrastowy stosowany w MR powoduje