Pytanie 1

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Wskaź, które zdanie dotyczące zapory sieciowej jest nieprawdziwe?

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Jakie adresy mieszczą się w zakresie klasy C?

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?

Plik ma przypisane uprawnienia: rwxr-xr--. Jakie uprawnienia będzie miał plik po zastosowaniu polecenia chmod 745?

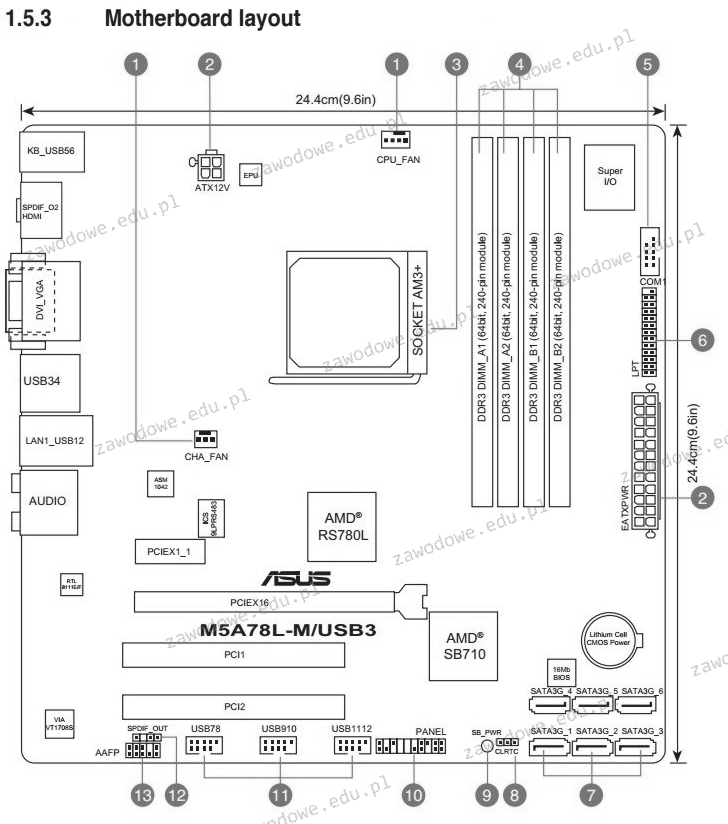

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

Jaką liczbę warstw określa model ISO/OSI?

Farad to jednostka

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

W systemie Linux użycie polecenia passwd Ala spowoduje

Bez uzyskania zgody właściciela praw autorskich do oprogramowania, jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może uczynić?

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Który adres IP jest przypisany do klasy A?

Recykling można zdefiniować jako

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Jakie pole znajduje się w nagłówku protokołu UDP?

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Który typ macierzy RAID zapewnia tzw. mirroring dysków?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

Zaproponowany fragment ustawień zapory sieciowej umożliwia przesył danych przy użyciu protokołów ```iptables -A INPUT --protocol tcp --dport 443 -j ACCEPT iptables -A INPUT --protocol tcp --dport 143 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 443 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 143 -j ACCEPT```

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

W jakim systemie jest przedstawiona liczba 1010(o)?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Elementem eksploatacyjnym drukarki laserowej jest wszystko oprócz

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Jakie zakresy zostaną przydzielone przez administratora do adresów prywatnych w klasie C, przy użyciu maski 24 bitowej dla komputerów w lokalnej sieci?

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Natychmiast po usunięciu ważnych plików na dysku twardym użytkownik powinien

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest