Pytanie 1

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

}Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

ACPI to interfejs, który umożliwia

Czym jest serwer poczty elektronicznej?

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

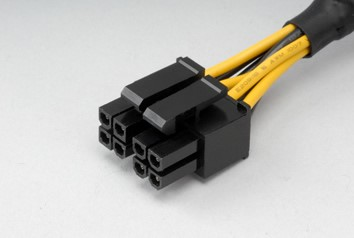

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Czym są programy GRUB, LILO, NTLDR?

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Zakres adresów IPv4 od 224.0.0.0 do 239.255.255.255 jest przeznaczony do jakiego rodzaju transmisji?

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

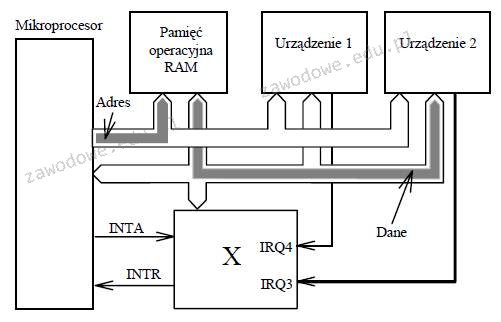

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Protokół User Datagram Protocol (UDP) należy do

Co oznacza skrót "DNS" w kontekście sieci komputerowych?

Prezentowany komunikat pochodzi z wykonania polecenia

Który z podanych adresów IP należy do klasy A?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Jakie środowisko graficzne zaprojektowane dla systemu Linux ma najniższe wymagania dotyczące pamięci RAM?

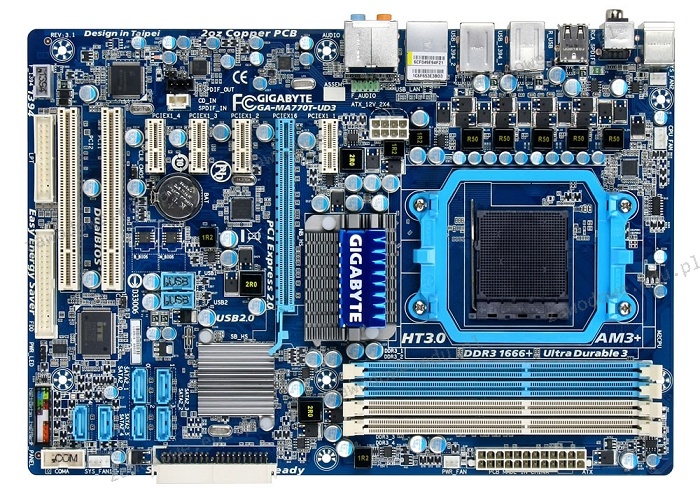

Do pokazanej na diagramie płyty głównej nie można podłączyć urządzenia, które korzysta z interfejsu

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

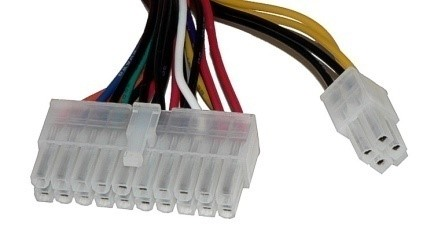

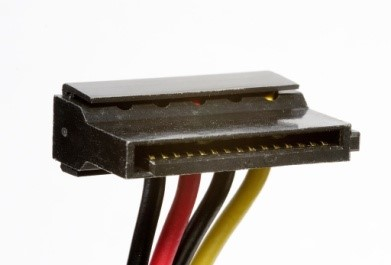

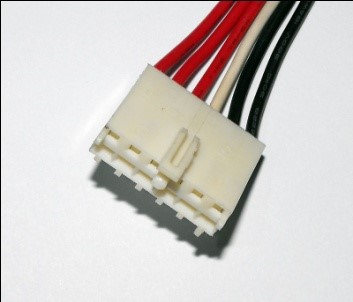

Wskaż wtyk zasilający, który podczas montażu zestawu komputerowego należy podłączyć do napędu optycznego.

W systemach Windows profil użytkownika tymczasowego jest

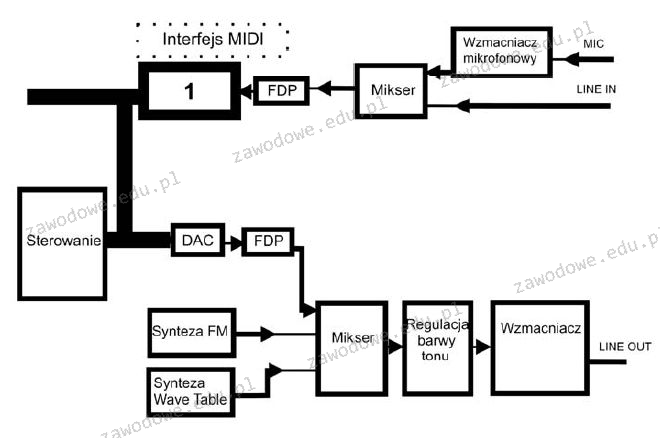

Schemat blokowy karty dźwiękowej jest przedstawiony na rysunku. Jaką rolę odgrywa układ oznaczony numerem 1?

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Dostarczanie błędnych napięć do płyty głównej może spowodować

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Redukcja liczby jedynek w masce pozwoli na zaadresowanie

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Który z protokołów umożliwia szyfrowane połączenia?