Pytanie 1

W systemach operacyjnych Windows system plików pozwala na ograniczenie dostępu użytkowników do określonych katalogów, plików czy dysków

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

W systemach operacyjnych Windows system plików pozwala na ograniczenie dostępu użytkowników do określonych katalogów, plików czy dysków

Oblicz całkowity koszt za realizację poniższych czynności serwisowych, przy założeniu, że stawka za jedną roboczogodzinę wynosi 120,00 zł netto, a podatek VAT wynosi 23%.

| LP | Zrealizowane czynności serwisowe | Ilość roboczogodzin |

|---|---|---|

| 1. | Diagnozowanie usterki | 0,2 |

| 2. | Wymiana zasilacza | 0,5 |

| 3. | Przygotowanie drukarki do eksploatacji | 0,6 |

| 4. | Konserwacja urządzenia drukującego | 1,0 |

| 5. | Sprawdzanie po zakończeniu naprawy | 0,2 |

Jaka jest nominalna moc wyjściowa (ciągła) zasilacza o parametrach zapisanych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

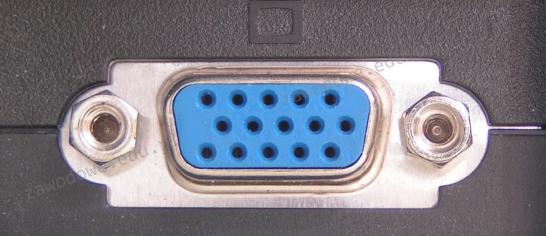

Złącze widoczne na ilustracji służy do podłączenia

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Jakie oznaczenie potwierdza oszczędność energii urządzenia?

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

Jakie są skutki działania poniższego polecenia ```netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53```?

Aby podłączyć kasę fiskalną wyposażoną w złącze komunikacyjne DB-9M do komputera stacjonarnego, należy zastosować przewód

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

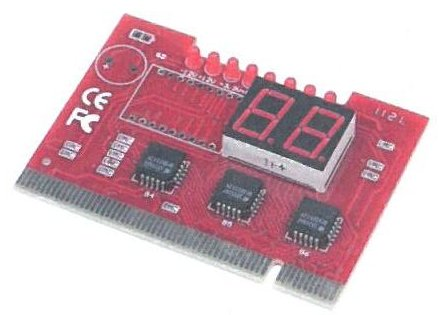

Na ilustracji ukazano kartę

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Technik serwisowy, po przeprowadzeniu testu na serwerze NetWare, otrzymał informację, że obiekt dysponuje prawem

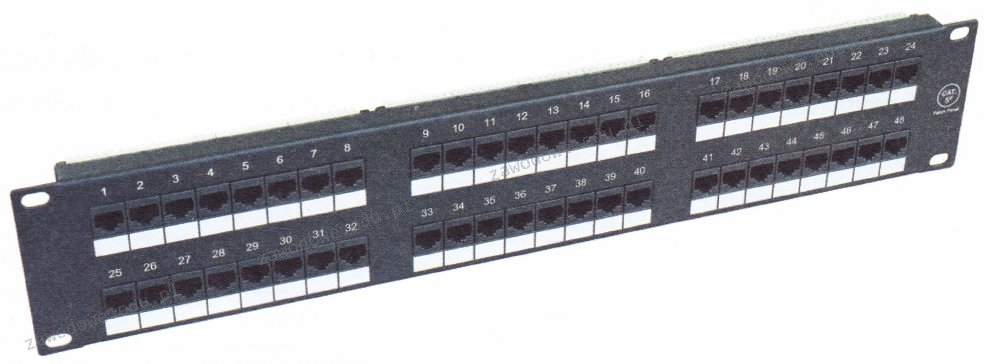

Na ilustracji zaprezentowano

W systemie operacyjnym Fedora foldery domowe użytkowników znajdują się w folderze

Na ilustracji widoczny jest

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

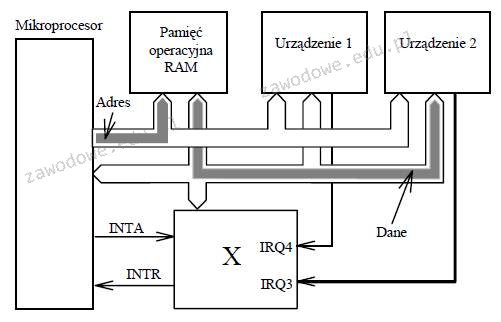

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Czym są programy GRUB, LILO, NTLDR?

W architekturze sieci lokalnych opartej na modelu klient-serwer

Program o nazwie dd, którego przykład zastosowania przedstawiono w systemie Linux, umożliwia

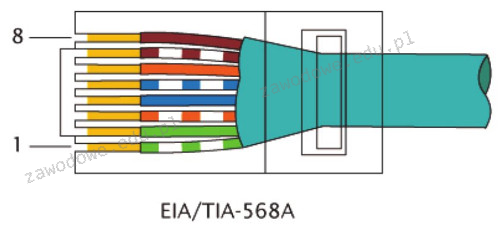

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

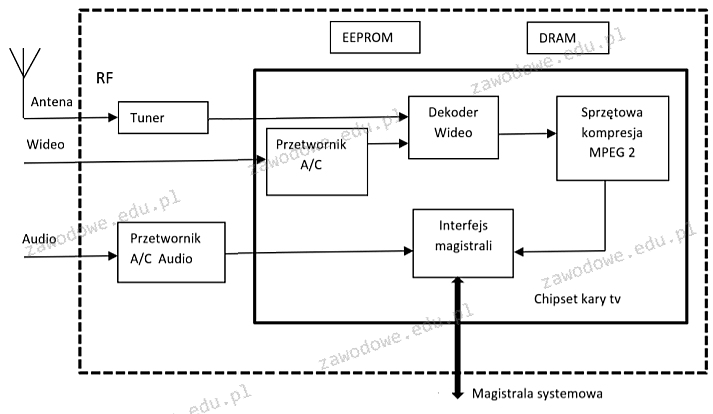

Na ilustracji zaprezentowano schemat blokowy karty

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

Protokół SNMP (Simple Network Management Protocol) służy do

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Rekord startowy dysku twardego w komputerze to

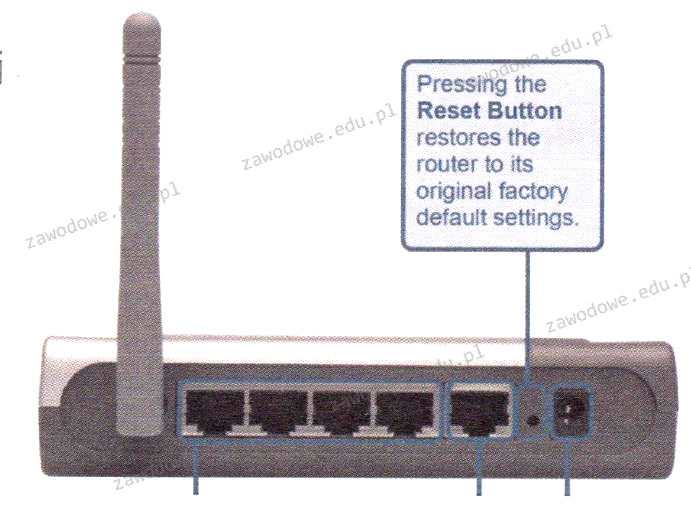

Przycisk znajdujący się na obudowie rutera, którego charakterystyka zamieszczona jest w ramce, służy do

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Która czynność nie służy do personalizacji systemu operacyjnego Windows?

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Jaki standard Ethernet należy wybrać przy bezpośrednim połączeniu urządzeń sieciowych, które dzieli odległość 1 km?

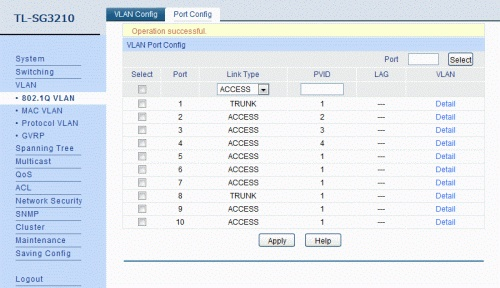

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Aby skopiować katalog c: est z podkatalogami na dysk przenośny f: w systemie Windows 7, jakie polecenie należy zastosować?