Pytanie 1

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Jaką kwotę łącznie pochłonie robocizna związana z montażem 20 modułów RJ45 z krawędziowym złączem narzędziowym na przewodach 4-parowych, jeśli stawka godzinowa montera wynosi 15 zł/h, a według tabeli KNR czas montażu pojedynczego modułu to 0,10 r-g?

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Na ilustracji zaprezentowano kabel

Ile jest klawiszy funkcyjnych na klawiaturze w układzie QWERTY?

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

Urządzenie pokazane na ilustracji ma na celu

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Jaką topologię sieci przedstawia rysunek?

Jakie rozwiązanie należy wdrożyć i prawidłowo ustawić, aby chronić lokalną sieć komputerową przed atakami typu Smurf pochodzącymi z Internetu?

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

Na ilustracji ukazana jest karta

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Scandisk to narzędzie, które wykorzystuje się do

Włączenie systemu Windows w trybie debugowania umożliwia

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

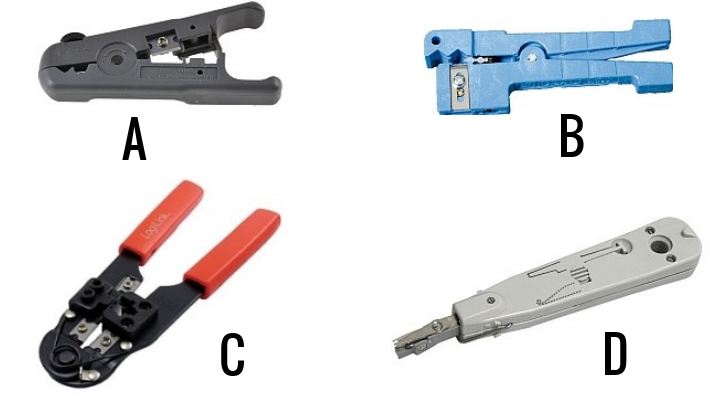

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Jaka usługa sieciowa domyślnie wykorzystuje port 53?

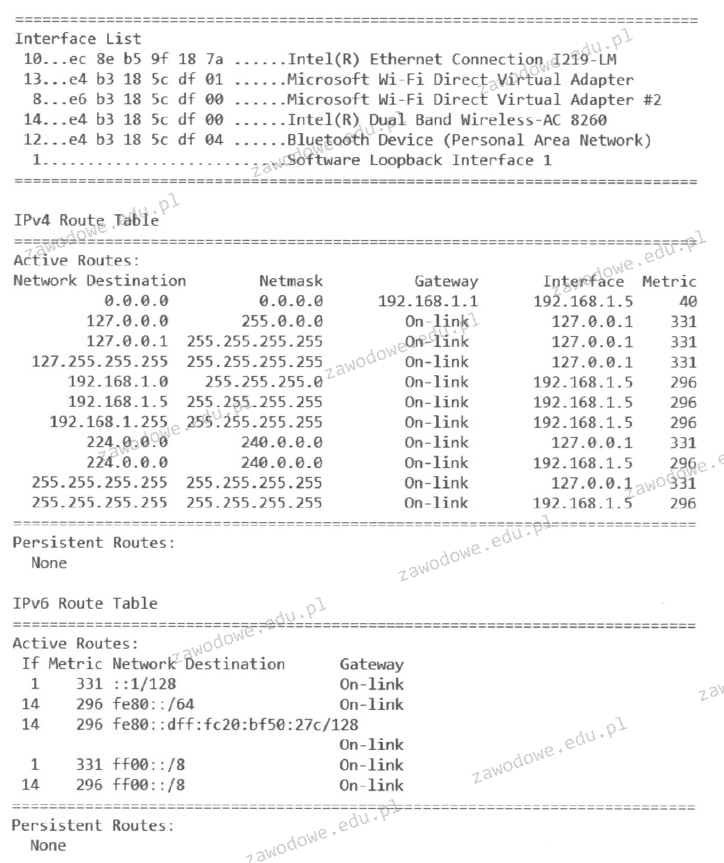

Informacje, które zostały pokazane na wydruku, uzyskano w wyniku wykonania

W dokumentacji technicznej głośnika komputerowego oznaczenie "10 W" dotyczy jego

Unity Tweak Tool oraz narzędzia dostrajania to elementy systemu Linux, które mają na celu

Do czego służy program CHKDSK?

Jaki jest powód sytuacji widocznej na przedstawionym zrzucie ekranu, mając na uwadze adres IP serwera, na którym umieszczona jest domena www.wp.pl, wynoszący 212.77.98.9?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=30ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 29ms, Maximum = 30ms, Average = 29ms

C:\>ping www.wp.pl

Ping request could not find host www.wp.pl. Please check the name and try again.Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

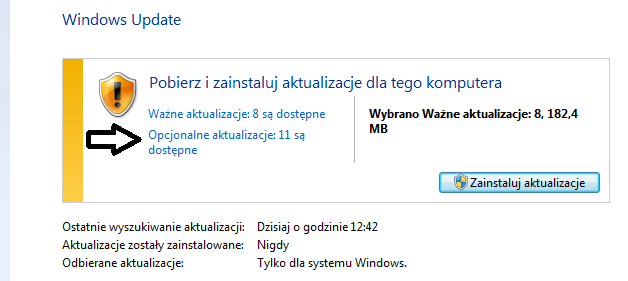

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

Który z standardów korzysta z częstotliwości 5 GHz?

Na załączonym rysunku przedstawiono

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Magistrala PCI-Express wykorzystuje do transmisji danych metodę komunikacji

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Osoba korzystająca z systemu Linux, która chce odnaleźć pliki o konkretnej nazwie przy użyciu polecenia systemowego, może wykorzystać komendę

Aby skonfigurować i dostosować środowisko graficzne GNOME w różnych dystrybucjach Linux, należy użyć programu

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Skrót określający translację adresów w sieciach to