Pytanie 1

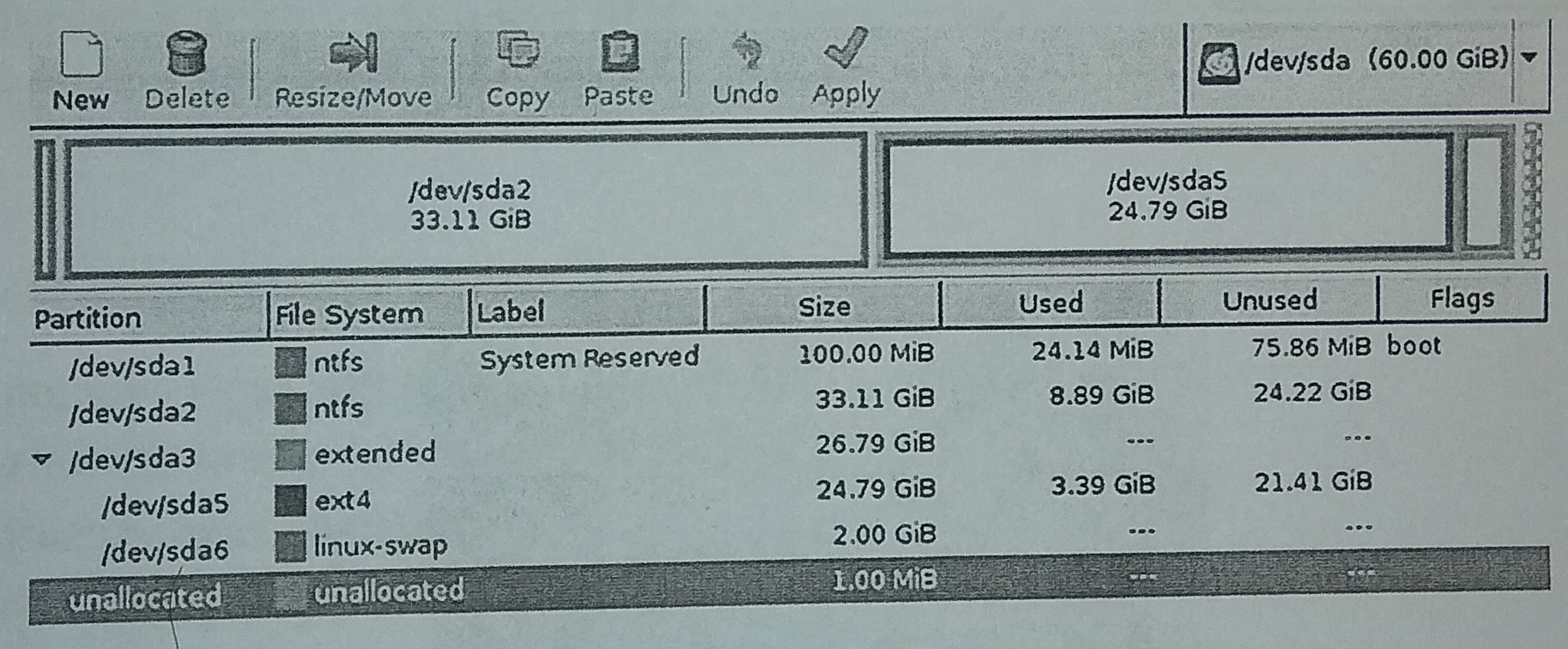

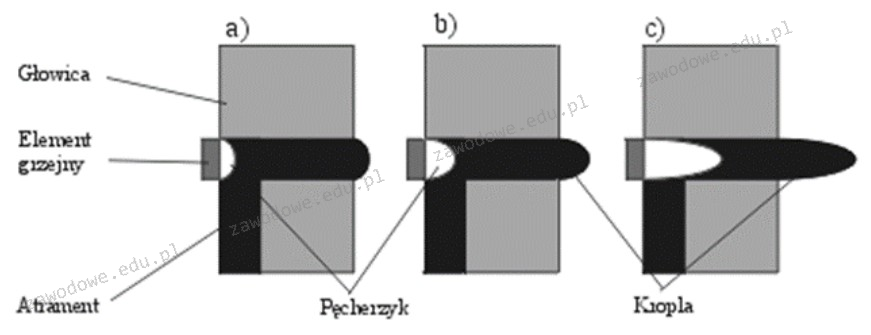

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Wskaź narzędzie przeznaczone do mocowania pojedynczych żył kabla miedzianego w złączach?

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Jak określana jest transmisja w obie strony w sieci Ethernet?

Element obliczeń zmiennoprzecinkowych to

W systemie Linux komenda tty pozwala na

Włączenie systemu Windows w trybie debugowania umożliwia

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Aplikacją, która umożliwia wyświetlenie listy aktywnych urządzeń w sieci LAN, jest

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z poniższych systemów operacyjnych jest systemem typu open-source?

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w tworzonej sieci komputerowej, jakie rozwiązanie należy zastosować?

Ile par przewodów w standardzie 100Base-TX jest używanych do przesyłania danych w obie strony?

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

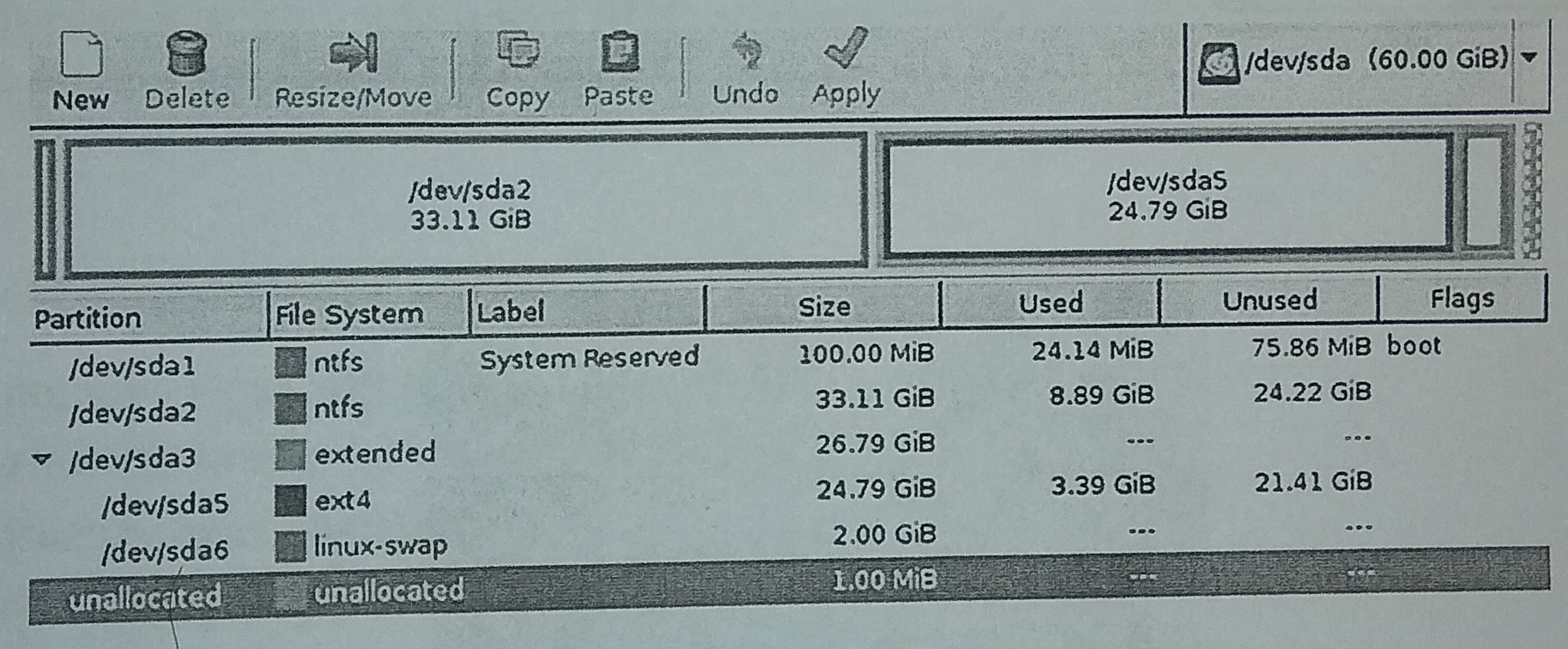

Rysunek ilustruje sposób działania drukarki

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Jaka liczba hostów może być zaadresowana w podsieci z adresem 192.168.10.0/25?

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Który z interfejsów można uznać za interfejs równoległy?

Aby uporządkować dane pliku zapisane na dysku twardym, które znajdują się w nie sąsiadujących klastrach, tak by zajmowały one sąsiadujące ze sobą klastry, należy przeprowadzić

Które polecenie systemu Linux służy do wyświetlenia informacji o zainstalowanych podzespołach?

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Co to jest urządzenie sieciowe most (ang. bridge)?

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Autor zamieszczonego oprogramowania zezwala na jego bezpłatne używanie jedynie w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Element elektroniczny przedstawiony na ilustracji to:

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Urządzenie ADSL wykorzystuje się do nawiązania połączenia

Na świeżo zainstalowanym komputerze program antywirusowy powinno się zainstalować