Pytanie 1

Co symbolizuje graficzny znak przedstawiony na ilustracji?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Co symbolizuje graficzny znak przedstawiony na ilustracji?

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Sieć komputerowa, która obejmuje wyłącznie urządzenia jednej organizacji, w której dostępne są usługi realizowane przez serwery w sieci LAN, takie jak strony WWW czy poczta elektroniczna to

Które zdanie opisujące domenę Windows jest prawdziwe?

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Jakie zagrożenia eliminują programy antyspyware?

Polecenie chmod +x test

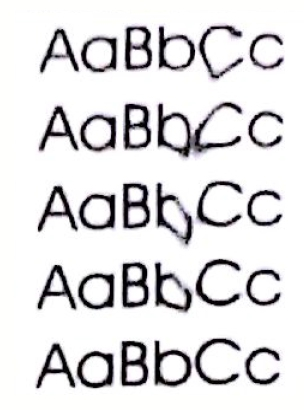

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

Jakie polecenie jest używane do ustawienia konfiguracji interfejsu sieciowego w systemie Linux?

Główną rolą serwera FTP jest

Jakie informacje o wykorzystywaniu pamięci wirtualnej można uzyskać, analizując zawartość pliku w systemie Linux?

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W skład sieci komputerowej wchodzą 3 komputery stacjonarne oraz drukarka sieciowa, połączone kablem UTP z routerem mającym 1 x WAN oraz 5 x LAN. Które z urządzeń sieciowych pozwoli na podłączenie dodatkowych dwóch komputerów do tej sieci za pomocą kabla UTP?

Jakie polecenie służy do obserwowania lokalnych połączeń?

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

Na ilustracji zaprezentowano sieć komputerową w układzie

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

Aby w systemie Windows, przy użyciu wiersza poleceń, zmienić partycję FAT na NTFS bez utraty danych, powinno się zastosować polecenie

Sieć, w której funkcjonuje komputer o adresie IP 192.168.100.50/28, została podzielona na 4 podsieci. Jakie są poprawne adresy tych podsieci?

Aby obserwować przesył danych w sieci komputerowej, należy wykorzystać program typu

Jakie narzędzie należy zastosować w systemie Windows, aby skonfigurować właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Który z protokołów NIE jest używany do ustawiania wirtualnej sieci prywatnej?

Użytkownik planuje instalację 32-bitowego systemu operacyjnego Windows 7. Jaka jest minimalna ilość pamięci RAM, którą powinien mieć komputer, aby system mógł działać w trybie graficznym?

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Aby uporządkować dane pliku zapisane na dysku twardym, które znajdują się w nie sąsiadujących klastrach, tak by zajmowały one sąsiadujące ze sobą klastry, należy przeprowadzić

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Przedsiębiorca przekazujący do składowania odpady inne niż komunalne ma obowiązek prowadzić

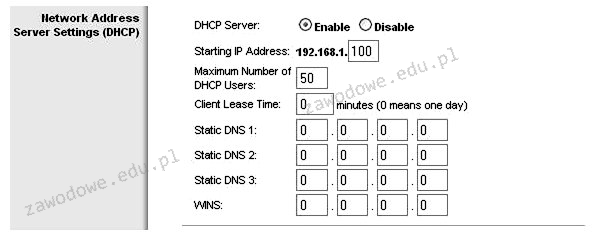

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

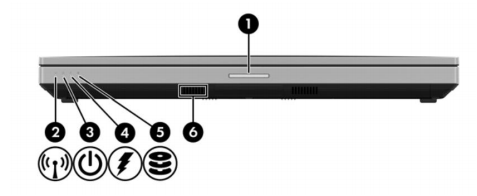

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

Na stronie wydrukowanej na drukarce laserowej pojawiają się jaśniejsze i ciemniejsze obszary. Aby rozwiązać problemy z nieciągłością i jakością wydruku, należy