Pytanie 1

W laserowej drukarce do utrwalania wydruku na papierze stosuje się

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

W laserowej drukarce do utrwalania wydruku na papierze stosuje się

Menedżer urządzeń w systemie Windows umożliwia identyfikację

W jednostce ALU w akumulatorze zapisano liczbę dziesiętną 500. Jaką ona ma binarną postać?

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Zarządzanie partycjami w systemach operacyjnych Windows

Dezaktywacja automatycznych aktualizacji systemu Windows skutkuje

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Nazwa protokołu, który pozwala na konwersję 32-bitowych adresów IP na 48-bitowe fizyczne adresy MAC w sieciach Ethernet, to:

W sekcji zasilania monitora LCD, powiększone kondensatory elektrolityczne mogą prowadzić do uszkodzenia

Podczas realizacji procedury POST na wyświetlaczu ukazuje się komunikat "CMOS Battery State Low". Jakie kroki należy podjąć, aby uniknąć pojawiania się tego komunikatu w przyszłości?

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

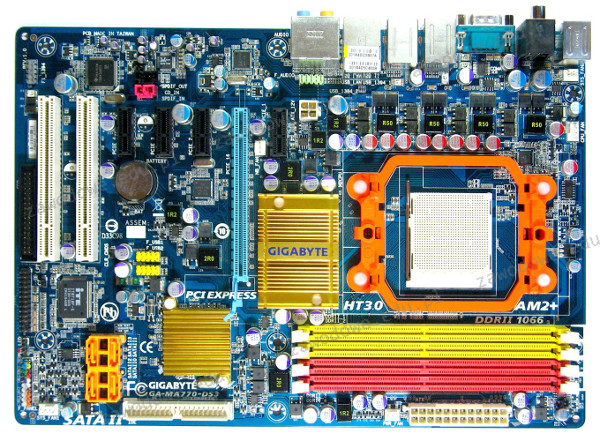

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Licencja Windows OEM nie umożliwia wymiany

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

W systemie Linux komenda tty pozwala na

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Który system plików powinien być wybrany podczas instalacji Linuxa, aby umożliwić ustalanie uprawnień dla plików i katalogów?

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Jaki typ routingu jest najbardziej odpowiedni w złożonych, szybko ewoluujących sieciach?

Zaprezentowany komputer jest niepełny. Który z komponentów nie został wymieniony w tabeli, a jest kluczowy dla poprawnego funkcjonowania zestawu i powinien być dodany?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3,5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

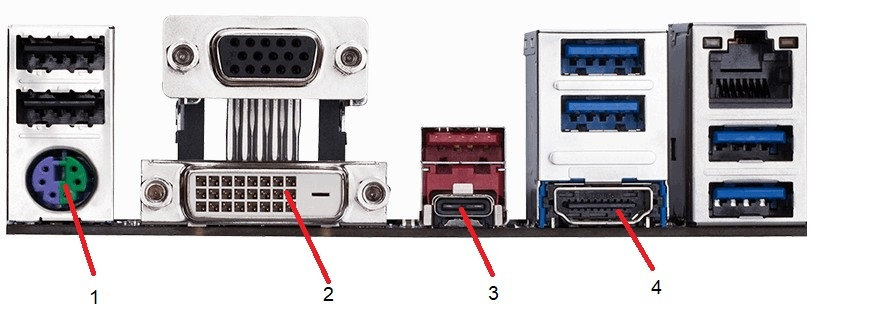

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

Aby serwer mógł przesyłać dane w zakresach częstotliwości 2,4 GHz oraz 5 GHz, konieczne jest zainstalowanie w nim karty sieciowej działającej w standardzie

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Pierwszym krokiem, który należy podjąć, aby chronić ruter przed nieautoryzowanym dostępem do jego panelu administracyjnego, jest

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

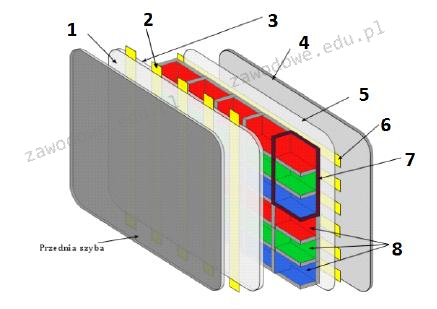

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

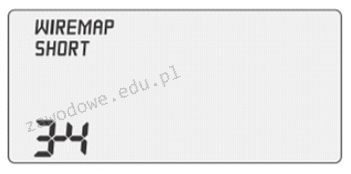

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

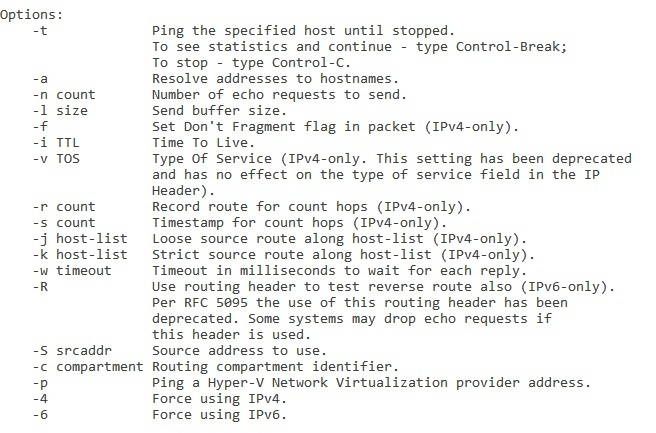

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

Program w wierszu poleceń systemu Windows, który pozwala na konwersję tablicy partycji z GPT na MBR, to

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Złącze widoczne na obrazku pozwala na podłączenie

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować