Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 34/40 punktów (85,0%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie jest używane do ustawienia konfiguracji interfejsu sieciowego w systemie Linux?

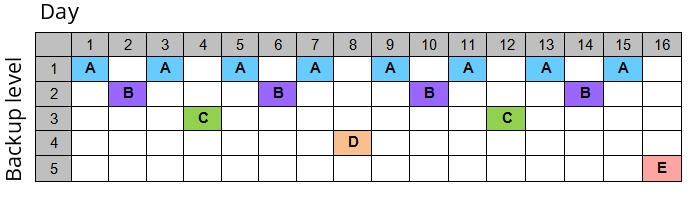

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Okablowanie pionowe w systemie strukturalnym łączy się

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

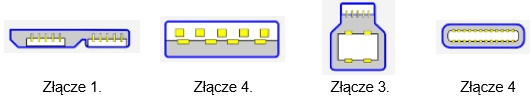

Wskaż kształt złącza USB typu C.

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

Jaki port jest ustawiony jako domyślny dla serwera WWW?

W systemie operacyjnym Linux, do konfigurowania sieci VLAN wykorzystuje się polecenie

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

Prezentowana usterka ekranu laptopa może być spowodowana

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

W systemie Windows konto użytkownika można założyć za pomocą polecenia

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Dokumentacja końcowa dla planowanej sieci LAN powinna między innymi zawierać

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Jaką usługę należy aktywować w sieci, aby stacja robocza mogła automatycznie uzyskać adres IP?

Na ilustracji zaprezentowane jest urządzenie, które to

Wynikiem dodawania dwóch liczb binarnych 1101011 oraz 1001001 jest liczba w systemie dziesiętnym

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Który protokół zajmuje się konwersją adresów IP na adresy MAC (kontroli dostępu do nośnika)?

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Aby skonfigurować i dostosować środowisko graficzne GNOME w różnych dystrybucjach Linux, należy użyć programu

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji