Pytanie 1

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

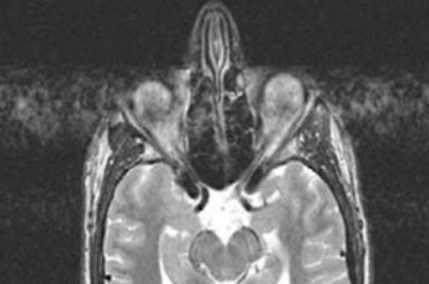

Co jest przyczyną artefaktu widocznego na obrazie MR?

Które czynności wykonuje technik elektroradiolog w pracowni „gorącej”?

Kasety do pośredniej radiografii cyfrowej CR są wyposażone

Promieniowanie rentgenowskie jest

Hiperfrakcjonowanie dawki w radioterapii oznacza napromienienie pacjenta

Do wczesnych odczynów popromiennych po radioterapii zalicza się

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

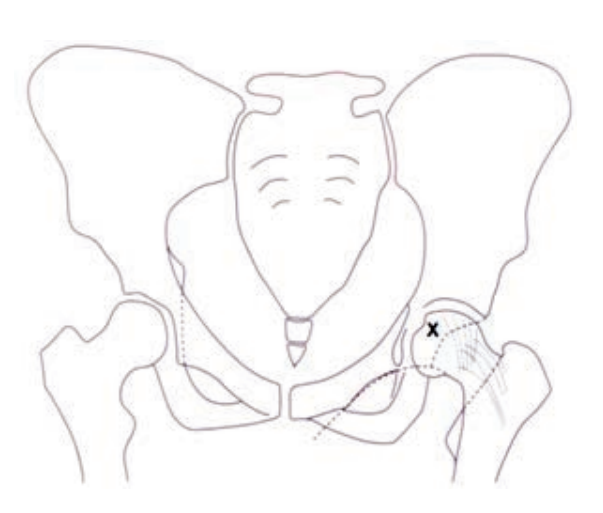

Na rycinie rentgenogramu w projekcji AP symbolem X oznaczono

Technik elektroradiolog do badania MR kręgosłupa lędźwiowego powinien ułożyć pacjenta:

Jaki kolor ma warstwa korowa kości w badaniu MR na obrazie T1- zależnym?

W badaniu EKG różnice potencjałów pomiędzy lewym podudziem a lewym przedramieniem rejestruje odprowadzenie

Gruboziarnista folia wzmacniająca wpływa na zwiększenie na obrazie rentgenowskim nieostrości

Jak oznacza się w systemie międzynarodowym czwarty górny ząb mleczny po stronie prawej?

Wiązka elektronów najczęściej stosowana jest do leczenia zmian nowotworowych w obrębie

Ligand stosuje się

W leczeniu izotopowym tarczycy podaje się

Które badanie, zgodnie z zakresem kompetencji, może samodzielnie wykonać technik elektroradiolog?

Który załamek odzwierciedla szybką repolaryzację komór w zapisie EKG?

Jednostką indukcji magnetycznej jest

Która sekwencja w obrazowaniu MR jest stosowana do uwidocznienia naczyń krwionośnych?

Który radioizotop jest emiterem promieniowania alfa?

Który załamek odzwierciedla repolaryzację komór w zapisie EKG?

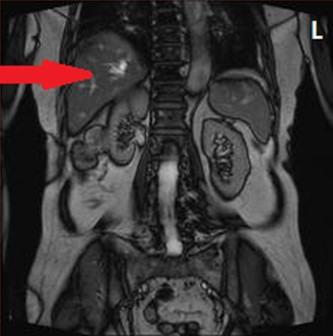

Na obrazie MR jamy brzusznej strzałką wskazano

Parametr SNR w obrazowaniu MR oznacza

W jakiej projekcji i pod jakim kątem padania promienia centralnego został wykonany radiogram obojczyka?

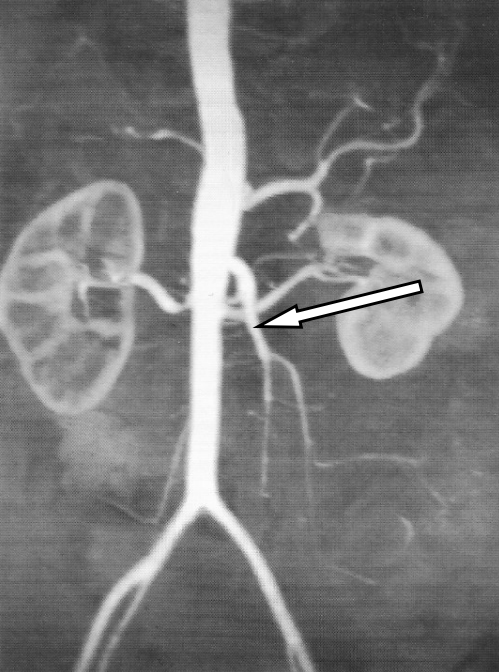

Którą tętnicę zaznaczono strzałką na obrazie MR?

Promieniowanie rentgenowskie powstaje w wyniku hamowania

W zapisie EKG załamek U występuje bezpośrednio po załamku

Pojawienie się w zapisie EKG patologicznego załamka Q lub QS może wskazywać na

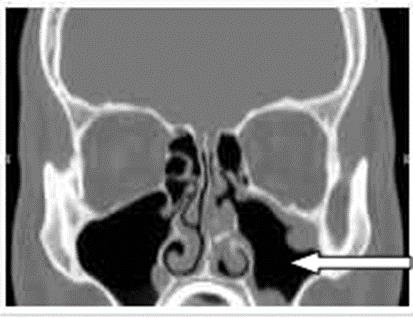

Na zamieszczonym obrazie TK strzałką zaznaczono zatokę

Powierzchnia gabinetu rentgenowskiego, w którym zainstalowany jest aparat rentgenowski wyposażony w oddzielną lampę, nie może być mniejsza niż

Warstwa półchłonna (WP) jest wyrażona w mm Cu dla

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Wskazaniem do wykonania badania spirometrycznego jest

Scyntygrafia kości „whole body” jest wskazana podczas diagnostyki

W diagnostyce mammograficznej punktowy ucisk sutka stosuje się w projekcji

Zwiększenie napięcia na lampie rentgenowskiej powoduje

W badaniu PETCT radioizotop ulega

W systemie międzynarodowym czwarty górny ząb mleczny po stronie prawej oznacza się symbolem