Pytanie 1

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

W sieci lokalnej, aby chronić urządzenia sieciowe przed przepięciami oraz różnicami napięć, które mogą wystąpić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

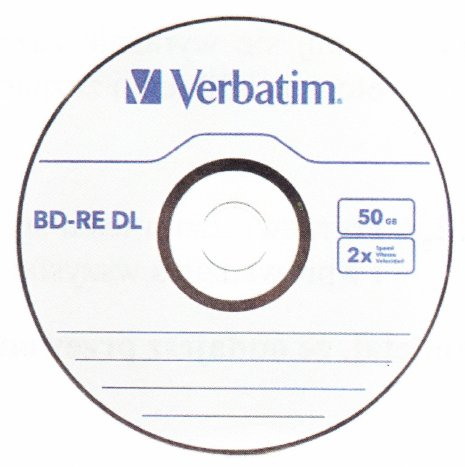

Aby nagrać dane na nośniku przedstawionym na ilustracji, konieczny jest odpowiedni napęd

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

Na rysunku znajduje się graficzny symbol

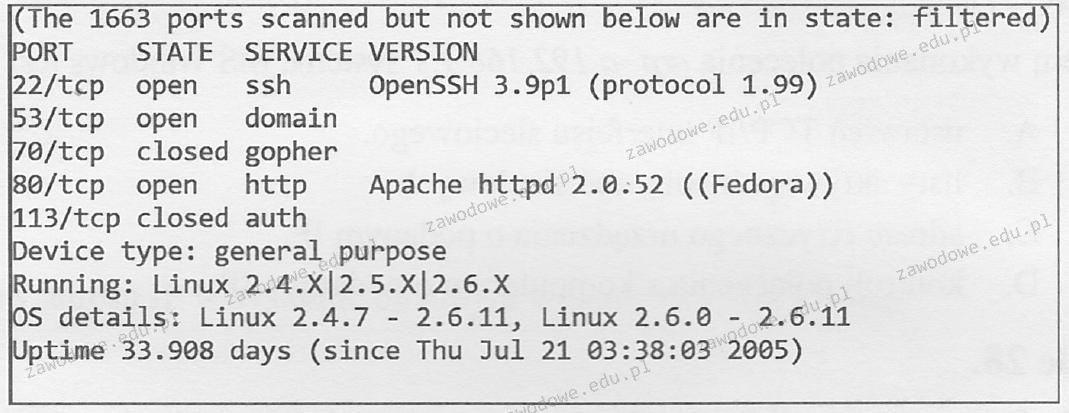

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby uporządkować dane pliku na dysku twardym, zapisane w klastrach, które nie sąsiadują ze sobą, tak aby znajdowały się w sąsiadujących klastrach, należy przeprowadzić

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Rozmiar plamki na ekranie monitora LCD wynosi

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

Jakiego narzędzia wraz z parametrami, należy użyć w systemie Windows, aby wyświetlić przedstawione informacje o dysku twardym?

| ST950420AS | |||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator dysku | : A67B7C06 | ||||||||||||||||||||||||||||||||||||||||||||||

| Typ | : ATA | ||||||||||||||||||||||||||||||||||||||||||||||

| Stan | : Online | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Element docelowy | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator jednostki LUN | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka lokalizacji | : PCIROOT(0)#ATA(C00T00L00) | ||||||||||||||||||||||||||||||||||||||||||||||

| Bieżący stan tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Rozruchowy | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików stronicowania | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików hibernacji | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk zrzutów awaryjnych | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk klastrowany | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| |||||||||||||||||||||||||||||||||||||||||||||||

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Gdy użytkownik systemu Windows nie ma możliwości skorzystania z drukarki, może skorzystać z opcji druku do pliku. Plik utworzony w ten sposób posiada rozszerzenie

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

W sieciach komputerowych, gniazdo, które jednoznacznie wskazuje na dany proces na urządzeniu, stanowi połączenie

W systemie Linux można uzyskać kopię danych przy użyciu komendy

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

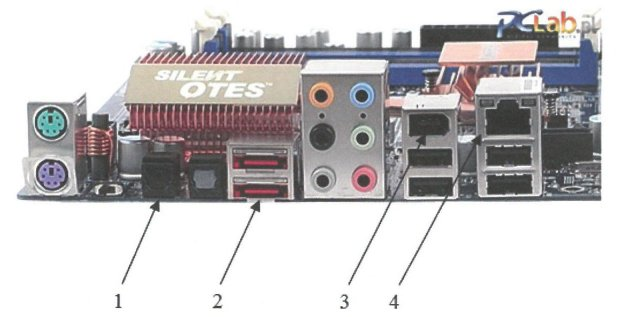

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Na ilustracji zaprezentowano graficzny symbol

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Na podstawie tabeli wskaż, który model przełącznika Cisco Catalyst, zawiera 48 portów i możliwość doposażenia o wkładki światłowodowe.

| Configurations of Cisco Catalyst 2960 Series Switches with LAN Base Software | ||

|---|---|---|

| Cisco Catalyst 2960 Switch Model | Description | Uplinks |

| 1 Gigabit Uplinks with 10/100 Ethernet Connectivity | ||

| Cisco Catalyst 2960-48PST-L | 48 Ethernet 10/100 PoE ports | 2 One Gigabit Ethernet SFP ports and 2 fixed Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24PC-L | 24 Ethernet 10/100 PoE ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24LT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24TC-L | 24 Ethernet 10/100 ports | 2 dual-purpose ports |

| Cisco Catalyst 2960-48TC-L | 48 Ethernet 10/100 ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24TT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-48TT-L | 48 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

Co to jest serwer baz danych?

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Na ilustracji zaprezentowano zrzut ekranu z wykonanej analizy

Który adres IP jest przypisany do klasy A?