Pytanie 1

Jaką topologię fizyczną wykorzystuje się w sieciach o logice Token Ring?

Wynik: 5/40 punktów (12,5%)

Wymagane minimum: 20 punktów (50%)

Jaką topologię fizyczną wykorzystuje się w sieciach o logice Token Ring?

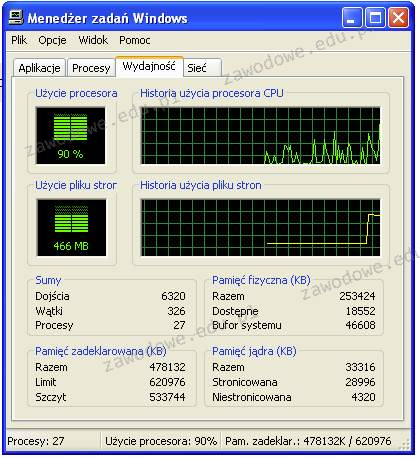

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

W dokumentacji płyty głównej zapisano „Wsparcie dla S/PDIF Out”. Co to oznacza w kontekście tego modelu płyty głównej?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

Czym jest OTDR?

Aby wyświetlić listę wszystkich zainstalowanych urządzeń w systemie Windows lub zmienić ich właściwości, należy skorzystać z narzędzia

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Przedstawione na ilustracji narzędzie służy do

Jak wygląda sekwencja w złączu RJ-45 według normy TIA/EIA-568 dla zakończenia typu T568B?

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

Brak odpowiedzi na to pytanie.

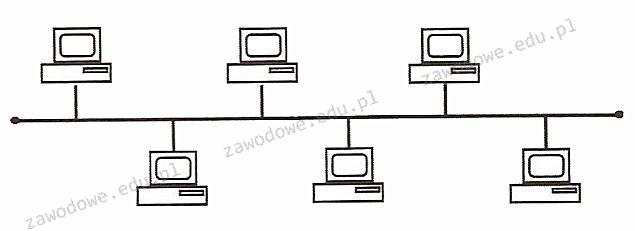

Na ilustracji ukazano sieć o układzie

Brak odpowiedzi na to pytanie.

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Brak odpowiedzi na to pytanie.

Jaką rolę pełni usługa NAT działająca na ruterze?

Brak odpowiedzi na to pytanie.

W serwerach warto wykorzystywać dyski, które obsługują tryb Hot plugging, ponieważ

Brak odpowiedzi na to pytanie.

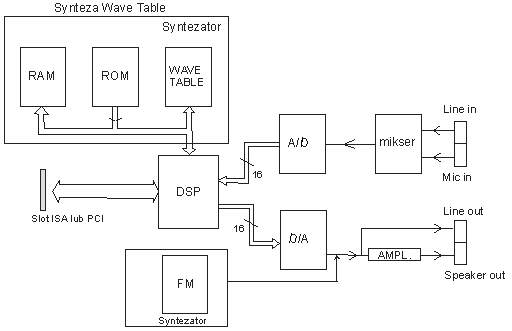

Na które wyjście powinniśmy podłączyć aktywne głośniki w karcie dźwiękowej, której schemat przedstawiony jest na rysunku?

Brak odpowiedzi na to pytanie.

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Brak odpowiedzi na to pytanie.

W systemie Windows, gdzie można ustalić wymagania dotyczące złożoności hasła?

Brak odpowiedzi na to pytanie.

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

Brak odpowiedzi na to pytanie.

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Zaprezentowany komunikat jest rezultatem wykonania następującego polecenia

C:\Windows NT_SERVICE\TrustedInstaller:(F)

NT_SERVICE\TrustedInstaller:(CI)(IO)(F)

ZARZĄDZANIE NT\SYSTEM:(M)

ZARZĄDZANIE NT\SYSTEM:(OI)(CI)(IO)(F)

BUILTIN\Administratorzy:(M)

BUILTIN\Administratorzy:(OI)(CI)(IO)(F)

BUILTIN\Użytkownicy:(RX)

BUILTIN\Użytkownicy:(OI)(CI)(IO)(GR,GE)

TWÓRCA-WŁAŚCICIEL:(OI)(CI)(IO)(F)

Brak odpowiedzi na to pytanie.

Jakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

Brak odpowiedzi na to pytanie.

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Brak odpowiedzi na to pytanie.

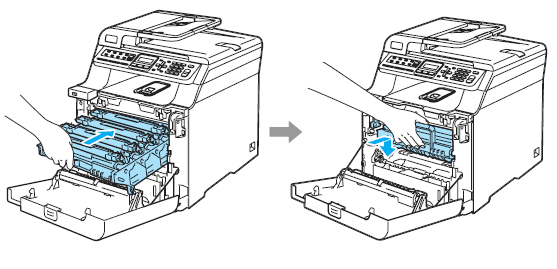

Czynność pokazana na rysunkach ilustruje mocowanie

Brak odpowiedzi na to pytanie.

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

Brak odpowiedzi na to pytanie.

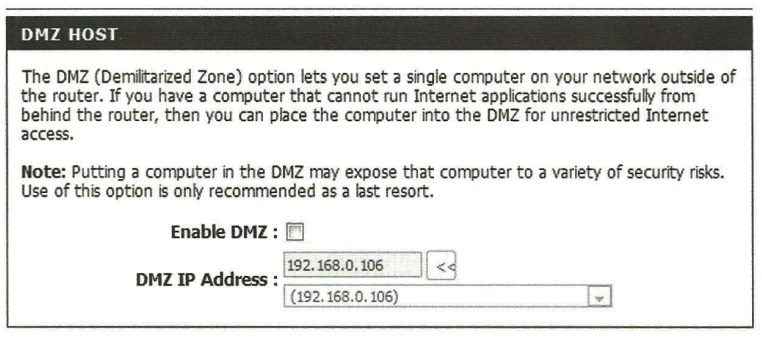

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Brak odpowiedzi na to pytanie.

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Brak odpowiedzi na to pytanie.

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Brak odpowiedzi na to pytanie.

Czym jest kopia różnicowa?

Brak odpowiedzi na to pytanie.

Jakim poleceniem w systemie Linux można ustalić trasę pakietu do celu?

Brak odpowiedzi na to pytanie.

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Brak odpowiedzi na to pytanie.

W jakim systemie występuje jądro hybrydowe (kernel)?

Brak odpowiedzi na to pytanie.

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?

Brak odpowiedzi na to pytanie.