Pytanie 1

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

W systemach operacyjnych Windows konto użytkownika, które ma najwyższe domyślne uprawnienia, należy do grupy

Jakie urządzenie łączy sieć lokalną z siecią rozległą?

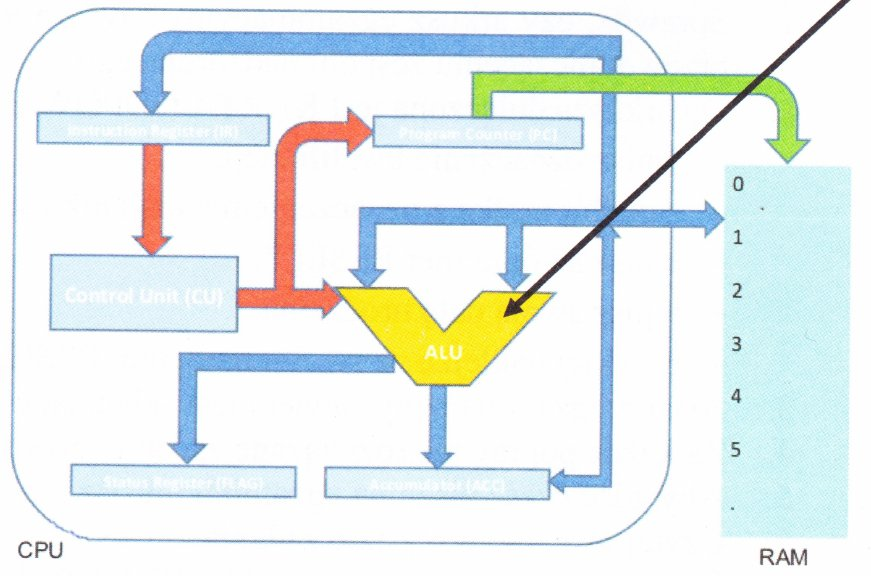

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Jak nazywa się interfejs wewnętrzny w komputerze?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

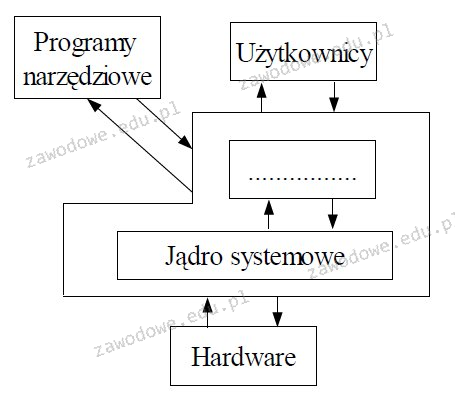

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Ile liczb w systemie szesnastkowym jest wymaganych do zapisania pełnej formy adresu IPv6?

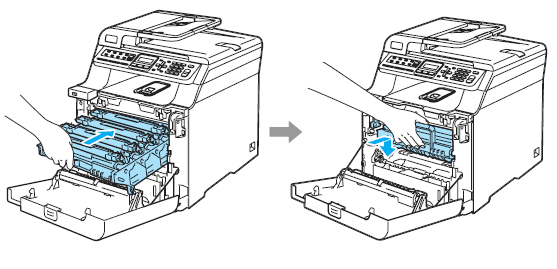

Czynność pokazana na rysunkach ilustruje mocowanie

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

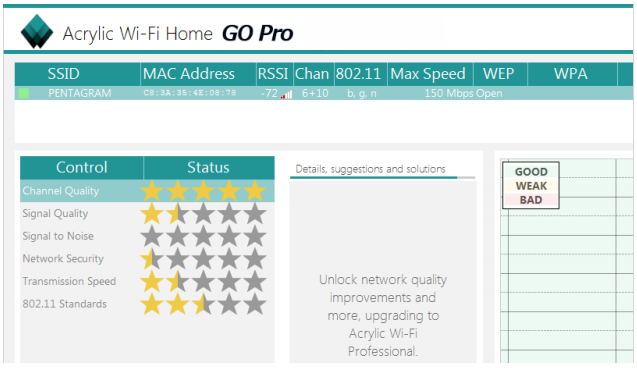

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

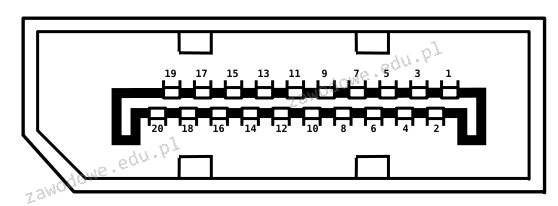

Na ilustracji pokazano złącze:

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Wskaż właściwą formę maski podsieci?

Toner stanowi materiał eksploatacyjny w drukarce

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

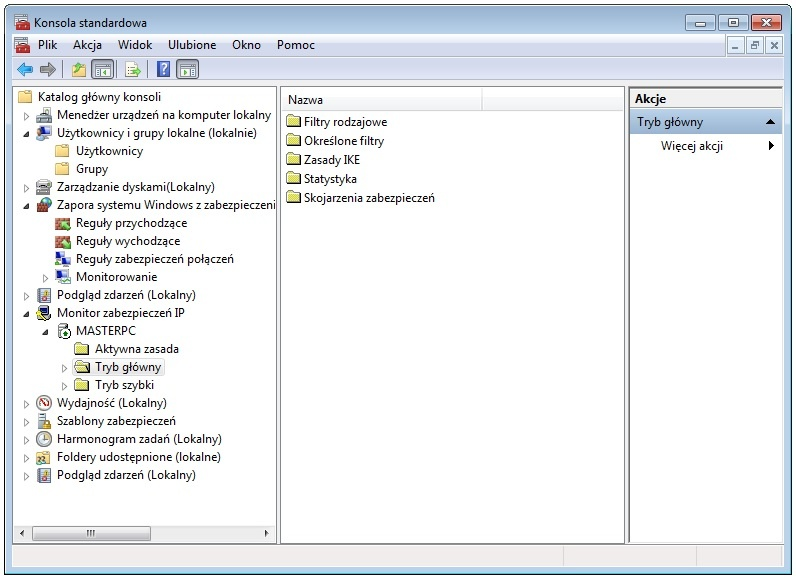

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Która z usług odnosi się do centralnego zarządzania tożsamościami, uprawnieniami oraz obiektami w sieci?

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

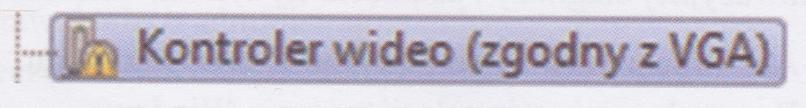

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Drugi monitor CRT, który jest podłączony do komputera, ma zastosowanie do

Jakie są skutki działania poniższego polecenia ```netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53```?

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Jakie urządzenia dotyczą terminy SLI?

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?