Pytanie 1

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Zgłoszona awaria ekranu laptopa może być wynikiem

System Windows 8, w którym wcześniej został utworzony punkt przywracania, doświadczył awarii. Jakie polecenie należy wydać, aby przywrócić ustawienia i pliki systemowe?

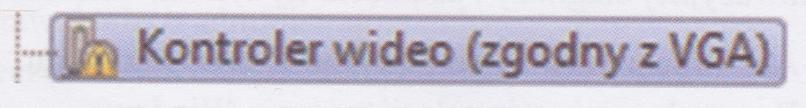

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

"Gorące podłączenie" ("Hot plug") oznacza, że urządzenie, które jest podłączane, ma

Jaką ochronę zapewnia program antyspyware?

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

Aby zmienić system plików na dysku z FAT32 na NTFS w Windows XP, należy użyć programu

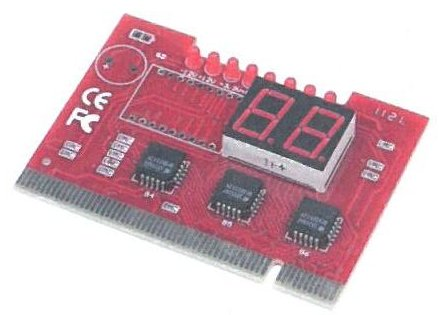

Na ilustracji zaprezentowano

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Który standard w sieciach LAN określa dostęp do medium poprzez wykorzystanie tokenu?

Który protokół przesyła datagramy bez gwarancji ich dostarczenia?

Co oznacza skrót WAN?

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Które z podanych poleceń w systemie Windows XP umożliwia sprawdzenie aktualnej konfiguracji adresu IP systemu Windows?

Do czego służy program CHKDSK?

Główną rolą serwera FTP jest

W lokalnej sieci uruchomiono serwer odpowiedzialny za przydzielanie dynamicznych adresów IP. Jaką usługę należy aktywować na tym serwerze?

Jakim akronimem oznacza się przenikanie bliskie skrętki teleinformatycznej?

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

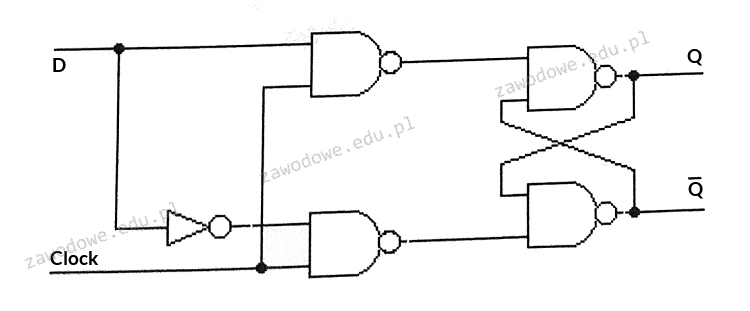

Jak wygląda schemat połączeń bramek logicznych?

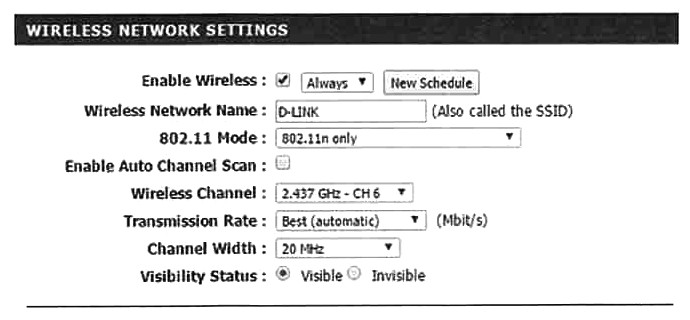

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Którą kartę rozszerzeń w komputerze przedstawia to zdjęcie?

Który komponent mikroprocesora odpowiada m.in. za odczytywanie instrukcji z pamięci oraz generowanie sygnałów kontrolnych?

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Zarządzanie partycjami w systemach operacyjnych Windows

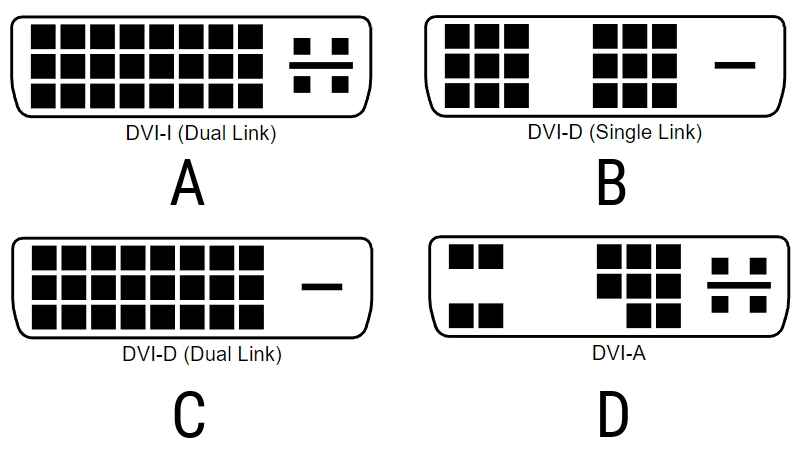

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Jakie stwierdzenie dotyczące konta użytkownika Active Directory w systemie Windows jest właściwe?

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Do czego służy narzędzie 'ping' w sieciach komputerowych?

Jaki jest główny cel stosowania maski podsieci?

Jak nazywa się technika modyfikowania ramek sieciowych polegająca na oznaczaniu ich identyfikatorem sieci VLAN nadawcy według standardu IEEE 802.1Q?

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry