Pytanie 1

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

Urządzenia wykorzystujące port USB 2.0 są zasilane napięciem, którego wartość znajduje się w przedziale

Użytkownik systemu Windows może korzystając z programu Cipher

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

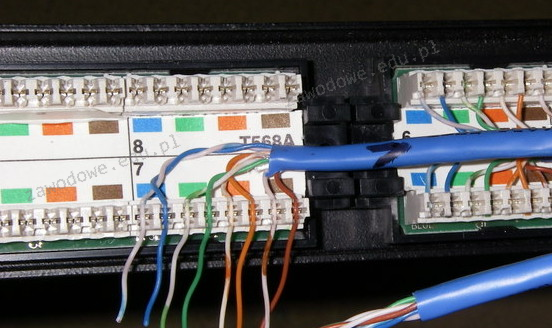

Na ilustracji widać patchpanel - panel krosowy kategorii 5E bez ekranowania, który posiada złącze szczelinowe typu LSA. Jakie narzędzie należy zastosować do wkładania kabli w te złącza?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Jaką usługę można wykorzystać do zdalnej pracy na komputerze z systemem Windows, korzystając z innego komputera z tym samym systemem, który jest podłączony do tej samej sieci lub do Internetu?

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Do jakiego celu służy program fsck w systemie Linux?

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

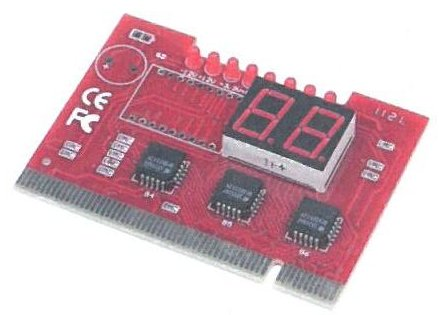

Na ilustracji zaprezentowano

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Prezentowana usterka ekranu laptopa może być spowodowana

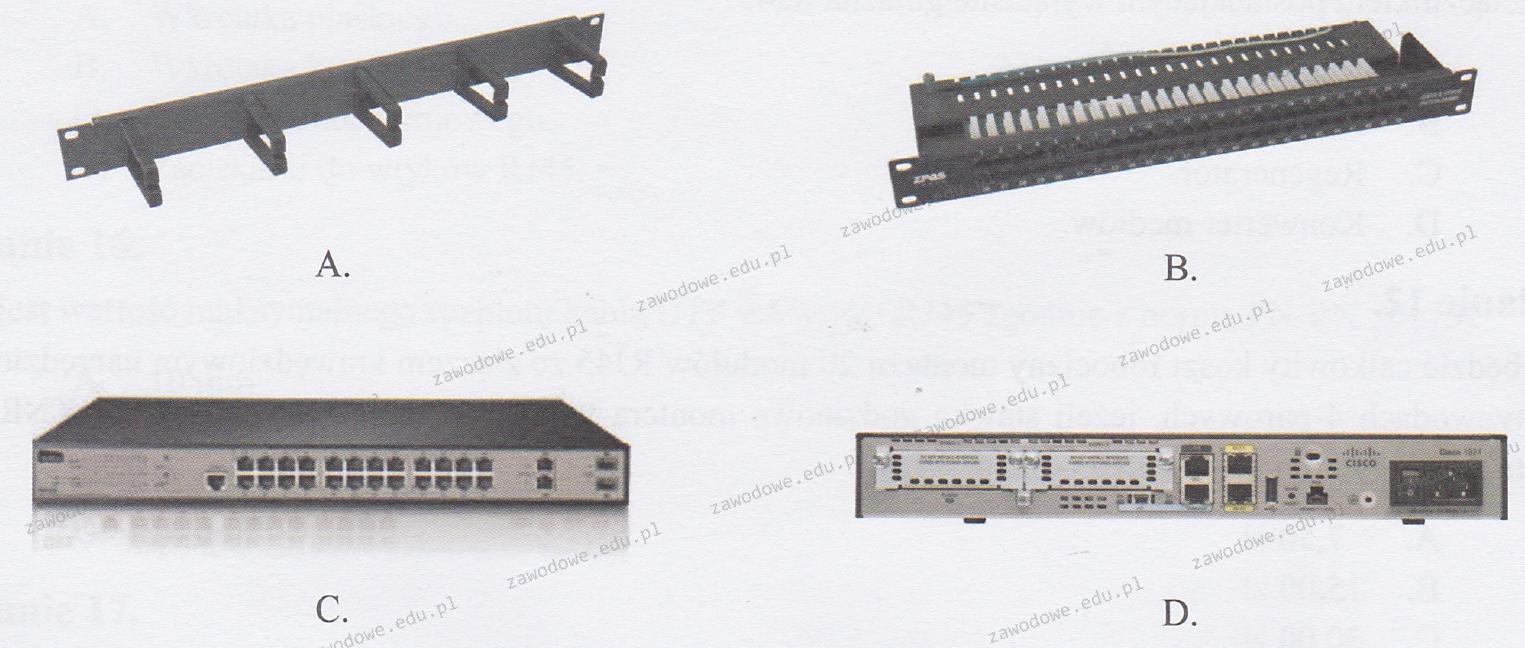

Na którym obrazku przedstawiono panel krosowniczy?

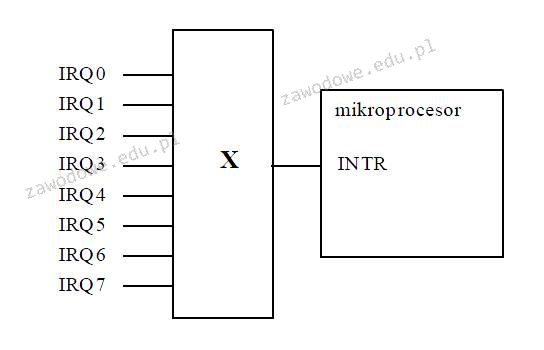

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

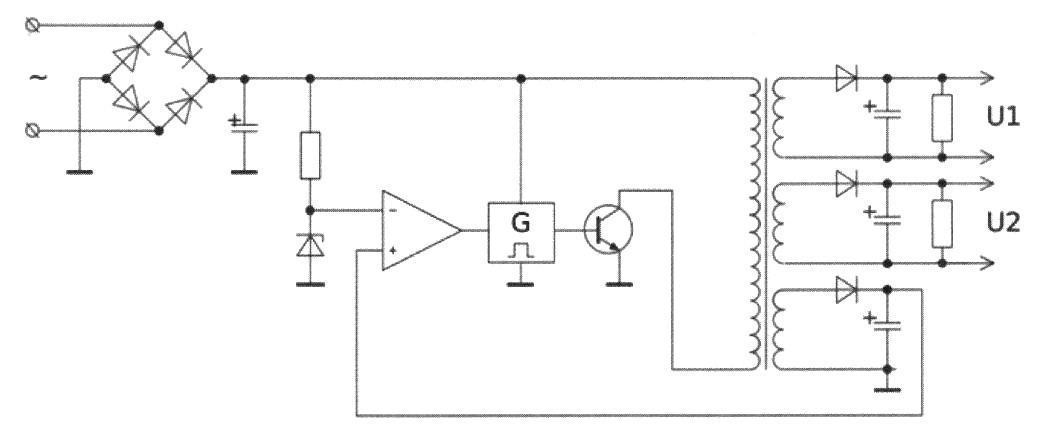

Na rysunku zobrazowano schemat

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

Awaria drukarki igłowej może być spowodowana uszkodzeniem

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Komunikat o błędzie KB/Interface, wyświetlany na monitorze komputera podczas BIOS POST firmy AMI, wskazuje na problem

Jakie polecenie w systemach operacyjnych Windows służy do prezentacji konfiguracji interfejsów sieciowych?

Aby podłączyć kasę fiskalną z interfejsem DB-9M do komputera stacjonarnego, należy użyć przewodu

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Jaką liczbę warstw określa model ISO/OSI?

Komputer lokalny dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego komputera, która rozpoznaje adresy w sieci, uzyskano informację, że adres komputera to 195.182.130.24. To oznacza, że