Pytanie 1

Którego z poniższych zadań nie wykonują serwery plików?

Wynik: 9/40 punktów (22,5%)

Wymagane minimum: 20 punktów (50%)

Którego z poniższych zadań nie wykonują serwery plików?

Jak nazywa się protokół, który umożliwia pobieranie wiadomości z serwera?

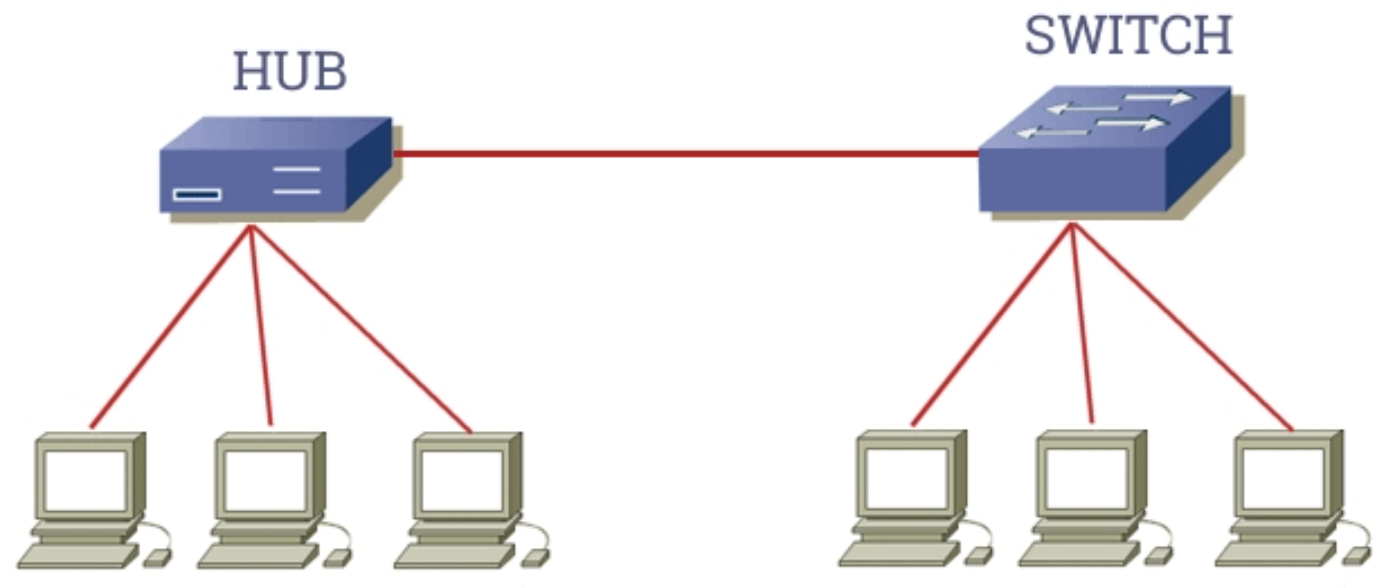

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Termin "PIO Mode" odnosi się do trybu operacyjnego

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

Który z wymienionych adresów IP nie zalicza się do prywatnych?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

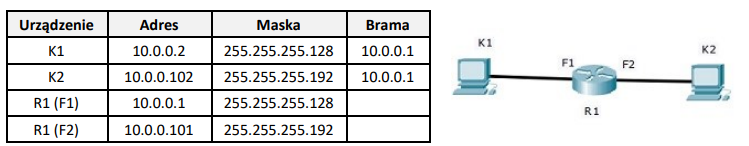

Komputery K1 i K2 nie są w stanie nawiązać komunikacji. Adresy urządzeń zostały przedstawione w tabeli. Co należy zmienić, aby przywrócić połączenie w sieci?

Aby zapobiegać i eliminować szkodliwe oprogramowanie, takie jak exploity, robaki oraz trojany, konieczne jest zainstalowanie oprogramowania

Aby przekształcić serwer w kontroler domeny w systemach Windows Server, konieczne jest użycie komendy

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie zakresy zostaną przydzielone przez administratora do adresów prywatnych w klasie C, przy użyciu maski 24 bitowej dla komputerów w lokalnej sieci?

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Jaką czynność można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, bez przechodzenia do trybu uprzywilejowanego, na poziomie dostępu widocznym w powyższej ramce?

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Oznaczenie CE świadczy o tym, że

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Aby uniknąć utraty danych w aplikacji do ewidencji uczniów, po zakończonej pracy każdego dnia należy wykonać

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Wskaż interfejsy płyty głównej widoczne na rysunku.

W systemie Linux komenda cd ~ umożliwia

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

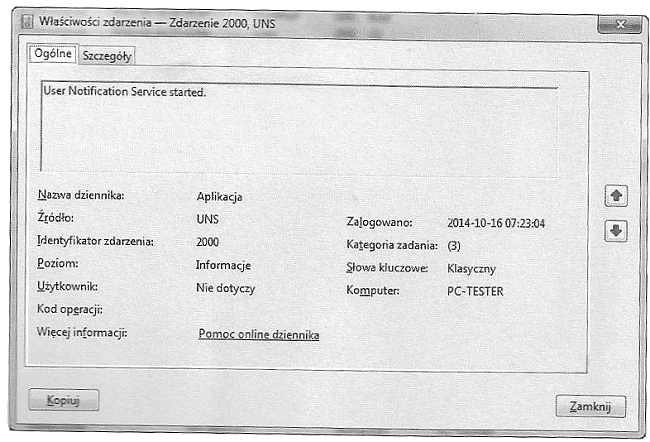

Wpis przedstawiony na ilustracji w dzienniku zdarzeń klasyfikowany jest jako zdarzenie typu

Sieci lokalne o architekturze klient-serwer są definiowane przez to, że

W systemie działającym w trybie wielozadaniowości z wywłaszczeniem program, który zatrzymał się