Pytanie 1

Na obrazie rezonansu magnetycznego strzałką oznaczono wyrostek kolczysty kręgu

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Na obrazie rezonansu magnetycznego strzałką oznaczono wyrostek kolczysty kręgu

Podczas wykonywania zdjęcia rentgenowskiego klatki piersiowej w celu ochrony radiologicznej pacjenta należy zastosować

Promieniowanie jonizujące pośrednio to

Centratory laserowe zamontowane w kabinie aparatu terapeutycznego służą do

W celu wyeliminowania zakłóceń obrazu MR przez sygnały pochodzące z tkanki tłuszczowej, stosuje się

Strzykawka automatyczna do podawania kontrastu jest stosowana przy wykonywaniu

Zastosowana w badaniu radiologicznym kratka przeciwrozproszeniowa powoduje

Zgodnie z procedurą wzorcową w badaniu MR należy ułożyć pacjenta na brzuchu do diagnostyki

Które badanie, zgodnie z zakresem kompetencji, może samodzielnie wykonać technik elektroradiolog?

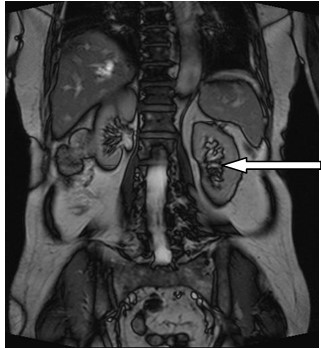

Na obrazie MR jamy brzusznej strzałką wskazano

Promieniowanie rentgenowskie powstaje w wyniku hamowania

W badaniu EKG odprowadzenie I rejestruje różnicę potencjałów między

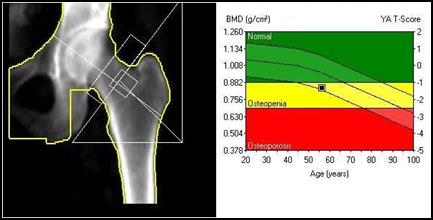

Która metoda diagnostyczna służy do określenia gęstości minerału kostnego w ujęciu objętościowym g/cm³?

Ligand stosuje się

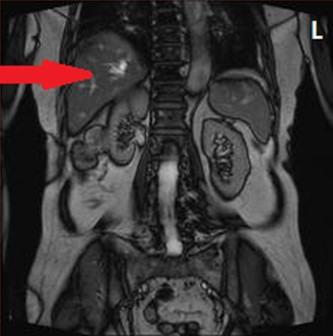

Który narząd został oznaczony strzałką na obrazie rezonansu magnetycznego?

W zapisie EKG zespół QRS odzwierciedla

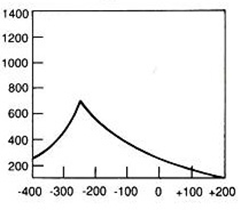

Który wynik badania tympanometrycznego potwierdza, że słuch badanego pacjenta jest w granicach normy?

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

Miejscem wykonania pomiaru densytometrycznego z kości przedramienia jest

W pozytonowej tomografii emisyjnej PET zostaje zarejestrowane promieniowanie powstające podczas

Wskazaniem do wykonania scyntygrafii perfuzyjnej jest

W ułożeniu do rentgenografii AP stawu kolanowego promień główny pada

W radiologii analogowej lampy rentgenowskiej z tubusem używa się do wykonania zdjęcia

Fotostymulacja wykonywana jest podczas badania

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

W badaniu audiometrycznym rezerwa ślimakowa to odległość między krzywą

W badaniu audiometrycznym do oceny przewodnictwa kostnego wybranego ucha słuchawkę kostną należy przyłożyć do

W jaki sposób należy ustawić promień centralny w stosunku do ramienia i przedramienia, by wykonać zdjęcie rentgenograficzne stawu łokciowego u pacjenta z przykurczem?

SPECT to

Fistulografia to badanie kontrastowe

„Ognisko zimne” w obrazie scyntygraficznym określa się jako

„Ognisko zimne” w obrazie scyntygraficznym określa się jako

Brachyterapia wewnątrzjamowa jest wykorzystywana podczas leczenia nowotworu

Czas połowicznego zaniku jest wykorzystywany

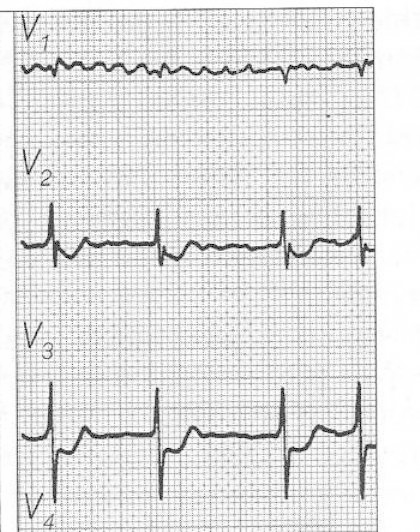

Zamieszczony elektrokardiogram przedstawia

Jaki kolor ma warstwa korowa kości w badaniu MR na obrazie T1- zależnym?

Do zadań technika elektroradiologa w pracowni hemodynamicznej należy

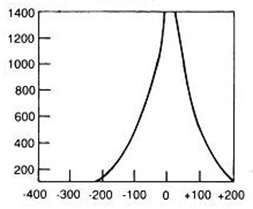

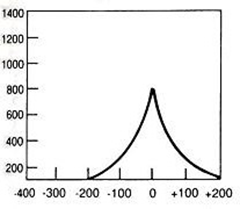

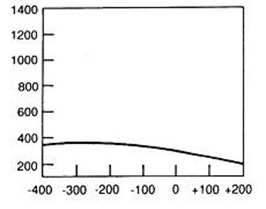

Zamieszczone na ilustracji obrazy dotyczą badania