Pytanie 1

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

W skanerach z systemem CIS źródłem światła oświetlającym dokument jest

Podstawowy rekord uruchamiający na dysku twardym to

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Na zdjęciu widnieje

Wskaż rodzaj wtyczki zasilającej, którą należy połączyć z napędem optycznym podczas montażu komputera.

Medium transmisyjne oznaczone symbolem S/FTP wskazuje na skrętkę

AES (ang. Advanced Encryption Standard) to?

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

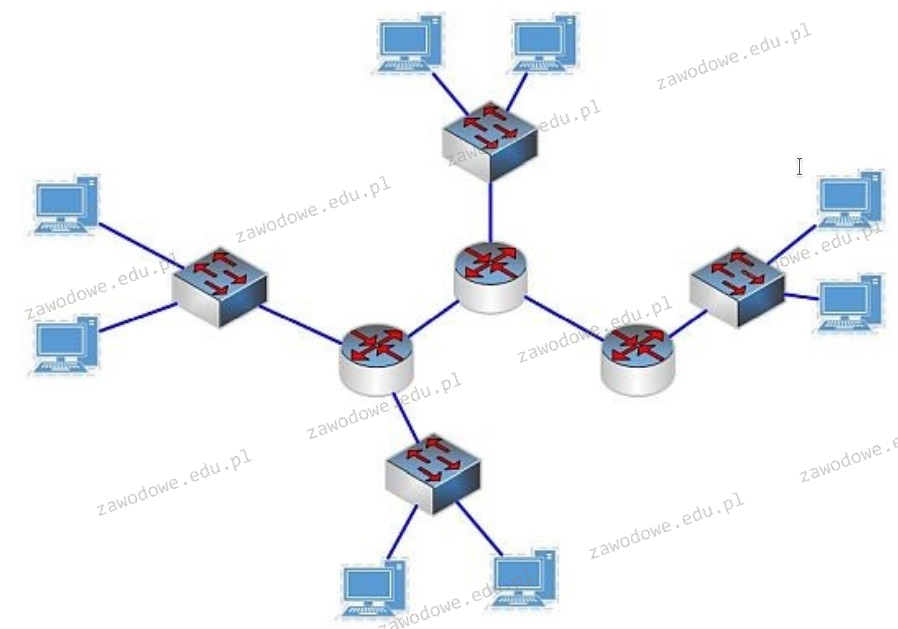

Jakie elementy łączy okablowanie pionowe w sieci LAN?

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

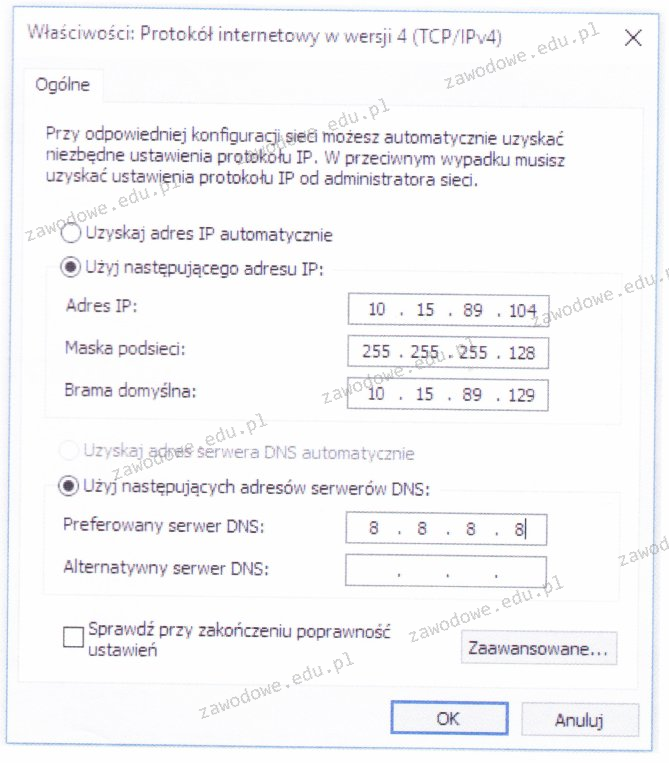

Schemat ilustruje ustawienia karty sieciowej dla urządzenia z adresem IP 10.15.89.104/25. Można z niego wywnioskować, że

Na diagramie przedstawione są symbole

Aby podłączyć drukarkę z portem równoległym do komputera, który dysponuje jedynie złączami USB, konieczne jest zainstalowanie adaptera

W systemie Windows można zweryfikować parametry karty graficznej, używając następującego polecenia

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

Norma EN 50167 odnosi się do systemów okablowania

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Interfejs UDMA to typ interfejsu

Jaki jest standard 1000Base-T?

Czym wyróżniają się procesory CISC?

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

Którego programu nie można użyć do przywrócenia danych w systemie Windows na podstawie wcześniej wykonanej kopii?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Pełna maska podsieci z prefiksem /25 to

Okablowanie wertykalne w sieci strukturalnej łączy

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5