Pytanie 1

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Jaką postać ma liczba szesnastkowa: FFFF w systemie binarnym?

Programem służącym do archiwizacji danych w systemie Linux jest

Złocenie styków złącz HDMI ma na celu

W systemie Linux, żeby ustawić domyślny katalog domowy dla nowych użytkowników na katalog /users/home/new, konieczne jest użycie polecenia

Okablowanie pionowe w systemie strukturalnym łączy się

Jakie rozwiązanie techniczne pozwala na transmisję danych z szybkością 1 Gb/s z zastosowaniem światłowodu?

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

Jakie polecenie służy do obserwowania lokalnych połączeń?

W systemie binarnym liczba 51(10) przyjmuje formę

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

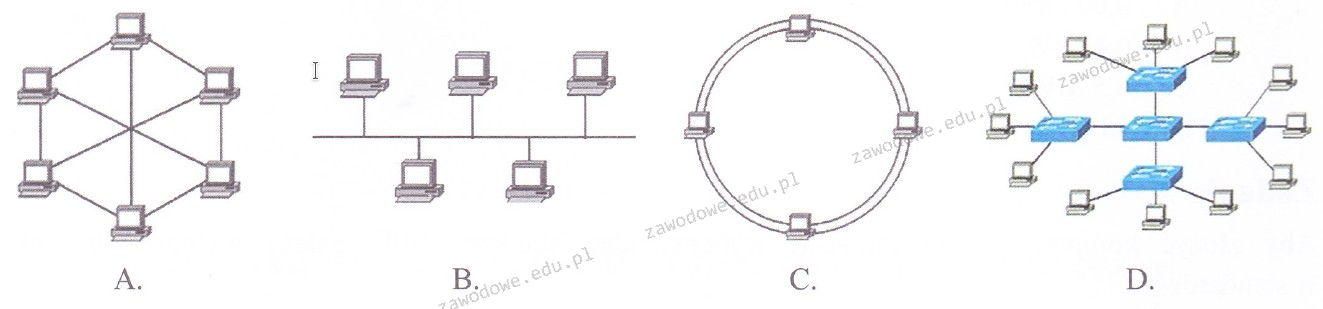

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

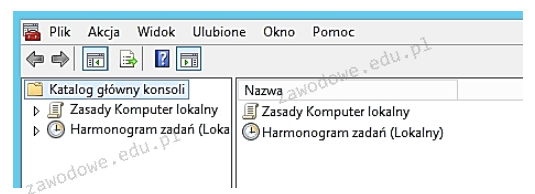

Aby otworzyć konsolę przedstawioną na ilustracji, należy wpisać w oknie poleceń

Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

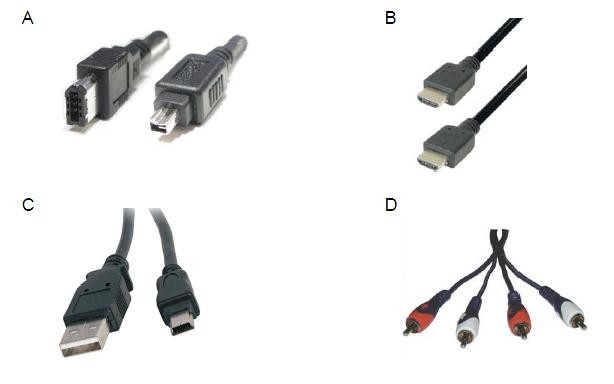

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Na diagramie zaprezentowano strukturę

Program testujący wydajność sprzętu komputerowego to

Czym jest licencja OEM?

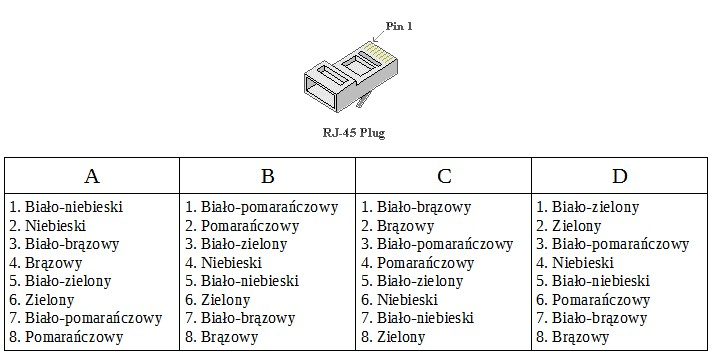

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

W jakim modelu płyty głównej można zainstalować procesor o wymienionych specyfikacjach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

W usłudze Active Directory, konfigurację składającą się z jednej lub więcej domen, które dzielą wspólny schemat i globalny wykaz, nazywamy

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

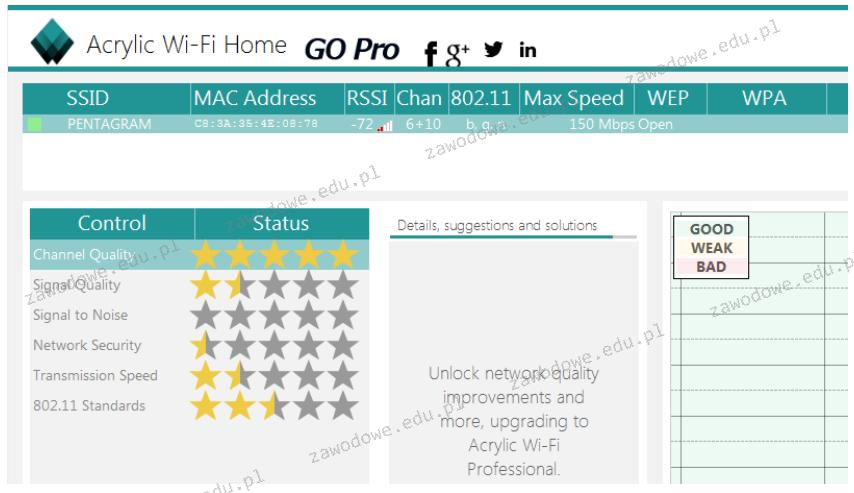

Wykonano test przy użyciu programu Acrylic Wi-Fi Home, a wyniki przedstawiono na zrzucie ekranu. Na ich podstawie można wnioskować, że dostępna sieć bezprzewodowa

Liczba 22 umieszczona w adresie http://www.adres_serwera.pl:22 wskazuje na numer

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

Jaką usługę można wykorzystać do zdalnej pracy na komputerze z systemem Windows, korzystając z innego komputera z tym samym systemem, który jest podłączony do tej samej sieci lub do Internetu?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo zabrudzone. W celu ich oczyszczenia, należy zastosować

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?