Pytanie 1

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

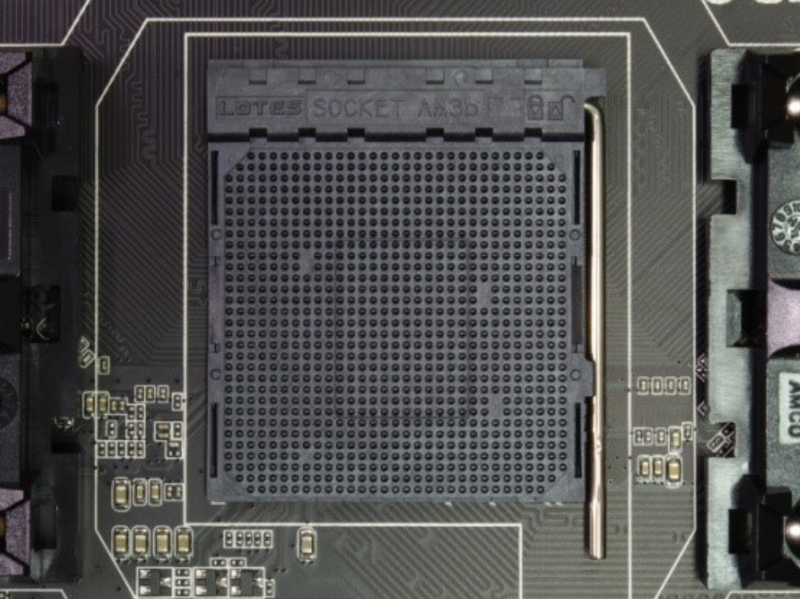

Procesor Intel Core i3 można zamontować w gnieździe

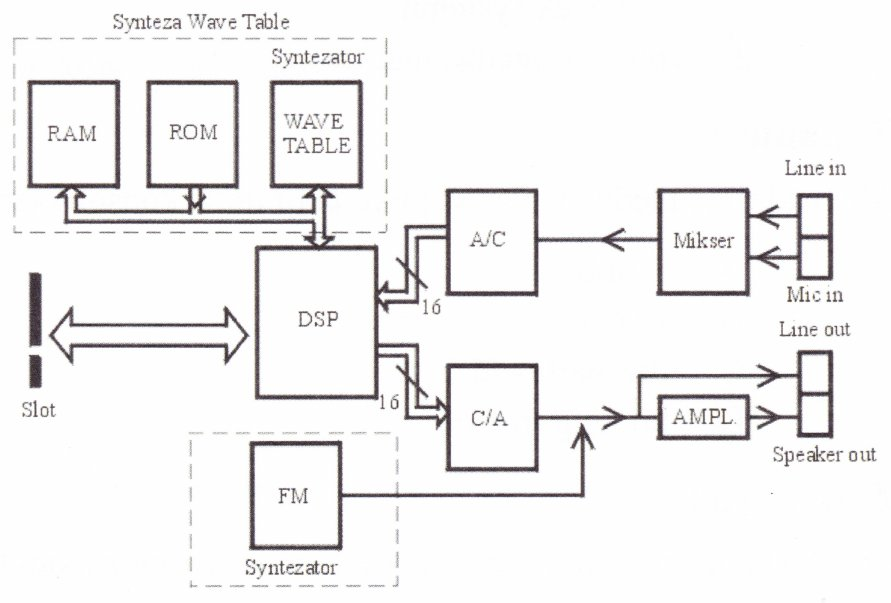

Na ilustracji przedstawiono diagram funkcjonowania

Jaką technologię wykorzystuje się do uzyskania dostępu do Internetu oraz odbioru kanałów telewizyjnych w formie cyfrowej?

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Karta dźwiękowa, która może odtworzyć plik w formacie MP3, powinna być zaopatrzona w układ

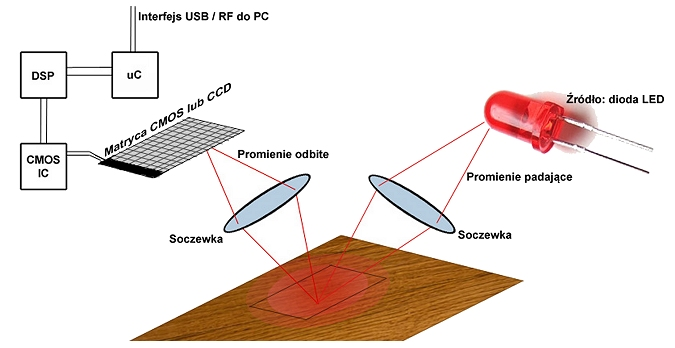

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?

W systemie Linux narzędzie fsck umożliwia

Wykonanie polecenia fsck w systemie Linux będzie skutkować

Aby zweryfikować poprawność przebiegów oraz wartości napięć w układzie urządzenia elektronicznego, można zastosować

Wykorzystane kasety od drukarek powinny być

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem

Jakie zadanie pełni router?

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

W programie Explorator systemu Windows, naciśnięcie klawisza F5 zazwyczaj powoduje wykonanie następującej operacji:

Co umożliwia połączenie trunk dwóch przełączników?

Prawo majątkowe twórcy dotyczące oprogramowania komputerowego

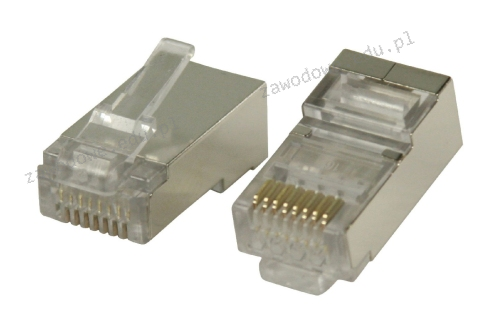

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Oznaczenie CE świadczy o tym, że

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Wskaż błędne twierdzenie dotyczące Active Directory?

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Czym nie jest program antywirusowy?

Polecenie do zmiany adresu MAC karty sieciowej w systemie Linux to

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

Które złącze powinna posiadać karta graficzna, aby można było bezpośrednio ją połączyć z telewizorem LCD wyposażonym wyłącznie w analogowe złącze do podłączenia komputera?

Zadania systemu operacyjnego nie obejmują

W systemie operacyjnym Linux proces archiwizacji danych wykonuje się za pomocą polecenia

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Jaki element sieci SIP określamy jako telefon IP?