Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

EN IEC 60276:2019 to przykład oznaczenia normy

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Możliwość weryfikacji poprawności działania pamięci RAM można uzyskać za pomocą programu diagnostycznego

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

Na podstawie zaprezentowanego cennika oblicz, jaki będzie całkowity koszt jednego dwumodułowego podwójnego gniazda abonenckiego montowanego na powierzchni.

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45 mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

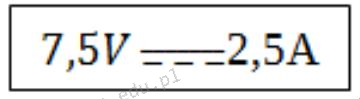

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Uszkodzenie czego może być przyczyną awarii klawiatury?

Aby sprawdzić dostępną przestrzeń na dysku twardym w systemie Linux, można wykorzystać polecenie

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

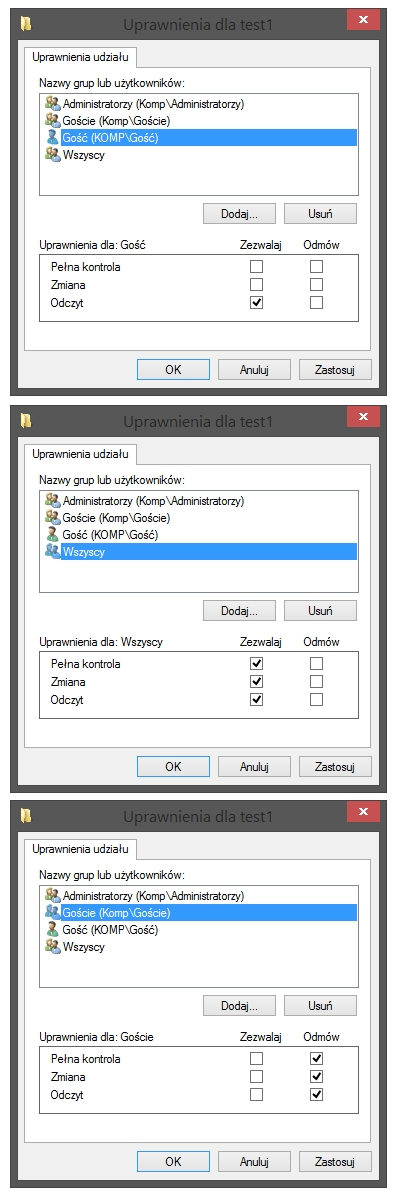

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Aby w systemie Windows, przy użyciu wiersza poleceń, zmienić partycję FAT na NTFS bez utraty danych, powinno się zastosować polecenie

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

W systemie Windows zastosowanie przedstawionego polecenia spowoduje chwilową zmianę koloru

Microsoft Windows [Wersja 6.1.7600] Copyright (c) 2009 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\w>color 1_

Jaką metodę stosuje się do dostępu do medium transmisyjnego z wykrywaniem kolizji w sieciach LAN?

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Urządzenia wykorzystujące port USB 2.0 są zasilane napięciem, którego wartość znajduje się w przedziale

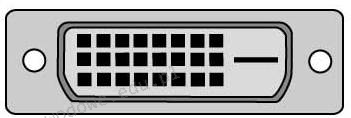

Na ilustracji pokazano złącze:

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Przy pomocy testów statycznych okablowania można zidentyfikować

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

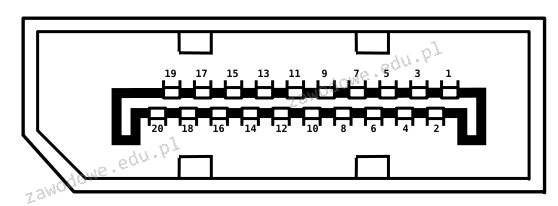

Jak brzmi nazwa portu umieszczonego na tylnym panelu komputera, który znajduje się na przedstawionym rysunku?

Do czego służy oprogramowanie Microsoft Hyper-V?

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Co wskazuje oznaczenie danego procesora?

Protokół User Datagram Protocol (UDP) należy do

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Jakie narzędzie pozwala na zarządzanie menadżerem rozruchu w systemach Windows od wersji Vista?

Który instrument służy do pomiaru długości oraz tłumienności przewodów miedzianych?

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?